Warum nicht einfach einfach? LIVE CODING: PremiereRemote & StreamDeck MCP 702.gg

Revolution in der Videobearbeitung durch MCP-Server und KI

Die Entwicklung von MCP-Servern hat einen Paradigmenwechsel in der Softwarebeschleunigung bewirkt. Besonders bemerkenswert ist die Integration mit Adobe Premiere Pro über die neue UXP-API, die eine automatische Erzeugung von Schnittmarkierungen ermöglicht. Durch KI-Transkription werden präzise Zeitstempel für jede Aussage erstellt, was eine genaue Festlegung von Schnittpunkten ermöglicht. Dieses neuartige System verspricht, den Videobearbeitungsprozess grundlegend zu revolutionieren und zukünftige manuelle Schneideworkflows überflüssig zu machen.

00:05:32 Hallo, hallo!

Start und Technik

00:05:3700:05:37 Krass, es funktioniert einfach mal. Also nicht als hätte irgendwas nicht funktioniert, aber also jedes Mal, wenn ich meinen PC starte und den Streamern mache und ich sehe Bild, ich höre Ton, ich sehe Ausschlag, also nicht Hautausschlag, sondern Pegel-Ausschlag, auch nicht Alkoholpegel, sondern Audio-Pegel, dann freue ich mich. Ich bin ein einfacher Mann. Ich sehe Dinge funktionieren.

00:06:06 Ich freue mich. Es ist so einfach. Ich sehe Leute subscriben. Ich freue mich auch. Hallo, herzlich willkommen zu, ähm, kann man jetzt sagen, guter Sonntagmorgen-Stream? Weil ich meine, also technisch gesehen ist es Sonntagmorgen. Und das Wetter ist okay, geht alles gut durch. Ist es also ein guter Sonntagmorgen-Stream?

00:06:41 Mir tut diese Unregelmäßigkeit offenbar echt gut. Ich meine, also, look at this, es ist noch nicht mal 11 Uhr und ich bin schon online. Heftig, oder? Aber okay, lass mich erstmal nachverfolgen, was alles so passiert ist. Also erstmal macht sich so ein Kopf darüber lustig, dass ich irgendwas mit MCP mache. Ja, aber wir missbrauchen MCP gegen MCPs Willen. Also ich weiß nicht, ob...

00:07:13 als AI. Also wir machen eigentlich eher so HI aus dem AI, indem wir eine Schnittstelle für

00:07:23 Human Intelligence nutzen statt für Artificial Intelligence, aber... Wo ist schon der Unterschied? Hahaha! Okay, zum Glück sind wir da noch nicht. Daniel, danke für deinen Sub. Like Technik ebenfalls für den hinter Sub. Vielen Dank. So ein Kopf star! Mit 93 Monaten viel zu viel innerliche Schmerzen. Äh, Preise Satan, weil Kegelsnight heute Morgen nicht da sein kann. Fried, danke für 12 Monate. Das ist das volle Jahr. Hätte ich noch diese coolen LED-Dinger im Hintergrund.

00:07:52 Dann würden die jetzt krass aufleuchten. Ja, es wird Zeit, Leute, wirklich. Also der Teil des Büros ist ja fertig. Da habe ich vor kurzem auch ein Video drüber gemacht. Aber vielleicht muss ich hier mal irgendwas Flashiges im Hintergrund packen oder so. I don't know, wäre schon cool.

00:08:08 Bissle Lichter-Show oder so. Vielleicht die Philips Hue ansteuern. Ist ja alles Philips Hue-ifiziert hier. Also wirklich jede einzelne Lampe hier, okay, bis auf die Elgato-Lichter, aber die haben auch eine API, ist mit Philips Hue gesteuert. Vielleicht sollte ich einen MCP-Server aufsetzen, der meine Lichter fernsteuert und eine Kamera, die dann in den Feedback-Kanal spielt.

00:08:36 Wir sind jetzt im AI Zeitalter. Vor allem AI. AI ist so mein persönlicher Favorit. Gibt es eigentlich Minecraft MCP? Garantiert gibt es das, oder? Sonst könnten ja Chatbots nicht Minecraft spielen. Die Idee hat ja schon jemand vor zwei Jahren. Ähm, Furious. Was habe ich gesagt? Furious? Auch nicht schlecht. Furious! Und der Baby-Blub.

00:09:05 Ehrlich. Willkommen zurück zu einem, ja wir nennen es wie es ist, Livestream, okay? I don't give a fuck. Ich brauche keine fancy Namen für meine Livestreams. Was ich brauche, ist Kaffee.

Kaffeexpertise und Life-Hacks

00:09:2300:09:23 Oh damn, ich bin so heißen Kaffee gar nicht mehr gewohnt, weil ich habe lustigerweise wirklich einen Kurs gemacht, einen Barista Latteart Kurs und trinkt deswegen seitdem nur noch Cappuccino und wenn man Cappuccino richtig macht, hat der 60 Grad und dann kann man den instant trinken. Übrigens auch so absoluter, also einfachster Trick, also ich bin mittlerweile so extrem judgy, was Cappuccino angeht oder allgemein Milchgetränke. Ich bin wirklich, ich bin die Art von Bastard.

00:09:52 die sagt, es gibt nicht nur einen Unterschied im Milchschaum zwischen einem Cappuccino und einem Flat White, es gibt auch einen Unterschied in der Art, wie der Kaffee gemacht wird, ob es ein Ristretto ist oder ein Espresso. So, die, die Level von Picky bin ich mittlerweile. Und das findest du halt fast nirgendwo.

00:10:19 Jemand, der auf dem Niveau Kaffee macht. Also erst recht nicht diese ganzen Cafés, wo man eigentlich zum Torteessen hingeht und der Kaffee nur so ein Beiberg ist. Deswegen hier an dieser Stelle der absolut einfachste Check, ob ihr testen könnt, ob das Café, wo ihr gerade ein Cappuccino bestellt habt, ob da tatsächlich Leute sind, die Ahnung haben.

00:10:40 Oder halt einfach nur Leute, die eine Siebträgermaschine bedienen und nichts können. Hier der einfachste Hack, wo man noch nicht mal irgendwie die Textur des Schaums untersuchen muss. Oder die Art der Tasse. Oder ob man exakt dasselbe Getränk bestellt. Egal ob man ein Cappuccino, ein Flat White oder ein Cortado bestellt.

00:11:10 Ihr nehmt diese Tasse Kaffee oder Cappuccino und nehmt einen Schluck. Müsst nicht irgendwie die Nase erst reinhalten, wie bei einem Whisky. Oder ihn irgendwie wippen, wie ein Wein, was auch so geil ist, ne? Leute mit Weinkläsern, die den hier machen.

00:11:27 Das ist ungefähr auf demselben Leute wie Leute, die mit der Pipette Wasser in Whisky machen. Unabhängig davon, welcher Wein es ist und unabhängig davon, welcher Whisky es ist. Deswegen an der Stelle noch ein anderer Connoisseur-Life-Hack. Mit der Pipette Wasser in Whisky machen. Wenn das ein rauchiger Whisky ist, hast du keine Ahnung, was du tust. Aber zurück zum Kaffee. Hier der absolute Hack, um schon mal sicherlich...

00:11:53 80% der Cafés da draußen einfach als Scheiße klassifizieren zu können, ohne überhaupt eine Ahnung von Kaffee zu haben. Cappuccino ist ab der Sekunde, wo er hergestellt wurde, trinkbereit. Wenn der heiß ist, so heiß, dass er nicht mehr angenehm ist, dann ist er schlecht zubereitet. So einfach ist es.

00:12:17 Milch geht kaputt, wenn man sie zu hoch erhitzt. Das macht man nicht. Der Schaum wird nicht besser, wenn man den über 60 Grad erhitzt. Deswegen macht man einfach 60 Grad. Und gut, dann kann man den auch sofort trinken. Und deswegen fand ich das gerade krass, weil ich hier halt kochendes Wasser reingekippt habe. Weil mit dem Cappuccino komme ich nicht weiter. Hält nicht lang genug für so einen Livestream. Das Wasser mit der Pipette ist nicht dafür da, um den Whisky zu verdünnen. Wenn du Whisky verdünnen willst, pack einen Eiswürfel rein.

00:13:00 Ah, deswegen hat meine Wasserkocher eine 60 Grad Taste. Genau. Aber weil ich viel Wissen habe. Aber knausig bin, habe ich sowas nicht. Aber ich habe ein Newsletter, sehe ich hier gerade. Das ist ja bildet. Was ist das? Da kann man sich... Kann man da draufklicken? Boah, krass. Maximal eine Mail pro Monat. Meinte der maximal eine Mail pro Monat oder pro Jahr, der Chatbot? Das ist eigentlich das Gegenteil von Spam. Ich schreibe ja auch keine Newsletter. Easy. Verdünn dich, aber Aroma eröffnen. Ganz genau.

00:13:40 Und deswegen macht man es übrigens auch nicht in rauchigen Whisky, weil was du damit nur schaffst, ist, dass du die... Wie ist das? Also jetzt kommen wir in den Chemiebereich, da bin ich dann raus. Aber das Wasser lässt doch irgendwie, also wirkt sich irgendwie auf die Alkohol-Kühler oder irgendwas aus. I don't know, aber auf jeden Fall wirkt es sich genauso auf den Rauch aus. Dein Whisky wird dann undrinkbar.

00:14:07 Oder so. Dieses gefährliche Nischenwissen. Man weißt, warum man Dinge tut, aber die inneren Prozesse kann man nicht erklären. Genauso wie jemand, der nur mit AI codet, by the way, wo wir full circle jerk wieder am Anfang des Streams wären, ey. Ach ja, ey. Wunderschöne neue Welt, wo alles AI-effizient wird. Ich möchte ehrlich mit euch sein. Ich habe zwei Hände. Wollte ich einfach mal einwerfen.

00:14:39 Das haben wir alle nicht kommen sehen. Also sind wir mal ehrlich, also das haben wir alle so nicht kommen sehen. Als dieser ganze Chatkram angefangen hat, mit ChatGBT und so weiter, dass wir jetzt so Agenten haben, die Dinge tun, das hätte man schon kommen sehen können. Weil das ist einfach nur Basic Informatik, wenn man etwas hat, was intelligente Aktionen ausführen kann.

00:15:07 Intelligent ist jetzt sehr weit gefasst, da fasse ich nämlich auch ein Skript rein mit einer For-Loop, also alles, was irgendwie Turing vollständig ist. Dann gibst du den Dingen eine Eingabe und eine Ausgabe und dann macht es Dinge. So funktioniert Basic Computer. Und wenn man jetzt ein Sprachmodell hat, dass man dem eine Eingabe und eine Ausgabe gibt und dann macht es Dinge, das ist jetzt keine Magie. Also deswegen, Agenten hat man kommen sehen, auch solche Dinge wie MCP-Server hätte man kommen sehen können. Ich persönlich finde es übrigens eine der besten Entwicklungen seit langem.

00:15:36 Ich als, nee, also Hasser ist ein hartes Wort, verachte auch nicht. Kritiker eigentlich auch nicht, nur halt einfach nicht dumm mit den Augen zu jedem Hype hinterherlaufer.

00:15:48 Ich meine, ich nutze auch täglich AI. Jeder von uns nutzt das mittlerweile. Aber auch absichtlich tue ich das mittlerweile. Aber man muss nicht jeden Hype wirklich mitnehmen. Also außer natürlich, man verdient sein Lebensunterhalt mit YouTube. Dann hat man leider keine Wahl. Das war ein bisschen Sklave des Systems, aber das tue ich ja zum Glück nicht.

MCP-Server Revolution

00:16:1200:16:12 Aber trotzdem finde ich diese MCP-Server-Entwicklung sehr geil. Also wer das nicht mitbekommen hat, MCP-Server, was ist das? Einfach eine Möglichkeit, Sprachmodellen Zugriff auf Anwendungen zu geben. Und wer jetzt sagt, hä, ist das nicht exakt dasselbe wie eine API? Dann sage ich, ja, aber das haben diese Hype-Menschen nicht so gerne, wenn die was Neues erfinden und man ihnen dann sagt, hä, das gibt's doch schon. Deswegen ist es nicht dasselbe wie eine API, okay?

00:16:39 Es ist eigentlich nur eine API mit bisschen mehr Dokumentation, aber es ist keine API. Okay? Für uns alle, die natürlich Programmieren nicht vom Chatbot gelehrt bekommen haben, ist es natürlich saugeil, weil über MCP-Server jetzt auf einmal alles eine Schnittstelle bekommt. Und vor allem auch Dinge, von denen ich nie gedacht hätte, dass sie mal eine Schnittstelle bekommen. Die haben dann auf einmal einen MCP-Server. Nicht, weil das immer notwendig. Oh.

00:17:10 sinnvoll wäre, sondern wegen AI. Das ist fein, wie man diese Stelle hier bitte einfügen. Nichtsdestotrotz ist es natürlich saugeil, wenn man Dinge auf einmal fernsteuern kann. Und ein Beispiel für so eine Fernsteuerung habe ich ja mitgebracht. Und das ist meiner Meinung nach tatsächlich ein richtig krasser Paradigmenwechsel. Wer nämlich jetzt auch einen MCP-Server unterstützt. Ich will mal kurz eine Sache testen. Da reden wir nämlich gleich noch drüber.

00:17:51 Bin mal gespannt, dass das passiert. Ob das geil ist oder nicht so geil. Wie gut integriert das OBS? So. Okay, cool. Ein schwarzer Block. Nice. Was ist da auch noch mehr? Ne, ne? Das war es auch schon. Okay. Oh, wow. Ah, okay. Jetzt tu das. So, guck mal hier. Das ist ja mal sau fancy.

00:18:39 Das ist saugeil. Alter. Ich bin impressed. Oh mein Gott. Okay, Leute. Das wird jetzt Gold. Nein. Oh mein Gott. Okay, das ist absolut mein Humor. Wenn ich jetzt hier einen... Ja genau, das hat keine Transparenz.

00:19:22 Ich wusste nicht und das finde ich gerade wirklich krass. Also eigentlich wollte ich nur wissen, wie gut die Fensteraufnahme ist, weil ich da eventuell bald Pläne habe. Sie funktioniert tatsächlich beeindruckend gut. Gut natürlich, der Schatten wird nicht gecaptured, aber da gibt es ja sicher Plugins, die sowas können oder kann ich irgendwie einen Effektfilter...

00:19:43 Naja, aber als ob es nicht irgendwas gibt, was nicht in Schatten suchen kann ich mir nicht vorstellen. Das coole ist, dieses Ding hier, was über mir liegt, das hat tatsächlich in echt einen Transparenzeffekt. Und zwar hier den Aero, was ursprünglich mal mit Windows Vista eingeführt wurde. Wurde ja mittlerweile 10 Ecken verbessert und Windows 7 kann das immer noch. Und diese Konsole hat diesen Effekt, ich kann das mal eben kurz zeigen.

00:20:11 Hier, man sieht das, wenn ich verschiebe, dass man so ein bisschen den Hintergrund noch durchsieht. Und dieser Effekt, der wird tatsächlich vom Capturen vom OBS, wird der, also wird der auch gehalten und ist dann tatsächlich wie ein Transparent. Das ist ja saulag. Das ist saugeil. Das ist echt, also das macht mich, macht mich happy. Also vor allem, weil der Joke halt unglaublich lustig ist, dass ich hier...

00:20:41 Das muss ich erstmal ein bisschen entschlüsseln hier. Rainfuck. 2 hoch 6 plus 2 hoch 3. Das ist true. Danke für den Sub. Ja, okay, das wollte ich eigentlich gar nicht zeigen, aber ich finde es gerade irgendwie ein bisschen feierbar. Was ich eigentlich zeigen wollte...

StreamDeck und MCP-Aktionen

00:21:0300:21:03 Ich hab hier ein Stream Deck und das heißt einfach MCP Actions. Vielleicht habt ihr den April Joke mitbekommen von Elgato mit dem Elgato Lever. Und ich dachte mir so die ganze Zeit so holy fuck, das ist eigentlich eine saugeile Idee, ich hätte das gerne. Und dann kam kurze Zeit später ein Plugin von einem anderen Hersteller auf den Markt, der konnte über Dinge, die im Stream passieren, also Code Overflow, zu mir ehrlich, also.

00:21:33 das, was wir schon vor 15 Jahren erfunden haben, kann der Stream Deck Actions fernsteuern. Und dann wurde ich sehr, sehr hellhörig, weil tatsächlich bin ich mal, ich weiß nicht, wie viele Jahre das her ist, viele Jahre, da bin ich zu Elgato gegangen, also wirklich physisch, weil es war nämlich auf der Gamescom und habe gesagt, ich hätte gerne zwei Dinge. Das erste ist Drehregler an Stream Decks und das zweite ist eine Möglichkeit, wie ich extern Stream Deck Actions triggern kann, weil euer Ökosystem

00:22:02 Das Button- oder Actions-Ökosystem ist das mächtigste, was es überhaupt gibt. Da gibt es Plugins für alles. Da ist ein riesiger Marktplatz hinten dran. Der ganze Kram ist in großen Teilen kostenlos. Die Einstiegs-Barrier ist mittlerweile quasi nicht vorhanden, weil du kriegst gebrauchte Streamdecks für... Und auch die neuen Streamdecks sind in einer Vielzahl verfügbar. Die gab es so noch nie. Also das ganze Ökosystem und das Angebot, das wächst ja bis ins Unendliche. Aber...

00:22:34 Um...

00:22:36 Was mir halt, also was dann kurze Zeit danach kam, war Drehregler an Streamdecks, by the way. Deswegen bin ich so ein Streamdeck Plus Fan, weil ich das schon haben wollte, bevor sie es angekündigt haben. Und dann kam es. Aber das andere Feature, auf das habe ich wirklich ewig warten müssen. Aber durch die Macht von AI kam es nun endlich. Denn man kann jetzt, also Streamdeck ist auch gleichzeitig ein MCP-Server. Das ist ganz einfach einzustellen. Muss einfach nur hier MCP.

00:23:06 Aktionen aktivieren und dann kann jeder Hayopai Stream Deck Aktionen ausführen. Und das ist ein Game Changer.

00:23:21 Faire Weise muss man sagen, ich hätte das auch nachprogrammiert bekommen mit Virtual Stream Decks, weil man ja verschiedene Stream Decks spawnen kann und dann einfach einen Klick ausführen. Also damit hätte ich dann über Auto-Hotkey auch genau dieselbe Funktionität gehabt, aber natürlich UI-Manipulation ist immer hässlicher. Geiler ist es, wenn man MCP-Actions zum Beispiel nutzen kann, um direkt Stream Deck-Kommandos auszuprobieren. Und das habe ich tatsächlich vorbereitet für den Stream, gerade eben, denn ich bin schon seit halb...

00:23:50 Ne, seit 7 Uhr wach. Habe ich das tatsächlich mal getestet und möchte euch das mal eben hier kurz live im Stream vorbereiten. Und ich weiß, also ihr müsst euch jetzt ein bisschen festhalten, ne? Das hier ist tatsächlich nicht nur ein Livestream, sondern das hier ist ein Livestream, wo ich sogar Dinge für vorbereitet habe. Und zwar mehrere Stunden lang Dinge vorbereitet habe für. Und wenn das euren Sub nicht wert ist, dann weiß ich nicht, was es wert ist, um ehrlich zu sein, meine Damen und Herren. Danke für den Kaffee.

00:24:19 Sind sie krank nicht mehr aber die allergie hat so hart gekickt er ist er lag ein ganzes wochenende lang flach also nicht flach also ich war körperlich einsatzbereit aber ich habe gerotzt in den guten alten disco zahlen okay folgendes müssen erstmal den server starten dafür brauche ich mal eben so eine konsole weiß nicht wo ich meine hin gemacht habe die hier zum beispiel wollen wir uns mal die hier so und dann muss ich lernen wie man diesen server startet ich weiß nicht wo der link hingeht

00:24:57 Ah, guck mal, der ist doch ganz schön, der Link hier. Also was ist das von Kommando? NPX, alles auf Ja. Das hier ist das NPM-Paket. Und das Argument ist Minus Minus HTTP. Okay, ja, von mir aus. Dann nehmen wir das mal. Der würde sowieso das wahrscheinlich in den Wochenendorf ausführen. Noch ein Minus V dazu. Nöpi, ist hier Zap, dank Melon. Dankeschön. Zack.

00:25:27 So, ein MCP-Server, MCP-Bridge. Ich kann mir vorstellen, warum. Wahrscheinlich ist es leichter, das über eine Bridge zu machen, als es direkt in Streamlack rein zu coden in die Software. Oder es ist eine absichtliche Indirektion. Ich weiß es gar nicht, warum es nicht direkt Teil davon ist. Aber jetzt haben wir hier einen Server am Laufen. Und man kann auch checken, ob der tatsächlich existiert.

00:25:59 Das habe ich schon getestet hier. Localhost Health. Da. Also er funktioniert. Er existiert. Sehr gut. Und dann habe ich angefangen Dinge vorzubereiten. Und jetzt wird es spannend, weil jetzt kommt der gute alte Post. So.

00:26:24 Also, als allererstes müssen wir den Spaß mal initialisieren. Ich möchte nicht updaten, danke schön. Ich habe hier Header. In diesem Header steht, dass ich JSON hinschicke und JSON und Events-Stream zurückbekomme. Server-Site-Events oder halt eine direkte JSON-Antwort. Und im Body habe ich, das muss ich mir erst zusammen glauben, die Art, wie AI-Agenten mit Servern interagieren.

00:26:54 Das ist halt so definiert. Was soll ich machen? Mein Programm heißt übrigens manuelltest und ist in der Version 1.0.0. Wenn ich das da hinschicke an diesen MCP Endpunkt, dann bekomme ich tatsächlich was zurück. Und was ich da zurückbekomme, ist mir scheißegal. Was mich wirklich nur interessiert, ist dieser Header. Denn da drin steht eine Session-ID und die brauche ich.

00:27:18 Das, was ich jetzt hier gerade manuell mache, könnte man natürlich programmatisch machen. Das ist ja logisch. Jetzt kann ich damit in List Actions gehen und dann, wie seht ihr, das ist eine ID von vorhin, und dann wieder denselben Dinger hinschicken. Dieses Mal gebe ich ab in Body einen...

00:27:37 Tools Call auf. Ich habe hier schon einen Schritt übersprungen, denn eigentlich müsst ihr erstmal ein Tools List aufrufen. Da würde man dann sagen, dass das GeneVac zwei Aktionen bereitstellt und zwar einmal Get Executable Actions und Call Executable Action oder irgendwie sowas oder Execute Action.

00:27:54 Das habe ich jetzt einfach schon übersprungen. Wir senden direkt das hier. Das funktioniert, weil ich hier die Session-ID von gerade eben verwende. Auch wieder klar, es könnte ja x verschiedene Agenten geben, die das Stream Deck hier fernsteuern. Die haben alle ihren eigenen Kontext. Möchte man voneinander auseinanderhalten. Deswegen haben die eine ID. So weit, so klar. Und hier bekomme ich jetzt schöne Dinge zurück. Das können wir so halber vernünftig formatieren als JSON.

00:28:22 Und was mich hier eigentlich interessiert, ist, dass das hier die textuelle Repräsentation von dem hier ist. Hier wird einfach nur der Browser geöffnet auf skatesm2.de. Und das sehen wir hier auch. Das ist die Aktion vom Typcom Elgato Stream Deck System Website. Und...

00:28:46 Hier steht auch Website. Die Details, die jetzt hier drin stehen, bekomme ich nicht zurück. Also zur Konfiguration und so weiter, würde ich hier nicht sehen. Man kann aber hier tatsächlich auch eine Information hinzufügen, zum Beispiel öffnet die Website, die beste Website im Internet. Punkt. So kann ich Kontext hinzufügen zu meinen einzelnen Aktionen. Und wenn ich jetzt hier reingehe, machen wir das nochmal, dann hier.

00:29:13 User Description öffnet die beste Website im Internet. Und ein AI-Agent wiederum könnte das jetzt parsen und daraus seine nächsten Schritte ableiten. Wir sind natürlich ein H-I-Agent. Agent 007, mein Name. Guten Tag. Ich hätte gerne einen Martini. Und...

00:29:34 Was mich interessiert ist die hier. Das ist nämlich die ID von der Aktion. Und jetzt wird es cool, jetzt gehe ich nämlich hier in MCP Execute. Die habe ich schon vorbereitet. Ich habe keine Ahnung, ob die ID sich geändert hat. Nö, die sind konstant. Die werden wir uns auch noch gleich genauer angucken. Dann gucken wir gleich mal einen Speicher rein, was das eigentlich ist.

00:29:52 Und jetzt ist das Streamberg Execute Action. Ich muss mir auf jeden Fall meine Session-ID klauen. Ich würde mal behaupten, die von vorhin existiert nicht mehr. Schon eine Weile her, irgendwann dürfen die ja... Naja, so long story short. Zack, das ist meine Website. Und jetzt sagt der ihr, ja okay, cool, eine Website aufmachen. So, weiß ich nicht. Kennst du Fetch? Dann sage ich, okay.

00:30:18 fairpoint aber hör auf so scheiße kritisch zu sein was soll das sei mal freundlicher dann gehen wir doch mal auf mein stream weg und dann nehmen wir doch mal das ding hier was ist das das ist ein wechsel auf live irl so heißt die szene wenn ihr mein gesicht groß seht ok so den kollegen hier den kopieren wir jetzt mal dann gehe ich in meine mcp actions rein jetzt haben wir den kollegen hier

00:30:46 Jetzt führe ich diese Kommandos nochmal aus, also erstmal send. Jetzt bekomme ich hier einen zweiten zurück und zwar ist eines ComElgato OBS Studio heißt das Plugin offenbar. Ich finde es immer wunderschön in so Repräsentationen reinzugucken.

00:31:06 Der nächste Schritt ist ein Python-Skript, das durch Stream Deck-Tasten gesteuert MCP-Einfragen an Elgato-Software stellt. Naja, also die Realität ist natürlich, dass du damit jetzt auch nicht Elgato Stream Deck-Stream Deck bauen könntest. Natürlich ist Elgato nicht dumm. Also, ich meine, in die Stream Deck-Software kommst du ja trotzdem nur rein, wenn du ein Stream Deck hast. Also, wie virtuelles Stream Deck auch. Und aktuell ist es auch noch beschränkt auf 32 Tasten. Aber ich bin gespannt, wo die Reise hingeht. Also, ich meine, Wavelink, die Software, die...

00:31:35 Also das muss ich noch nicht mal Werbung dazu sagen. Die beste virtuelle Audio-Kanal-Software auf dem Markt. Period.

00:31:43 Die ist mittlerweile kostenlos. Und das ist schon ein ganz schönes Statement. Keine scheiß virtuellen Audiokabel oder so noch an Rans mehr, sondern direkt eine gute, vernünftige Software. Sobald es soweit ist, dass die nächste Generation von Audioprodukten, ich meine, die wurde schon angekündigt, dann gibt es auch schon einige Sachen zu kaufen, aber sobald die wirklich unumfänglich eingesetzt wird, Leute, ich gehe all in Audio Nerd. Ich habe so viel zu erzählen. Aber das ist eine andere Geschichte.

00:32:12 Wenn du wüsstest, so ein Gobster, ey. Wenn du wüsstest. Ich habe eventuell persönlich mit Ingenieuren gesprochen. Das hier ist eine ID, würde ich sagen, oder? Dann nehmen wir doch einfach mal diese wunderschöne ID. Eine der besten IDs. Ich versuche den Trump zu inventieren. Also, die allerschönste ID. Ihr habt noch keine ID gesehen, die so schön war. Okay. So, jetzt schmeißen wir die in Execute rein.

00:32:50 Und wenn jetzt gleich mein Gesicht groß wird, einfach nur, weil ich einen, ich möchte das nochmal festhalten, eine HTTP-Request starte, dann ist das ziemlich geil. Ich möchte nicht lügen, dieser Moment jetzt hier gerade, diese letzten drei Sekunden, haben mich sehr glücklich gemacht.

00:33:17 Hä, wie geil ist das denn? Gestatten, hier ist mein Stream Deck, meine MCP-Action Stream Deck. Das hier ist einfach rauskopiert aus meinen über die letzten, keine Ahnung, 10 Jahre gewachsenen Bibliothek an Stream Deck Aktionen, weil, naja, ich hab so ein paar und angeschlossen und die können sehr viel und ich hab sehr, sehr viel Zeit hier reingesteckt. Und das ist eine richtige Bibliothek für mich an Sachen, die ich eben so einsetze. Aber...

00:33:45 Dass ich einfach mal eben eine dieser Aktionen, nur eine, hier rüber kopiert habe und sie einfach so triggern kann? Scheiße! Das ist so geil! Und jeder AI-Agent könnte das jetzt übrigens, ne? Aber noch viel besser, ich kann es! Und zwar von überall her! Wenn ich der Meinung bin, dass ich mit... Okay, das ist jetzt auch kein neues Ding, weil Spracherkennung zum Fernsteuern hat der Legato auch schon angekündigt. Wenn ich der Meinung bin aus einem Auto-Hotkey-Skript...

00:34:16 Oder wenn ich das Licht hier drin anmache, weil ich einen Home-Server da habe, der über Home Assistant meine Philips Hue abfragt und wenn sich da ein Zustand ändert, dann kann ich einen Stream der Reaktionen. Das ist einfach so. Nochmal, in der Informatik haben wir Funktionalität, Algorithmus oder KI, was auch immer. Wir haben Eingabe, Ausgabe. So funktionieren Dinge. So funktioniert auch ein Roboter, by the way. Eingabe, Ausgabe, Denken zwischendrin.

00:34:48 Elgato hatte immer diese Ausgabe, aber nie die Eingabe. Und jetzt kann ich das fernsteuern, das ist einfach ein.

00:34:56 Das ist das ist auf dem selben level abgefahren wie drehregler auf stream bags aufzubauen for real das ist ein Riesen meilenstein das kann man gar nicht so weit so so vorhersagen jetzt kommt der joke Wisst ihr seit wann das in der stream weg software drin ist es gefährliches halbwissen ich bin mir ziemlich sicher das kann über das erste april update das müssen wir mal kurz sicherstellen ob das wirklich so ist und ich glaube es gab wirklich über das erste april update mit dem lever

00:35:24 kam das mit rein. Alter, es ist der Wahnsinn. Es ist für mich ein Feature, was ich seit der Gamescom 2022 kann. Kann das sein? Muss, ja. 2022. Da war eine Gamescom, oder? Wenn da eine Gamescom war, dann will ich das seitdem haben. Boah, ey. Das ist wild. NGL. Not gonna lie. Das ist wild.

00:35:59 Und dann hat die Unicorn auch subscribed. Ebenfalls. 2022 war keine Gamescom, aber 23. I don't know. Oder war das noch vor Corona sogar? Ich mache mich jetzt nicht fertig. War das 2019? Wie sind Drehregler limitiert? Alle Drehregler kann ich nicht triggern. Aber ich kann natürlich lange schreiben, die Drehregler abgreifen. Das habe ich auch schon gemacht. Und dann die Unicorn dann geprennt. Krass, Leute. Krass, krass, krass. Das habe ich so noch nicht getestet. Ey, das ist ja sowas von geil.

00:36:36 Ich habe übrigens auch nicht lange gebraucht, das aufzubauen, weil ich mir natürlich von einem Chatbot habe helfen lassen, wie die Requests auszusehen haben und so weiter. Das fange ich doch nicht an zu googeln. Welche wahnsinnig. Für mich ist Corona immer zwei Jahre vor dem aktuellen Jahr bis 2019 zurück und nichts hat stattgefunden in der Zeit. Ja, ist irgendwie alles. Vielleicht war die 19. Wann ist denn? Warte, ist doch ganz einfach. Müssen wir einfach nur gucken. Stream Deck plus Release.

Premiere UXP API Experimente

00:37:1100:37:11 Date. Sicher, dass 2022 keine Gamescom war? Weil, also vom zeitlichen würde das schon echt zusammenpassen. Marki, danke bei 71 Monate. Gamescom 2022. Also das sieht für mich schon auch irgendwie nach Personen aus. Ja, also absolut wild, absolut wild, Leute.

00:37:56 Kommen wir von absolut wilden Dingen zu absolut wilden Dingen, würde ich mal sagen, oder? Ich hatte ja das letzte Mal angefangen, so ein kleines Premiere-Projekt zu starten, was mich eventuell längere Zeit begleitet. Und bevor wir da jetzt gleich reingehen, weil auch da möchte ich nämlich heute die Grenzen austesten, was so möglich ist. Was zum Fick ist ein Treasure Train? Wow, das ist ein seltener Treasure Train. Erreiche bei diesem Train Stufe 2 und dann ist die Animation weggegangen.

00:38:28 Es gelten Bedingungen. Unlocke Limited height 35% off Gift-Saps at Level 2. Are you sure, Twitch? Das es ein Treasure Train ist. Und nicht doch ein Trash Train. Also, die macht... Also, ich habe ja schon vor kurzem die Gamification und die Dinge, die auf Twitch aufgebaut sind, ein bisschen kritisiert, ne? Don't get me started, du.

00:39:02 Lad es laufs, was du musst? Hates Train, ja, das ist ein besserer Name. Dankeschön für die acht Monate.

00:39:11 Genau, wir haben angefangen in Premiere ein Plugin zu bauen und da möchte ich heute eine größere Demo mal austesten und dann auch noch zwei Tests laufen lassen, um so ein bisschen die Herausforderungen und Möglichkeiten auszuchecken. Weil ich sag mal so, ich habe natürlich, weil ich nicht mehr selbstständig denken kann, eine Fähigkeit, die ich in den letzten Wochen und Monaten immer weiter durch AI ersetzt habe, habe ich anstatt selbstständig zu denken, mich mit einem Chatbot über mein Projekt unterhalten.

00:39:40 Warte, ich mach hier so eine strategische Pause, damit alle so ein bisschen innerlich rage'n können. Ich geb euch noch ein paar Sekunden und trinke so langen Schluck Kaffee. Und weil die künstliche Intelligenz meiner eigenen mittlerweile deutlich überlegen ist, wurde ich darauf hingewiesen, dass es da so technische Implikationen gibt in dieser neuen Programmiersprache oder in dieser neuen Umgebung UXP, die ich so noch nichts... BALA M-DASH! Alter!

00:40:14 Made my day, Alter. Den droppe ich demnächst einfach mal so random. Lasst mich an dieser Stelle einen verbalen M-Dash machen. Alter, das ist ja so geil. Also für alle, die sich gerade wirklich checken und denke, hat der Junge sie noch alle? Also die Antwort ist nein. Aber ein M-Dash ist das Ding hier. Das.

00:40:49 Ist ein M-Dash. Ja, diese Striche haben... die haben Namen. Das Ding heißt M-Dash. Finja, vielen Dank für den Sub. Lass mich an dieser Stelle einen verbalen M-Dash machen, ist das geil. Also auf jeden Fall, da möchte ich rumproben. Ich weiß gar nicht mehr, über was ich eigentlich rede. Ich bin so raus, ey. Da hab ich gekillt. Blockschrott, Dankeschön. Das heißt, so dumm.

00:41:26 Ich weiß nicht mehr mal über was ich geredet habe. Egal, so wir öffnen jetzt Premiere. Also es ähm folgendes, es gibt so ein Premiere UXP Samples Projekt. Versuch das geil aufzumachen, bevor ich euch den Bildschirm zeige damit es so aussieht, als wäre ich auch da vorbereitet. Aber nein, ich bin ja eigentlich voll dran ehrlich, also guck ich mal, was ich vorbereitet bin. So. Ähm. Premiere Pro UXP API Documentation bla bla bla bla bla. Ähm.

00:42:11 Das Ding kann einiges und da möchte ich einfach mal so ein bisschen...

00:42:17 ein gespür für bekommen was diese api so alles kann da müssen wir noch mit einem weiteren prozentierter umspielen genau also das liegt hier irgendwo das ist ein projekt und ich nehme mal an ich kann das da können wir auch mal gleich testen ob man die dinge auch einfach vernünftig in die wsl klonen kann und dann trotzdem sich über premiere daran hängen haha das ist das ist hart so also

00:42:50 Kleines Spaßprojekt von mir. Nein, da werde ich leider nicht reich. Ups. Man sollte Sachen nicht doppelklicken. Subkopfschade, wieder ein bisschen zu viele Punkte übrig. So, gucken wir doch einfach mal kurz rein. Okay, ich gehe kurz rein. Port of the Popular. Es ist lustig, dass sie selber sagen, dass es Popular war. Es ist so ziemlich das Einzige, was man hat.

00:43:33 Also ja, du bist der populärste, wenn du der einzige bist. Dieses Projekt war so die einzige Möglichkeit überhaupt rauszufinden, wie man... Naja. Ähm... In HTML und dann Bild HTML. Okay, kriegen wir hin. Die Frage ist, also das sieht man übrigens wieder, dass das keine Entwickler gemacht haben, die da nativ unterwegs sind. Weil die hätten einfach ihren CD gegeben. Ach, sieh an!

00:44:21 Das ist eine Nische, die ich komplett ausfülle.

00:44:55 Ich liebe übrigens dieses Wie. Wie ist einfach so wunderbar kritisch. Es hat so einen wunderbaren Sarkasmus, finde ich, aus Verzeichen wie. Weil da steht nämlich, was ich gemacht habe und dann, warum es die Frage nicht beantwortet. Das ist so dumm, weil jeder denkt so, das hat er im Studium gelernt. Nein, nichts davon habe ich im Studium gelernt. Das hat mir alles selber beigebracht. Im Studium habe ich gelernt, wie ich.

00:45:22 Besinnung verlieren. Wir promovieren dann, wie ich Leute betreue, die die Besinnung verlieren. So, was macht das Schönes? NPM run clean, copy, compile. Okay, da passieren offenbar Dinge. Also ist das Studium unnötig. Nö. Aber nicht ausreichend. Hallo. Junge, es sind nicht so viele Abhängigkeiten. An was scheiterst du gerade? Ist da irgendwas dabei, was irgendwie so fünftausendisch Abhängigkeiten hat oder was?

00:46:54 Wo ist denn das, Node-Modules? Hä? Was machst du gerade so lang? Ja, ich beleidige meinen Node-Modules-Ordner. Macht ihr das nicht? Mit du, HS? Also ich finde, nach oben und Enter ist deutlich schneller als Watch einzugeben, aber... Also for real. Irgendwas ist da ganz arg broken.

00:47:59 Ich klaue euch mal eben kurz den Bildschirm, bevor ich hier in irgendwelche Lockdateien reingucke. Oh ja, ich sehe auch schon, was da broken ist. Habt ihr es auch gesehen? Ich fixe das eben und zeige euch dann, was ich gemacht habe. So lange müsst ihr leider mein Gesicht sehen. I'm very sorry. Yeah, boy. Das kam wirklich zu einer...

00:49:12 Zu einem Zeitpunkt, wo ich gerade echt mal eine Sekunde kurz konstruiert, konzentriert auf was drauf geguckt habe. Holy fuck. Alter, war das getimed? Das war wirklich unfair. Kampfzweck, vielen Dank. Du hast J. sehr viel zahlen. Hi, Bye, Go, Dominic, Nevin, Amox, Das, P2, Jonas, XD Player, Techwolf und Sir Black Hunter.

00:49:53 Subs geschenkt. Dankeschön. Das war echt... Dominik bedankt dich direkt. Das ist die richtige... Das ist die richtige Herangehensweise. Also ich hab einen Verdacht, was gerade schiefgelaufen ist. Aber ich krieg die Scheiße gerade nicht zu funktionieren. Was soll das, Alter? Meine Konsole hat sich verabschiedet. Aus Gründen. So, und wo lag der Kram jetzt? Coach, UXP...

00:50:51 Ich liebe Fisch, Alter. Aber gleichzeitig war es auch... Ähm... Potze gleich. Ich hab das Gefühl, weißt du was, ich mach es in Fisch ne Bash auf. Leck mich. Ja, jetzt auf einmal geht es. Also, äh, das Problem ist, dass ich... Also, ich hab's noch nicht 100% erkannt.

00:51:45 Also eins der Probleme ist auf jeden Fall, dass ich in der Fisch-Shell Node-Version-Manager nicht vernünftig aufrufen kann. Node-Version-Manager brauche ich aber, um eine Node-Version aufzusetzen, damit nicht die von Windows genutzt wird. Und das ist nämlich der Grund, warum es gerade nicht durchgelaufen ist. Weil einfach fucking WSL der Meinung war, die Windows-NPM-Instanz zu nutzen, anstatt einfach NPM selbst auszuführen. Und ich verstehe nicht warum, Alter. Einfach direkt Linux nutzen.

00:52:53 Okay, jetzt passiert wenigstens was. Jetzt muss ich nochmal Node-Modules löschen und ich glaube, dann haben wir vielleicht gleich eine lauffähige Version. Ah ja, mein Node-Modules-Ordner wächst jetzt auch übrigens. Cool, cool, cool, cool. Ja, jetzt hängt es wieder an irgendwas oder was. Also manchmal zählt kein EKI-generierter Code als Microsoft Code. Autschee. Also ich kann euch schon mal so viel sagen. Ihr seht nicht viel, aber es funktioniert auch nicht. Und was ich gerade ein bisschen sass finde,

00:54:28 ist, dass da Jahn steht. Eine Jahn-Lock-Datei. Könnte es eventuell sein. Aber das ist nur so ins Blinde reingefragt, dass ich dafür Jahn nutzen sollte. Weil offenbar haben sie nämlich Jahn genutzt. Und nicht NPM. Ja, das habe ich leider... Also jetzt sind wir leider in dem Teil, wo ich nicht mehr vorbereitet habe. Mit Jahn läuft er sogar. Alter. Alter.

00:55:51 Wenn das der Fehler war, dann weiß ich gar nicht, wo ich anfangen soll zu kotzen. Bitte sagt mir nicht, dass das jetzt einfach funktioniert hat. Ich mache noch kurz den Bild. Oh mein Gott. Leute, also die Lösung war, dass man sich nicht an die Dokumentation hält. Ich war so ein bisschen, ich fand es so ein bisschen sass, dass da eine Jarn-Datei rumliegt. Also wenn man einfach, muss ich nicht verstehen, aber here we go.

00:56:31 Ist das geil, ey. Gut. Jetzt habe ich aber theoretisch in BildHTML was liegen. Was genau ist die Ordnerstruktur? Weißt du was? Ich wollte doch vorher mal eine VS Code Instanz. Achso, wir haben ja schon eine VS Code Instanz. Lass uns doch einfach mal reingucken. Hier Premiere API. Da gibt es HTML, da liegt der ganze Source Code drin rum. Und insbesondere auch diese riesige Types. Und dann gibt es Nord Modules.

00:57:11 die jetzt mittlerweile auch gefüllt wurde. Haha. Und dann gibt es hier die gebaute Version. Wobei ich nicht sicher bin, was da jetzt gebaut ist, weil es sieht irgendwie... Achso, da liegt... Ich habe Fragen. Was genau macht... CP-CLI? Was bist du? Okay. Hä? Why? Average NPM Experience. Es ist so. Es ist so, Alter.

00:58:39 Also das ist schon wieder das ist the most npm thing ever alter Why, alter, why? Komplett npm und Node Entwicklung ist einfach so severely deeply broken Junge das mach ich einfach nur fertig, was, was, wie, wie, wie, warum? Dieser Schritt ist auch voll geil definiert, ne? Compile führt einfach TSC aus

00:59:18 Cool, cool, cool, cool, cool, cool, cool, cool. Und was bist du? Was macht Fix Imports? Gut, auf der anderen Seite muss man sagen, also wir sind genauso schuldig, ne? Ich habe ja auch, ähm, manuell, eigenen Buildcode damals bauen müssen für meine Sachen, also deswegen, äh, da kann man jetzt die nicht, nicht, äh, einfach blind blamen für. Ah, hier.

01:00:16 Ja du ne, also du, ich lass alles auf mich zukommen. Ich hinterfrage nicht. Ich weiß einfach nur, wir müssen jetzt noch in unserem UXP Hools, was aus irgendeinem Grund Weird Vollscreen startet, okay. Müssen wir noch den Pfad da einfügen.

01:00:38 Als Add-Plugin unter dem Pfad. Okay, cool. Jetzt wird es natürlich ganz besonders spannend. Welcher Pfad ist das mit? BildHTML und okay, also CT. Wo bin ich denn? Gibt es hier eine Manifest, ja? Also ich bin gespannt, was passiert. Weil das ist ja nicht der Pfad, den ich will. Was ich eigentlich will, ist Weltfrieden. Aber gleich als nächstes hätte ich gerne einen Windows-Pfad auf den Ordner.

01:01:32 Guck mal hier, bisschen, bisschen anderer Pfad ist das. Jetzt bin ich gespannt, ob das funktioniert. Weil ich meine, technisch gesehen liegt das ja auch einfach nur auf einem Verzeichnis. Also, äh. Das war zu einfach. Ja, weil kein Premiere-Instand läuft. Yes is night. Scheiß dich nicht, ey. Sorry. Ich schaffe im schwäbischen Unternehmen, weißt du. So, das ist mein letztes Video. Das kennt ihr vielleicht. Wenn ihr es noch nicht gesehen habt, habt ihr auf jeden Fall was verpasst.

01:02:32 Da baue ich Dinge und so. Wir machen mal bei diesem wunderschönen Diagramm da gerade Pause. Perfekt. So, jetzt sollte der Käse aber laufen. Load and watch. Geil. Oh, geil, Lon. Look at this beauty. Okay, okay, okay. Dann gucken wir doch mal. Set Video Track Name. It's not a function. Perfekt.

01:03:18 Close Sequence. Okay, also wir haben jetzt aktuell... Ich drücke jetzt einfach mal auf ein paar Buttons, um zu gucken, ob das geht. Also gerade haben wir 136 Main auf. Ich mache jetzt mal Close Sequence. Type Error. Sequence is not a function. Weiß ich jetzt so nicht. Also geht irgendwie auch nicht. Probieren wir mal irgendwas anderes. Add Keyframe. Das hat funktioniert. Und tatsächlich hat sich das hier auch verändert dabei. Ich weiß nicht genau, was ich getan habe.

01:03:54 Active Project ist 135 Studio Tour. Active Sequence ist 136 Mac. Okay, also manche Sachen funktionieren. Ich habe sehr viele Sequenzen. Auch richtig. Get Sequence Settings. Also eigentlich bin ich, um ehrlich zu sein, also schön, dass ich hier, also ich drücke gerade auf Tasten. Mehr, mehr mache ich nicht. Du hast ein Backup von dem Projekt. Eins. How about 20? Aber ja, also, ne, funktioniert.

01:04:34 Ich bin eh nur auf eine Funktion scharf. Ich sag's euch wie es ist. Aber... Also es funktioniert. Man kann irgendwie... Get Project Items. Jo, genau. Ganz, ganz viele verschiedene Sachen. Cool. Get Selected Project Items. Zack. Project Items not found. Perfekt. Ah, muss ich so eins auswählen. Oh, nice. Was können wir noch Schönes machen? Save Project.

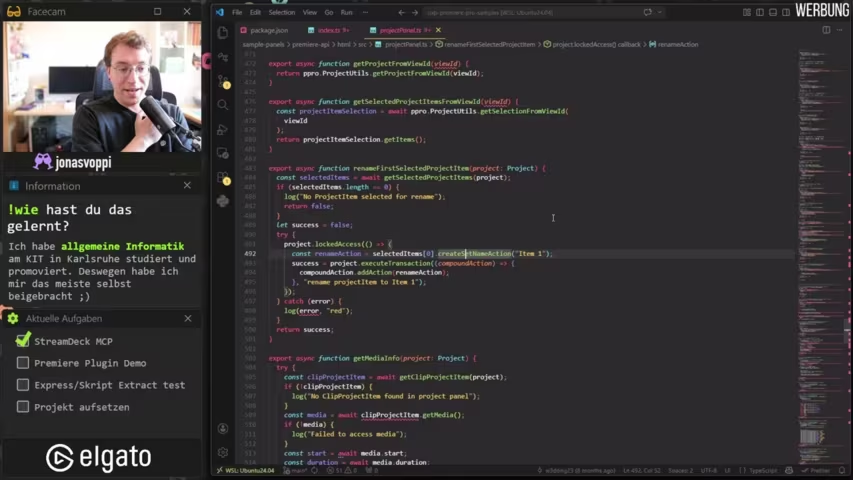

01:05:13 Get current graphics white luminance. 100. Okay, cool. Cool, cool, cool. Add chapter marker. Was habe ich jetzt getan? Weiß man nicht. Okay, cool. Get XMP metadata. Copy to your clickboard. Nett. Was wurde in mein Clipboard kopiert? Okay. Ich unterfrage das nicht. Was haben wir noch Schönes? Rename first selected project item.

01:06:04 Zu Item 1. LOL. Es heißt jetzt Item 1. Jetzt natürlich die ganz große Frage. St. Z macht es wieder rückgängig. Oh, nice. Das interfert sogar nicht mal mit der... Weißt du was? Wir gucken uns den mal genauer an. Rename first selected project item. Rename first selected. So. Das ist ein SP-Button. Und das hat diese ID. So. Hier wird ein... Wer bist du? Utils.

01:07:06 Es ist übrigens schlechter Stil, einen Funktionsaufruf hinter einem unbenannten Funktionsaufruf zu verstecken. Aber das Prinzip dahinter ist das Principle of Least Surprise. Hatte wieder was gelernt für eure nächste Klausur. Denn ich bin surprised und das ist schlecht. Ich sollte nämlich nicht surprised sein. Und hätte ich Document Query Selector bla bla bla gelesen, dann hätte ich sofort gewusst, was Sache ist. Aber Register Click, da bin ich verwirrt.

01:07:45 Du willst, dass ich über die Alternativen zu einem Stream Deck rante? Sehr gerne. Also nicht nur Rant, sondern also eine objektiv absolut nicht beeinflusste als Elgato-Partner Meinung, die ich aber so formuliere, dass sie jeder, der bei Verstand ist, als kann man nicht wegignorieren, hat, der schon recht akzeptieren muss. So einen Rant willst du? Kriegst du gleich. Aber erst muss ich noch in diese Funktion hier reinschauen.

01:08:17 Junge, wer hat das programmiert? Ich glaube es ja nicht. Wenn ich so etwas, also ich habe ja auch wirklich viel Erstsemester-Code in meinem Leben schon gesehen, ne? Also ich habe fünf Jahre lang die Sachen mit korrigiert. Wenn ich so etwas sehen würde, dafür würde ich Punkte abziehen. Wie kannst du denn das da hinter dem da verstecken? Du sparst dir irgendwie acht Zeichen Code. Herzlichen fucking Glückwunsch und dafür weiß niemand mehr, was Sache ist.

01:08:49 Ah! Das ist so... Ah! Das ist... Ah! Das ist... Das wäre ein Wahnsinn, Mann. Wie geil. Nein, AI würde so einen Scheiß nicht schreiben. AI ist ganz arg schlecht in Funktionen wiederverwenden. Oh Gott. Write once, read many.

01:09:22 Code wird einmal geschrieben und dann ganz oft gelesen. Es gibt keinen Grund, sich hier sechs Zeichen zu sparen, dafür, dass ich dann der Funktionsreferenz folgen muss, nur um rauszufinden, dass du einfach keine Lust hattest, P-Pro-Project auszuschreiben. Junge, ey, Junge. Das hier ist übrigens absolut akzeptabel. Sag ich halt nix. Bisschen schlechte Fehlerbehandlung, aber ich sag ja nix. Ich hab Schluck auf, Leute. Write and many, read never. Nice.

01:10:11 Ist halt nur ein Freizeitprojekt. Nichts Professionelles. True. Das ist das, was... Alter, als ob ich jetzt Schluckauf hab. Das ist das, was UXP tatsächlich ziemlich geil macht. Wenn wir uns diese Coach-Stelle mal kurz angucken.

01:10:33 Hier wird eine Name-Action erstellt und dann wird eine Transaktion durchgeführt. Und diese Action, diese Transaktion hinzugefügt. Und das ist halt saugeil, weil man so beliebig viele Aktionen quasi in einen Schritt packen kann. Und dieser eine Schritt, der ist dann tatsächlich auch rückgängig. Rückmachbar. Aber weißt du was? Wir blamen jetzt persönlich. Das ist doch ein Open-Source-Projekt, oder? Jetzt wird es persönlich, Leute.

01:11:05 Wo ist diese eine Funktion, die wir gerade eben hatten? So. Gibt Blame Decorations?

01:11:15 Schade, die Sachen, die man direkt sieht, zwei Kommentare, die definitiv auf Perfect Touring zurückgehen. Da kann man nicht, also müsste ich jetzt weiter in der Gist-History nachgucken, wer das wirklich verbrochen hat. Naja, gerade noch mal Glück gehabt. Okay, aber also der Code ist tatsächlich, also bis auf diese Bad Smells, ziemlich geil zu schreiben, sind wir ehrlich. Okay, zurück zur Magie.

01:11:41 Was mich nämlich wirklich interessiert und einer der Hauptgründe, warum ich diesen ganzen Kram überhaupt machen möchte. Also mal abhängig davon, dass ich sowieso von CEP weg möchte, weil...

01:11:56 ziemlicher architektureller Pain in the Ass und veraltet und bald nicht mehr unterstützt. Der Hauptgrund, warum ich das alles möchte, habe ich in den Erfolgstext suchen, nö, ist Transaktionen, äh, Transkripten, Transkripts. Ich möchte nämlich diese Taste hier, Export Transkript Jason und es gab noch irgendeine andere Transkript-Taste. Wenn ich das Ding nicht durchsuchen kann, dann kann ich aber tatsächlich, kann ich doch garantiert das hier durchsuchen. Transkript.

01:12:29 Query supported languages und dann Transkript. Okay, okay. Also, theoretisch sind wir hier in einem Projekt. Deswegen habe ich... Oh, Junge! Theoretisch sind wir hier in einem Projekt mit Schluck auf. Ich habe auch keinen Kaffee mehr. Wahrscheinlich kommt deswegen auch der Schluck auf. Ne, fairerweise muss man sagen, das Log ist keine Konsole-Log-Referenz, sondern das ist das Log hier oben drin. Und das hätte ich auch hinter der Funktion gesteckt. Hätte ich nämlich auch keinen Bock drauf gehabt. Ähm... Ich...

01:13:03 habe hier, wenn man auf eine wirklich sehr gute Funktionalität geht, die hier ist es nicht, die hier ist es, ich habe hier ein Transkript, also das wird aus irgendwelchen Gründen gerade nicht, weißt du was? Lass doch mal einfach, lass mal nicht so geizen, also das hier ist eine 25 Minuten langer Datei, die ist mir ein bisschen zu lang. Wo ist denn mein, der hier? Den hier hätte ich gerne.

01:13:37 Die kopieren wir uns mal. Wer willst du? C071. Hier, die hätte ich gerne. Das ist nämlich der Clip, wo ich labere, dass alles in der Beschreibung verlinkt ist, weil ich Top-Influencer das natürlich vergessen habe. Ich speichere das übrigens, ist mir so egal. Jetzt kann ich hier auf Transkribieren klicken. Und dann wird hier einfach nur Spracherkennung drauf ausgeführt. Diese Spracherkennung ermöglicht aber den Kanal zurück.

01:14:16 Deswegen habe ich auch heute am Anfang direkt über Agenten geredet, aber kommen wir gleich noch zu. Also, warum ist dieses blöde Modelfenster immer Vordergrund? Das ist ja auch richtig nervig. Hier das Transkript. Bla, bla, bla, bla, bla. Erinnert ihr euch vielleicht an diesen kleinen Einwurf? Und ich hätte jetzt gerne dieses Transkript hier exportiert als JSON.

01:14:52 Okay. Ich war jetzt auf meinen Desktop. Es bleibt spannend. Lol. Heilige Scheiße ist das präzise. Das ist ja ein fucking Traum.

01:15:28 Okay, ich bin sold. Ich werde sowas von alles komplett neu mit UXP implementieren. Das war alles. Das war... Dankeschön fürs Zusehen. Ich... Auch kurz 20 Minuten und Claude. Ne, also okay. Lass ich mal kurz pretty printen, dann seht ihr, warum das so heftig ist.

01:15:50 Das, was wir in Premiere gesehen haben und das, was man hier rauskopieren kann, ist so von 0 bis 17 Sekunden passiert das. Das ist ein Transkript, das ist dermaßen imprezise, das kannst du dir auch einfach wegschmeißen. Das hilft niemandem was. Bis jetzt nutze ich AI, um meine Videos so grob zu schneiden, was so semi funktioniert. Ich lasse mir halt aus meinem Transkript eine...

01:16:10 Menge von Schnitten geben quasi, die ich dann manuell ausführe. Natürlich kann man sowas weg automatisieren, aber die Präzision sagt halt schon ass. Also da muss ein Mensch nochmal manuell drüber gehen. Das hier ist was anderes. Ich gebe sogar eine Konfidenz mit. Eine kleine Meldung hier aus dem...

01:16:34 Stellte. Schnitt, glaube ich. Habe ich gesagt. Ich, Profi-Influencer, habe natürlich vergessen, euch zu sagen, natürlich ist alles, was hier zu sehen ist, in der Videobeschreibung verlinkt. Videobeschreibung nehmen wir uns mal als Beispiel. Videobeschreibung. Melle hat den Job zu Ende geführt, um rauszufinden, wer das verbrochen hat.

01:17:06 Ah, nur so ein Innistilkomet. Oh, wie traurig. Also meine Confidence 1. Und er sagt mir halt, der Start ist bei 255. Was auch immer das ist, ob das irgendwie Frame ist oder... Was kriegen wir heraus? Was ist denn das Erste? 248. Ah, kann es sein, dass ich... Upsila. Da habe ich... Wo ist es denn? 255. Was könnte das sein, wenn es bei 0 beginnt? Wissen wir nicht.

01:17:49 Werden wir aber noch wahrscheinlich irgendwann rausfinden. Also bei 255 vielleicht 7 Sekunden im Video oder sowas. Sowas könnte ich mir vorstellen. Weil bei 248 beginnt es. Also gucken wir doch mal. Ist bei Sekunde 7 das Wort Videobeschreibung? Videobeschreibung ist bei Sekunde 7. Okay, es sind Sekunden. Und es geht 0,66 Sekunden lang das Wort. Let's see.

01:18:28 Hier beschreiben. Beschreiben. Verlegen. Verlegen. So, ähm... 17 Frames sind 0,7 Sekunden. So gut, man! Selten sowas Gutes gesehen, ey! Das ist das rohe Transkript, nicht so ein Bullshit, den mir die UI irgendwie hier zusammen scheiß anzeigt. Alter! Ja, okay, das ist der Grund, warum ich den ganzen Kram machen wollte, weil das hier

01:19:19 Kann es dir jetzt ein Sprachmodell geben und sagen, mach mir mal den finalen Schnitt und dann kriegst du den aber auf, keine Ahnung, aufs Frame genau, wenn ich mir diese Zahlen hier so angucke. 0,16. Das sind drei Frames. Was ist die kleinste Zahl, die ich finde? 0,12? 0,09? Das ist deutsch. Zwei Frames. Also ich schätze mal auf zwei Frames genau. Das ist geschnitten. Machen wir das eigentlich lokal? Weiß ich nicht, um ehrlich zu sein.

Automatischer Videodchnitt durch KI

01:20:2001:20:20 Ich habe keine Ahnung, ob das lokal läuft oder woanders. Aber ja, krass. Man kriegt das Transkript, ey. Ist das abgefahren. Das war das, was ich unbedingt haben wollte. Und man kommt da wirklich dran. So, wo ist dieser Transkript? Achso, das sind neue APIs, die es jetzt noch nicht gibt. Deswegen habe ich das nicht ausführen können. Zieht für jemand von euch den anderen Transkript-Button? Ich meine, das kann ich auch manuell triggern. Das wäre jetzt hier nicht so...

01:21:10 Das hier sind sie. Und wo ist der... Der andere? Der ist bei... Der heißt Query Supported Languages. Okay. Wo ist der Query Supported Languages-Button? Oh, Alter, man findet nichts. Ist der ganz oben gewesen? Achso, ihr seht sowieso nichts. Ah, ich verstehe. Also H4 ist Project Converter. Ah. Ja, nee, das gibt's noch nicht, den Endpunkt. Hier.

Zukunftsperspektiven

01:22:4101:22:41 Aber das kann man manuell triggern, das ist okay. Ja, krass. Dann gucken wir mal kurz hier wieder in den Code rein. Export Transcript. Hallo? Register Click. Export Transcript clicked. Export to JSON, Alter. Ist das wild. Wow. Ist das geil, ey. Und das Ding kann ich dann einfach nur Sprachmodell reingeben.

01:23:31 Und dann kann er mir Schnittmarkierungen zurückgeben und dann kann ich das Video automatisch so einfach zuschneiden lassen. Das ist so geil, ey. Nie wieder manuell meine Videos schneiden. Weil da war wahrscheinlich echt viel zu viel Zeit. Also das ist wirklich so, die Videos quasi aus der Rohraufnahme auf einen Cut, auf einen guten Ablauf schneiden. Das braucht bei mir immer ewig. Und da habe ich nie Bock drauf. Krass, krass, krass, krass, krass.

01:24:08 UXP Starish Local File System. Ich würde mal kurz in diese Manifest-Datei gerne reingucken. Da muss er sich doch Rechte holen für, oder? Um aufs File System zugreifen zu dürfen. Ja. Was ist Required Permissions? Was kann man so requieren? Indicates the Permissions. Alter, various permissions! Ruck euch Quintalentwickler, Junge! Ich kann nicht mehr!

01:25:01 Aber die zählen wir jetzt nicht auf, weil dann wäre unsere Dokumentation ja präzise Junge, why? Sag mir doch einfach, was ich wissen will Was wetten die selbe Person, die GetActive... Permissions hinter... Hinter... GetActiveSequence hinter GetActiveSequence versteckt hat Nein, man kann da nicht draufklicken Ist das ein advancedes Konzept? Es ist wahrscheinlich wirklich ein advancedes Konzept

01:25:46 Okay, WebSocket funktioniert. Ist das nicht ein Anti-Pattern, diese zwei Ausrufezeichen zu schreiben? Ich habe das irgendwo mal gesehen. Das ist egal. Also File Storage Network Processes for Launch Process. Die zwei Ausrufezeichen sind idiomatic, dann war es eine andere Sprache, wo es verboten war. So, jetzt kommen wir nämlich in den nächsten interessanten Teil.

01:27:02 Ich habe ja gesagt, boah, voll geil, UXP kann so viel. Ich starte hier drin einfach einen Express-Service und so. Und es scheint nicht so, als ginge es. Wir lassen uns mal kurz was hinkoden. Express-Server-to-the- Wie heißt das Ding? Premiere-API-Package-Json-and-add-sample-

01:27:36 With a single endpoint to sowas wie Startup. Ja wahrscheinlich kann man das einfach hier rein klatschen oder? Na ne, das ist... wird schon finden wo es hingehört. Was habe ich denn? CloudSonnet 4. Let's see was passiert. Excuse me, what? Warum baut der denn zwei neue Kommandos an? Start it. Dankeschön. Mission Definition. Clipboard, Local File System Network. Oh oh.

01:29:38 Das bestätigt etwas, was ich schon befürchtet habe. Oh oh. Oh oh. Oh oh. Der hatte auch keinen Bock auf den Build Command. Und hat deswegen ein Dev Command hinzugefügt. Okay. Bild. Ja, jetzt bin ich da schon im richtigen Ordner. Der scheitert nur wieder an den NPM installiert.

Entwicklung von Premiere Remote

01:31:3101:31:31 Okay, jetzt bin ich mal gespannt. Also, ja. Und hier. Ja, ja, ja, genau. Also, über Require importiert. Auch wild, aber let's see. Hat diese scheiß Methode konsumiert? Ja, okay. Let's see.

01:32:07 Ob das einfach so möglich ist. Also erstmal richtig hässlich, dass ich so viele Fehler hier habe und warum verbindet mir meine ESLint Sachen. Ist egal. Wir starten nochmal NPM Run Build. Ich weiß nicht genau, ob jetzt auch automatisch das Ding hier neu geladen wurde. Ich sehe zumindest keinen Output. Nochmal neu. Ja, ja, ja, ja. Wir kommen schon der Geschichte gefährlich nahe.

01:33:00 Das hier gefällt mir zum Beispiel erstmal überhaupt nicht, was ich hier sehe. Ähm. Habe ich hier so... So Logging und so einen Spaß. Irgendwie ging das doch. Debug. Mort you not found. Okay, nee, das ist noch nicht der Fehler, den ich erwarte. Ja, aber auch eine Uhr, äh, alles LLM verwendet, ich weiß. Okay, also er hängt momentan noch da drin. Jetzt gehen wir erstmal hier irgendwie auf.

01:33:55 Ein aktuelles Modell. Jetzt wisst ihr, wie lang ich schon lokal nichts mehr darüber gemacht habe. Das Require geht hier nicht auf. Hat das Installieren nicht funktioniert? Ich sehe nichts. Doch. Offenbar hat das Installieren funktioniert. Aber ich meine, ich bin ja nicht der Einzige, der Sachen hier drin required, wie er will. Die Port Statements sind alles nur auf internen Kram. Die externen Pakete werden trotzdem über Require hereingeladen.

01:34:57 Musst du explizit npm build aufrufen? Ich habe gerade explizit npm build aufgerufen. Hier. Wir können ja mal spaßeshalber in build.html reingucken, in die Index.js. Da wurde der Code auch rein generiert. Lustig. Und die ganzen Indexe wurden natürlich auch auf require umgemünzt. Schau mal in Modules. Da habe ich doch. Da? Es ist da.

01:35:48 Beide Sachen, die über require geladen werden, sind... Stimmt, das ist nichts im Build-Module, okay.

01:36:02 Er ist auch da. Ja, es kann natürlich sein, dass ich nicht einfach beliebig Pakete reinladen kann. Dass es da schon schief geht. Also ich kann euch sagen, wo es als nächstes schief gegangen wäre. Das habe ich nämlich, deswegen war ich gerade so, oh, oh, nicht gut bei den Requirements und so weiter. Das hier ist keine vollwertige Node.js-Umgebung mehr. Wie es das früher in CEP war. Sondern...

01:36:26 aus sinnvollen Gründen wie Performance und Security, ist er richtig hart runtergescript. Also selbst wenn ich Express importieren hätte, können KatiPati übrigens. Vielen Dank für den Sub. Ich hoffe, ich habe mir wieder nichts übersehen. Oh Mann, ich bin so ein schlechter Streamer. Aber ich glaube nicht. Seit Kampfzwerges ist, glaube ich, nichts mehr passiert.

01:36:48 Glück gehabt. Zeitkampfzeuge ist nichts zu versierter, ist auch eine geile Aussage. Wo es als nächstes gescheitert wäre, ist, dass er den Webserver nicht hätte starten können, weil er nicht die Berechtigung dafür hat. Jetzt kommen wir nämlich zum...

MCP-Server als Alternative

01:37:0101:37:01 Also, jetzt haben wir die Macht gesehen, aber jetzt haben wir auch das Problem gesehen. So. Das Problem ist das folgende. Ich habe ja das letzte Mal so gesagt, yo Leute, was geht? Ich kann einfach alles in UXP packen. Also eine einzige Schnittstelle, die einfach so ein paar TypeScript-Funktionen exportiert, der Welt zur Verfügung stellt.

01:37:25 Und alle sind glücklich. Das war so meine Vision. Ja, turns out, ich bin nicht der Erste, der es probiert. Andere Leute haben zum Beispiel eigene MCP-Server geschrieben. Ihr seht das, Cycle-Jerk geht's, Circle-Jerk geht's weiter. Haben zum Beispiel eigene MCP-Server geschrieben für... Ich muss mir ja hierüber, damit ich das am Bild bin. Für...

01:37:49 andere Premiere-Anwendungen, Photoshop, InDesign und so weiter. Und das große Problem ist, dass durch diese beschränkte Laufzeitumgebung, was ja wie gesagt, also das ist noch nicht mal schlecht, das ist eigentlich schon sogar guter Stil, Wolfsburg, jetzt, danke schön.

01:38:08 Einfach, einfach, ganz genau. Das ist nämlich jetzt der Titel. Aha. Da habe ich nämlich schon alles gewusst, dass das passieren wird. Forms, Team, Digga, das ist ein Level an Vorbereitung im Kopf nur, wenn man NPM einfach so auf der Konsole aufhören kann. Zurück zum Thema. Was nicht möglich ist, ist, dass ich einfach einen Express-Server in Premiere starte. Das geht nicht. Was aber möglich ist, und das macht zumindest das Laufzeit-Technisch ein bisschen...

01:38:34 Bedinger schlimm ist, dass ich einen WebSocket Client starte. Das darf ich. Also ich dürfte mich über einen WebSocket Client an einen anderen Server dranhängen. Seht ihr schon, wo das hingeht? Was man also theoretisch bräuchte, wäre so ein, nennen wir ihn mal, Bridge. Eine Bridge, die die Schnittstellen WebSocket und, ähm, naja, Rest ist ja eigentlich falsch, aber, also HTTP.

01:39:06 nach außen hin anbietet, um dahin Befehle schicken zu können, Dokumentation abfragen zu können und so weiter. Und das Ding lockt auch schön und so weiter. Das macht einfach so für die Nutzerinteraktion und schickt dann die Funktionen einfach eins zu eins an einen Websocket-Client, der sich mit besagter Pitch verbunden hat. Also das ist wirklich eins zu eins Message-Broker, wie er im Lehrbuch steht.

01:39:37 Und Premiere hängt sich dann an diese Bitch einfach nur ran. Und wenn er jetzt sagt, hä, Moment mal, wir haben doch heute Morgen so eine MCP-Push gesehen, ist das nicht exakt dasselbe? Habe ich nicht gesagt, habe ich auch nicht vor, ich will keinen MCP-Server bauen. Wäre natürlich auch eine Möglichkeit, einfach zu sagen, ey, weißt du was, scheiß drauf. Wir bauen nicht Premiere Remote, wir bauen einen MCP-Server, damit sich die AI selber einfach alles aus dem Projekt holen kann. Warum ich das nicht mache?

01:40:04 Hat mit dem anderen, was ich heute Morgen erklärt habe, zu tun. Ey, ist der Wahnsinn, ne? Also heute ist es wirklich lehrreich. Um einen guten Roboter zu brauchen, brauchst du gute Eingabe und Ausgabe. Ausgabe haben wir viel. Also wir können sau viel Sachen in Premiere fernsteuern, Schnitte. Sogar das Transkript kriegen wir auf das Frame genau, was absoluter... Wow. Aber was wir nicht können, ist einem Agent... einem Agenten...

01:40:33 gut mitteilen, was die Folge seiner Aktionen ist. Warum funktioniert agentischer Workflow zu gut für Software mit einer Programmiersprache, wo der Compiler extrem viel frühstückt, so was wie Rust zum Beispiel?

01:40:55 und einer hohen Testabdeckung. Naja, weil der Agent sofort Feedback bekommt, wenn er verkackt hat. Und dieses letztlich genau dasselbe Prinzip, was du zum Beispiel bei Reinforcement Learning auch hast. Dieses Reinforcement sorgt dafür, dass selbst ein dummer Agent dazu getrieben wird, Dinge richtig umzusetzen. Ungefähr wirklich genauso, wie wenn du ein Junior-Entwickler auf ein Projekt werfen würdest, was Linting hat, was Pipeline hat.

01:41:23 was Merchilequests mit durchlaufender Pipeline als Muss-Kriterium festgelegt hat, was einen Protected-Main hat und so weiter und so weiter. Also solche Dinge sorgen einfach dafür, dass man gezwungen ist, Dinge richtig zu machen. Und so ist das bei so einem Projekt auch. Und um Agenten richtig schön einsetzen zu können, braucht man so eine Umgebung. Bedeutet aber...

01:41:49 In Premiere habe ich das nicht. Ich könnte Positionen und Namen und was weiß ich was von allen Clips, die in der Pipeline sind, immer wieder zurückpushen. Ich kann das Transkript jedes Mal neu berechnen, was ewig dauern würde, und mit zurückpushen. Das geht alles. Aber damit das wirklich gut funktioniert, brauche ich, glaube ich, mehr. Und...

01:42:15 Es würde in jedem Fall auch krank viel token. Also es wäre ein interessantes Experiment, versteht mich nicht falsch. Ich glaube, der heutige Stand von Agentic Workflow reicht schon aus, um Videos automatisch schneiden zu lassen in Premiere. Das kann ich mir tatsächlich schon vorstellen. Da könnte man durchaus auf alten Projekten quasi das als Wissen irgendwie den Kontext extrahieren, zusammenfassen.

Agentic Workflow in Premiere

01:42:4501:42:45 Und mitgeben und sagen, hier, so sehen Videos von mir aus, mach mal. Eve Spring war das legendär, wer kennt das nicht? Das war schon einer der absoluten Highlights von Graf Detacks, sind wir ehrlich. Also ja, das ging ja alles.

01:43:09 Der Weg dahin wäre aber ein ziemlich steiniger und wahrscheinlich den Aufwand nicht wert. Also wäre ich jetzt noch so ein kleiner Studi und hätte viel zu viel Zeit und so, würde ich mir das als Projekt auf jeden Fall rausnehmen. Es gibt von Premiere noch keine MCP-Server. Die sollten schleunigst das mal anbieten. Aber bis dahin könnte ich jetzt das als Open-Source-Projekt starten. Ganz viele Sterne kassieren auf GitHub, weil alles mit AI...

01:43:35 Gehe ja, ist ja ein richtiger, also es gehe ja rund wie sonst was. Und könnte dann meine Videos automatisch schneiden lassen. Und würde auf jeden Fall Ergebnisse sehen, ob sie gut sind oder nicht, weiß ich nicht. Es wäre natürlich magisch, weil du dann auch sagen kannst, hier, nee, ich hätte gerne noch mehr von dem in dem Video. Also du kannst dann wirklich so Anweisungen geben wie so ein Resigeur. Und ich denke, da sind wir auch in wenigen Jahren. In wenigen Jahren kann explizit auch schon eins sein. Also das ist gar, das dauert nicht mehr so lange.

01:44:05 Aber um das jetzt wirklich so durchzuziehen, fehlt mir die Zeit. Also da möchte ich mich nicht hinterklemmen. Der Ertrag dieser Investition ist nichts, was es für mich gerade irgendwie wert machen würde, da viel Zeit reinzustecken.

01:44:26 Weil im Zweifel hätte ich nur ein weiteres aus Versehen erfolgreiches Open Source Projekt, was ich dann pflegen muss und wo ich keinen Cent mitverdiene und wo meine letzte Freizeit reingeht. Wenn ich es überhaupt jemals zum Laufen bekomme und in jedem Fall würde es Token fressen wie Arsch.

01:44:45 gar keine Lust, mir so ein großes Abo von welcher AI auch immer zuzulegen, die für mich automatisch Videos schneidet. Da kriegst du ja einen Arsch voll an Output jedes Mal mit, um den Agenten vernünftig zu laufen zu lassen. Das ist nicht vergleichbar mit paar hundert oder tausend Zeilen Code. Was du da von einem großen 20 Minuten Video oder sowas in jeder Iteration... Boah, nö, da hab ich echt gar keinen Bock drauf.

01:45:16 Ja, also das ist leider alles. Das ist ein cooles Projekt. Ey, hier kostenlose Projektidee. Setzt mal bitte geil um. Habt ihr mich als ersten Kunden. Aber selber möchte ich das gerade einfach nicht machen. Auch wenn es natürlich eine coole Erfahrung wäre, selber mal einen MCP-Server zu schreiben und den dann mit einem Agenten weiter zu verbessern. Und als Nebeneffekte würde vielleicht coole Videos rausspringen. So, I get it. Aber ich sehe da drin einfach keine spannende Herausforderung.

01:45:45 Das ist genauso, wie ich zum Beispiel hier Open Claw insane langweilig finde. Weil nichts daran ist innovativ. Dieses ganzen AI-Jünger jerken sich allen darauf ab, wo mein Gott, Gott wurde gefunden. Und so, nein! Du hast einfach nur ein Sprachmodell mit ein bisschen mehr Rechten und ein paar Markdown-Dateien, wo Dinge zwischen gespeichert werden.

01:46:22 Ja, sorry, nee, ist mir meine Zeit nicht wert. Rechten ist in beiden Definitionen... Nice. Ja, also deswegen werde ich keinen Premiere-MCP selber schreiben. Also, um ehrlich zu sein, ich würde auch sowieso... Das heißt, wenn ich das gemacht hätte, würde ich mich nicht schreiben. Ich würde es schreiben lassen. Das ist ja... Also, ist ja klar.

01:46:55 Wäre auch gar nicht so schwer, so viele Endpunkte da drin gibt es jetzt auch nicht. Aber ich finde das eigentlich ganz... Also, muss man natürlich überlegen. Also es gibt jetzt mehrere Möglichkeiten. Also ich könnte natürlich auch einen MCP-Server generieren lassen. Why not? Und dann müsste ich den Code, der mir meine Premiere-Funktion fernsteuert...

01:47:18 den müsste ich dann nicht mehr in TypeScript selbst quasi schreiben, sondern ich würde das einfach als Anwendung laufen lassen und könnte dann externe Anwendungen einfach die Schnittstellen aufrufen lassen. Also das ging genauso. Das wäre auch eine valide Möglichkeit, nochmal das weiter zu entzerren. Boah, ich kenne jetzt so ein professionelles Brauchten wir Paint.

01:47:46 So, ich stelle euch kurz den Dark Mode ein. Zack. Also, ähm, er gibt hier Premiere. Und das hat hier so TS-Code. Der wird tatsächlich in Premiere ausgeführt. So. Dann gibt es hier die Bridge.

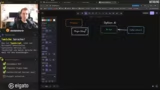

01:48:17 Alternativ MCP-Server. Also das wäre ja, das ist hier äquivalent. Weil entweder das ist halt eine Bridge, die irgendwelche Funktionen zur Verfügung stellt. Oder so. Weißt du was? Wir machen kurz, wir machen, wir machen kurz zwei alternative Implementierungen. Also einmal gibt es Bridge. Warum mache ich das eigentlich in Paint, wenn ich Excalibur habe? Oder? Dann müsst ihr meine scheiß Schrift nicht lesen. So. Premiere.

01:48:56 Auch das gibt es übrigens im Dark Mode. Also, dann gibt es hier das Plugin. Die TypeScript geschrieben. So, das ist eine Welt. Dann gibt es hier Option A. Option A ist, wir haben eine Bridge. Bridge. Und wir haben einen Caller. Der Caller, der ist stumm. Warum? Weil das Plugin

01:49:43 Klugisch. So. Caller dumm. Ruft die Bridge auf. Ähm. Fairerweise muss man sagen, auch das Plugin ruft die Bridge auf. Weil. Weil ja. Das ein WebSocket Client ist. Und dann triggert das Plugin Premiere. So. Das ist. Ähm. Option A. Klar soweit? Jetzt gibt es noch Option B.

01:50:30 Jetzt ist das Plugin dumm, weil es einfach nur Menge aller Schnittstellen implementiert. Die Bridge ist nach wie vor nur eine Bridge, die Bitch. Und der Caller ist jetzt klug. Fairerweise muss man jetzt hier sagen, das ist keine Bitch mehr, sondern ein MCP-Server. Und der Caller ist entweder ein Human Caller, dann ist er sogar sehr klug. Oder ist er halt eine AI, dann ist er so Pseudo-klug.

01:51:10 So, das ist die Architektur. Und klar ist, der Entwickler, den müssen wir jetzt irgendwie anders darstellen, habe ich hier irgendwie so, ah ja, guck mal hier. Das ist der Entwickler-Boy. Entwickler. Kann der auch rot, ja.

01:51:49 der, ähm, yo, alles klar, der würde hier natürlich die meiste Zeit an dem Plugin dranhängen. Das ist quasi so, wie es bis jetzt auch aufgebaut ist. Und hier würde der die meiste Zeit am Code hängen, der den MCP-Server aufführt. Klar ist natürlich, du hast immer ein gewisses Delay, aber wahrscheinlich ein absolut, absolut vernachlässigbares, weil, ähm,

01:52:18 dass alles über WebSocket läuft. Also wir reden hier von Pups-Sekunden. Und eine Pups-Sekunde ist kleiner als eine Millisekunde. So, das sind die beiden Architekturen, die wir zur Wahl haben. Meinungen. Also das hier ist der bisherige Weg. Und das ist übrigens auch das, was ich bauen würde wieder.

01:52:45 weil hier steckt halt irgendwo mein Client-Logik drin. Hier ist die Host-Logik, das ist das Stream Deck. Das muss nix können. Ich habe übrigens das nicht vergessen mit dem Ranch zu dem Alternativ-Steam-Dacks. Wobei, das kann ich auch einfach ganz kurz fassen. Hardware ist eine Sache, aber Software ist der Grund für das Stream Deck-Ökosystem und kein anderes Angebot. Bietet dir so viele Plugins und so weiter und das ist das, was das Stream Deck erst richtig mächtig macht.

01:53:13 Also kannst du dir auch einfach Keypads mit so physischen Tasten kaufen. Das ist ungefähr genauso. Also das ist von der Intelligenz näher an einer Stream Deck Alternative als die Stream Deck Alternative am Stream Deck.

01:53:33 Okay, also zurück zur Architektur. Hier schreibt man halt tatsächlich die ganze Zeit einfach nur Plugin-Code. Und hat natürlich die ganze API von Premiere zur Verfügung. Ganze API von Premiere zur Verfügung. Heißt, der ganze Käse hier und noch so viel mehr steht hier zur Verfügung. Das ist cool. Das ist schon, das kann was.

01:54:07 So entwickelt man damit. Und meine ganzen Sachen, die ich so von Premiere nutze, würde man genauso da drin packen. So, die Alternative ist, dass man das Plugin letztlich exakt diese Menge an Schnittstellen, die wir hier gerade sehen. Servus.

01:54:35 Einfach nur als Endpunkt zur Verfügung stellen lässt. Einmal irgendwie als WebSocket Endpunkt, einmal als HTTP Endpunkt und einmal als MCP Tool ist es dann wohl. Und ich meine, das geht sogar durchaus, denn es gibt ja diese Types.

01:54:55 Und daraus kann man ja alles generieren lassen. Das wäre nicht unmöglich. Muss ich natürlich damit rumschlagen, dass das hier nicht gerade eine statisch typisierte Sprache mit starkem Compiler ist, sondern fucking Typescript. Und dass sich das natürlich über Zeit ändern kann und dass man sich irgendeine Idee... Also irgendwie muss man das auch testenisch testen?

01:55:22 Wie auch immer das möglich sein soll. Und natürlich muss man sich dann irgendwie hier so mit so Typen rumschlagen. Hier wird er deklariert. Was ist ein Videoclip-Track-Item? Hier wird er deklariert. Das hat diese Eigenschaften. So, ja, du könntest theoretisch da komplett API-Trumm generieren, den man von außen ausführen kann. Ist halt nie so ergonomisch, wie tatsächlich Plug-In-Code zu schreiben.

01:55:54 Wie kommst du auf deine ganzen Projekte? Ist das so ein Fuck it, I will do it myself? Ja, meine ganzen Projekte sind so Fuck it, warum gibt es das noch nicht? Ich brauche das jetzt. Ja, das ist die eine Art damit zu schreiben. Das ist so, wie ich es die letzten 10 Jahre gemacht habe. Das ist ergonomisch und es funktioniert. Wenn ich diese ganzen Schnittstellen nach außen verfügbar mache,

Entscheidung für MCP-Server

01:56:2701:56:27 Würde ich auf jeden Fall alle Schnittstellen auf einmal anbieten, weil es tut nicht weh, einfach ein paar Funktionen nach außen weiterzugeben. Man könnte sofort jedes beliebige Sprachmodell da drauf werfen und einfach mal gucken, was passiert. Und vielleicht kriegt das sogar irgendwie geile Videos bei rum, aber wahrscheinlich sind sie äußerst limitiert. Weil natürlich kannst du es irgendwie lernen lassen, so okay, wenn diese Clips da sind, das mache ich irgendwie bei einem was auch immer, aber also...

01:56:59 Ich glaube einfach mal, wir sind noch nicht da. In jedem Fall würde es Videos rausbringen. Das bezweifle ich echt überhaupt nicht. Aber ob die auf dem Niveau sind, was ich irgendwie gerne hätte? Der Grund, was für die Option unten spricht, ist, dass natürlich diese ganzen Schnittstellen auch einem Human Caller auf einmal möglich sind. Wir haben zwischendrin Swagger Jason.

01:57:25 Also ist es kein schweres Ding, daraus direkt Client-Implementierung abzuleiten. Und dann hast du am Schluss eine Schnittstelle, wo du Funktionen aufrufst und in Wahrheit werden die dann im Kontext von Premiere ausgeführt. Du schreibst also TypeScript-Code, der eine generierte TypeScript-Lib aufruft, die irgendwie eine Bridge zwischendrin aufruft, der dann wiederum TypeScript-Code aufruft.

01:57:52 Und ja, das ist exakt dasselbe, wie wenn ich einfach hier drin einen Code schreiben würde, nur halt über fünf extra Ecken und ein bisschen schlechterer Latenz. Aber hat halt den großen Vorteil, dass ich das Ding direkt wiederverwenden kann für irgendeine AI. Das heißt, es ist ein bisschen mehr future-proof. Aber auf jeden Fall auch nicht so elegant. So. Und das ist die Frage, die wir jetzt klären wollen.

01:58:25 Will ich ein, weil also das hier schreibe ich nicht selbst, das lasse ich mir 100% generieren. Will ich ein zu nichts kleinen Teilen generiertes Projekt haben, wo ich sicherlich mal, das kostet aber schon, für Free kriegst du das nicht, wo ich auch tatsächlich manuell nicht Hand anlegen würde. Also das muss man an der Stelle auch dazu sagen, das ist nichts, wo ich

01:58:55 selber anpassen würde. Da kommt eine neue Types-Definition rein. Dann gebe ich dem Ding hier, guck mal, fassen wir meine Schnittstellen an. Ja, also so würde ich das machen. Und ja, ein Mensch darf dann diese Schnittstellen aufrufen und daraus Dinge bauen.

01:59:19 Ist natürlich überhaupt nicht stabil. Also direkt eine Premiere-Schnittstelle ansprechen ist immer stabiler, als es über eine Indirektion zu machen, weil natürlich jeder Pfeil hier ist eine Fehlerquelle. Ist ja klar. Der hier ist wahrscheinlich noch die kleinste, da hat dann halt Adobe verkackt. Aber hier wird was übersetzt, hier wird was übersetzt. Jedes Mal Fehlerquelle.

01:59:41 Bedeutet aber, dass dieser Code in jeder Sprache geschrieben sein darf, den du gerne haben möchtest. Das kommt ja auch noch dazu, weil das hier ist einfach nur eine Programmiersprache, die HTTP oder WebSocket oder was auch immer sprechen muss. Also jede Programmiersprache, die mir gerade einfällt. Und ruft dann meine Bridge auf und wie gesagt, dann ländest du da drin.

02:00:19 Hat so ein paar schöne Nebeneffekte. Wie oft sind ja zum Beispiel meine, also der Punkt von Light Technik ist schon kein kleiner. Weil oft habe ich ja so eine Mischung aus Auto-Hotkey zum Beispiel. Und ich könnte dann in einer Sprache schreiben, die sowohl Auto-Hotkey-Skript aufruft, als auch zum Beispiel in Premiere-Sachen machen. Also es wäre schon nicht schlecht.

02:01:01 Ich frage mich sogar gerade, lässt sich das noch beschleunigen? Ich habe ja diese Types-Detail, das ist quasi meine Quelle aller Wahrheit. Diese Sachen, die neu hinzukommen. New API is coming. Spannend. Okay, das ist vielleicht nicht das beste Beispiel. Ich hätte gerne was, was wirklich... Set Caption, Set Audio Track Name. Ich will gerade versuchen rauszufinden... Das ist schon in der TypeScript-Datei drin. Read Only.

02:02:45 Rename Track, Set Name Action. Ah, hier. Da ist der Version Tag. Okay. Kann man diese selbe Types-Datei, kann man die irgendwie einem Client servieren? Returned Object, auch geil. Ich weiß es echt nicht, Leute. Ich weiß es echt nicht. Also das ist halt, das ist kein kleines Unterfangen, diese...

02:03:48 Types, Dinger, wir reden hier von 5000 Zeilen. Und ich müsste ja, also diese ganzen Typen und so weiter, die müssen ja auch alle von der Schnittstelle angeboten werden. Damit das geil ist und ergonomisch damit zu arbeiten. Und wie gesagt, das ist absolut nichts, was man von Hand schreibt. Also da wirst du wahnsinnig, wenn du das von Hand schreiben musst. Das heißt, du hättest irgendwie für jedes Ding, das würdest du halt als Websocket-Pfad.

02:04:17 anbieten und als REST API. Und ich meine, unterm Strich, was wird hier rumgeschoben? Am Schluss sind das auch wieder nur irgendwelche Eigenschaften, die die halt haben. Das läuft immer auf Primitive zurück. Du kannst daraus auf jeden Fall OpenAI-Zeug generieren und davon kannst du wieder Clients für beliebige Sprachen erstellen. Ja, genau.

02:04:52 Wirkt aber irgendwie als Added Complexity. Von einer Typ-Definition zu einer Open-API-Stellung und dann wieder zurück zu einem Klienten. Herzlichen Glückwunsch!

02:05:22 Wenn ich mehr Vertrauen in AI hätte, würde ich auf jeden Fall den zweiten Weg gehen, weil es ist auf jeden Fall der zukunftssichere und wenn man mal sagt, ja, die AI wird das schon gut entwickelt bekommen, dann ist es ja auch ein Weg, also nehmen wir mal an, hier würden keine Fehler passieren, also das Delay wäre mir egal. Dann hätte ich halt hier einfach eine geile Schnittstelle, das ist wirklich einfach nur ein Server, ein Premiere-Server.

02:05:48 Anders kann man es nicht sagen. Also es wäre wirklich Premiere Remote auf einem ganz anderen Level. So von wegen her, ist mir egal. Hier wird jede Schnittstelle mal nach außen gegeben. Vielleicht wäre es das wirklich mal wert zu probieren. Weil was halt vom Paradigma her nicht geil ist, ist, wenn man Code in einem Plugin drin schreiben muss. Das hatten wir ja schon in Premiere Remote bei mir drin.

02:06:31 Hier schreibt man halt your custom functionality. Das ist halt irgendwie, das schreibst du in einem Plugin von jemand anderem. Deswegen hatten wir ja auch immer hier diesen weirden Fuck mit Custom Code, der dann, ich finde so cool, meine Projekte kann man googlen. Hä? Look at me, das Ding hat 80 Sterne. Das ist natürlich unsauber, weil du dann halt hier irgendwie immer Code rein injecten musst.

02:07:10 In jedem Fall ist es nichts, was man einfach so installiert. Das muss man ja auch dazu sagen. In jedem Fall ist das was, wo man trotzdem, also wo man ein Plugin installieren muss. Manuell, weil ich keinen Bock habe, mir da Gedanken zuzumachen. Und dann, na wo ist er denn? Ah hier. Was ist das hier? Und ich dann noch einen Server zu anbieten.

02:07:46 Also ein spannendes Projekt, das mal zu bauen. Und natürlich, Vorteil an der Stelle, ich lerne auch noch gleichzeitig, wie man einen MCP-Server schreibt. Also da muss man fairerweise sagen, ich habe auch noch nie einen MCP-Server geschrieben. Von dem, was ich sehe, es ist krank leicht. Du hältst dich einfach an dieses Protokoll, wo du Tools listen kannst und Tools ausführen und gut ist. Also deswegen, das wäre wahrscheinlich nicht schwer zu schreiben. Und das wäre auch wirklich was.