Twitch KI Analyse Tool bauen !wasmachenwir !gründung !naturtreul !idealo

KI-Tool zur Reichweitenanalyse von Streams entwickelt

Es wurde ein KI-Tool entwickelt, das auf Basis historischer Daten die Reichweite von Streams vorhersagen soll. Die Analyse zeigt Unterschiede zwischen kleinen und großen Streamern.

Willkommensgrüße und Streamer-Alltag

00:00:00Verena beginnt den Stream mit Musik und begrüßt ihre Zuschauer wie Leo und Rewegein. Sie gibt Einblicke in ihren aktuellen Zustand, den Wunsch, mehr IRL-Inhalte zu produzieren, und ihre persönliche Meinung über das Wetter. Der Fokus liegt auf ihrer Authentizität als Streamerin und dem Umgang mit der Community, wobei sie auch humorvoll auf die eigene Laune eingeht.

Community-Management und KI-Tool-Idee

00:13:30Verena spricht über ihre täglichen Herausforderungen mit Community-Mitgliedern wie Maurizio und Toni. Um diese zu managen, stellt sie ihr neues Projekt vor: den Bau eines KI-Tools. Das Ziel ist, Datenbanken mit Informationen von Streamern zu erstellen und diese mit ChatGPT zu analysieren, um wertvolle Erkenntnisse für die Planung von Events und Preisverhandlungen zu gewinnen.

Datenerhebung und Vorbereitung

00:20:01Verena erklärt, dass die notwendigen Daten von Streamern nicht öffentlich verfügbar sind und daher direkt bei den Streamern eingeholt werden müssen. Sie hat bereits Streamer-Freunde wie Chrissi, Benni und Meloni kontaktiert und deren Daten erhalten. Das weitere Vorgehen besteht darin, diese_exports in eine gemeinsame Excel-Datei zu integrieren, um eine für die Analyse verwendbare Datenbank zu schaffen.

Zwischenpause und persönlicher Anekdoten

00:37:24Nachdem die technischen Vorbereitungen eingeleitet wurden, wechselt Verena das Thema und erzählt eine persönliche Anekdote von einem Erlebnis im Eisbach im Englischen Garten, bei dem ihr ein junger Mann unangenehm aufgefallen ist. Die Geschichte führt zu einer Diskussion über Sexualisierung und Selbstinszenierung in den sozialen Medien und wie sie damit in ihrer Community umgeht.

Praktische Umsetzung des KI-Tools

00:50:04Zurück im Hauptthema, demonstriert Verena anhand ihres eigenen Twitch-Dashboards, wie sie die nötigen Daten exportsiert. Sie zeigt die exportierte Tabelle, in der Details wie Live-Aufrufe, Zuschauerzahlen, Watchtime und Follower enthalten sind. Sie betont, dass diese Daten von externen Tools wie Twitch-Tracker nur unvollständig zur Verfügung stehen und daher der direkte Export vom Streamer entscheidend ist.

Aufbau der Datenbank und datentechnische Herausforderungen

00:58:03Verena beginnt damit, die erhaltenen Daten von anderen Streamern in eine gemeinsame Datei einzufügen. Dabei zeigt sich, dass der Export des Stream-Titels nicht standardmäßig enthalten ist und eine manuelle Nachträglicherfassung erfordert, um die Qualität der Daten für die Analyse zu sichern. Die Diskussion offenbart den komplexen Aufwand, um eine aussagekräftige und saubere Datenbasis für die KI-Analyse zu schaffen.

Fehlerbehebung und Datenbereinigung

01:03:53Im Prozess des Zusammenführens der Datensätze stößt Verena auf technische Herausforderungen. Es muss manuell eine Fehlzeile im Datenbereich der Watchtime entfernt werden, die zu einer falschen Auswertung führen würde. Zusätzlich stellt sie fest, dass nicht alle eingeholten Daten von Streamern wie Meloni direkt verwendbar sind und eine manuelle Anpassung der Tabellen notwendig ist.

Synthetische Daten und Weiterer Aufbau der Datenbank

01:12:07Verena adressiert einen Vorschlag im Chat, die Datenbank mit synthetischen, also künstlich erzeugten, Daten anzureichern. Sie ist skeptisch und möchte zunächst nur die echten, gesammelten Daten verwenden, bevor sie auf synthetische Daten zurückgreift. Sie arbeitet weiter daran, die Daten von Streamern wie Danny und Strombok in die zentrale Tabelle zu integrieren, um die Grundlage für die KI-Analyse abzurunden.

Datenbank-Erstellung und Datenanalyse

01:18:08Nachdem die Datenbank mit den Streamer-Daten von Juni, Strombok und Danny erstellt wurde, beginnt die Analyse. Das Hauptziel ist es, ein Vorhersage-Tool für die Reichweite zukünftiger Streams zu entwickeln. Dabei wird die Watchtime pro Zuschauer genauer untersucht. Die Daten zeigen, dass kleinere Streamer tendenziell eine höhere Watchtime pro Unique Viewer aufweisen, während größere Streamer mehr Aufrufe generieren, aber geringere durchschnittliche Verweildauern pro Person.

Erkenntnisse zur Viewer-Bindung und Chat-Aktivität

01:31:56Die Analyse enthüllt, dass kleinere Streamer eine intensivere Viewer-Bindung aufweisen, was sich in einer längeren durchschnittlichen Watchtime pro Unique Viewer zeigt, bei Strombok sind es beispielsweise 36 Minuten. Im Gegensatz dazu haben größere Streams oft eine geringere pro-Kopf-Bindung, aber insgesamt mehr Chatnachrichten. Es stellt sich heraus, dass reines Chatten nicht die Verweildauer direkt verlängert, sondern wiederholtes und aktives Chatten einen positiven Einfluss auf die Aufenthaltsdauer hat.

Entwicklung eines Forecast-Tools für Marketing-Events

01:51:44Das Vorhaben ist ein Forecast-Tool für Multistreamer-Events zu entwickeln. Hierfür wird eine KI trainiert, die auf Basis historischer Daten wie Live-Aufrufe, Watchtime und Chat-Aktivität die erwartete Reichweite für geplante Events mit mehreren Streamern vorhersagen kann. Ein zentrales Problem ist die genaue Erfassung der Zuschauerzahlen bei Multistreams, bei denen die Chats verschmolzen sind und neue Zuschauer dazukommen, die bei einzelnen Streamern nicht gezählt werden.

Umgang mit Multistream-Events und Daten-Herausforderungen

02:21:05Für die KI ist es entscheidend, Multistream-Events korrekt zu identifizieren. Der Synergieeffekt eines gemeinsamen Chats führt zu einer um 60% höheren Reichweite und längeren Verweildauer, die nicht auf einen einzelnen Streamer entfallen. Die Herausforderung besteht darin, die KI anhand von Indikatoren wie einem plötzlichen Anstieg der Chatnachrichten oder speziellen Event-Titeln diese Situationen erkennen zu lassen, um falsche Prognosen für zukünftige Events zu vermeiden.

Vergleich der Engagement-Quoten und Ergebnisse

02:47:14Der finale Vergleich zwischen einem kleinen Streamer (Strombok) und einem großen (Skyline TV) bestätigt die Kernthese: Große Streams haben eine um eine Größenordnung höhere Bruttoreichweite, aber eine deutlich geringere Watchtime pro Zuschauer (8 vs. 23 Minuten) und eine geringere Engagement-Tiefe pro Minute. Während bei kleineren Streams mehr konzentrierte Aufmerksamkeit besteht, haben große Streams ein zehnmal höheres Chat-Tempo, was bedeutet, dass Nachrichten sehr schnell von unten nach oben scrollen.

Fazit und Ausblick für das Tool

02:51:28Die Analyse zeigt, dass die reinen Zahlen der KI nur bedingt als Grundlage für Entscheidungen dienen können. Externe Faktoren wie parallel laufende Events, die Überschneidung von Zielgruppen oder der Grund für einen Stream (z.B. Musik vs. Gaming) sind nicht erfasst. Dennoch ist das Ziel, ein Tool zu bauen, das Marketing-Teams eine erste, grobe Schätzung für geplante Livestream-Events gibt, basierend auf Kausalitäten wie der Korrelation von Streamer-Größe und Engagement-Rate.

Analyse von Chat-Engagement und Reichweite

02:52:32Im Stream wird die Analyse von Chat-Engagement und Reichweite verschiedener Streamergrößen besprochen. Es wird festgestellt, dass bei größeren Streams die Qualität der Nachrichten zwar schlechter ist, aber das Chat-Engagement pro Viewer und Minute als wichtiger KPI gilt. Egal ob durch Text oder Emotes, jede Interaktion wird als wertvolles Marketing-Signal gewertet. Der Zusammenhang zwischen der Größe des Streamers und der Menge der Nachrichten pro Zuschauer wird deutlich, wobei größere Kanäle einen Chatsturm erzeugen, während kleinere Kanäle für Gespräche geeignet sind.

Probleme bei der Datenerhebung und KI-Anwendung

02:59:32Die Streamerin berichtet von erheblichen Schwierigkeiten bei der Erstellung eines KI-Tools zur Reichweitenprognose. Ein konkretes Problem ist die Verarbeitung eines Datensatzes mit 197 Einträgen von fünf Streamern. Die Versuche, ChatGPT zur Analyse und Vorhersage von Reichweite (Unique Viewer, Live Views) basierend auf der durchschnittlichen Zuschauerzahl (CCV) zu nutzen, scheitern. Die KI liefert stark abweichende und unzuverlässige Ergebnisse, was auf ungeeignete Prompts und eine unzureichende Datenbasis zurückgeführt wird. Die Korrelation zwischen den Kennzahlen wird als komplex und nicht linear beschrieben.

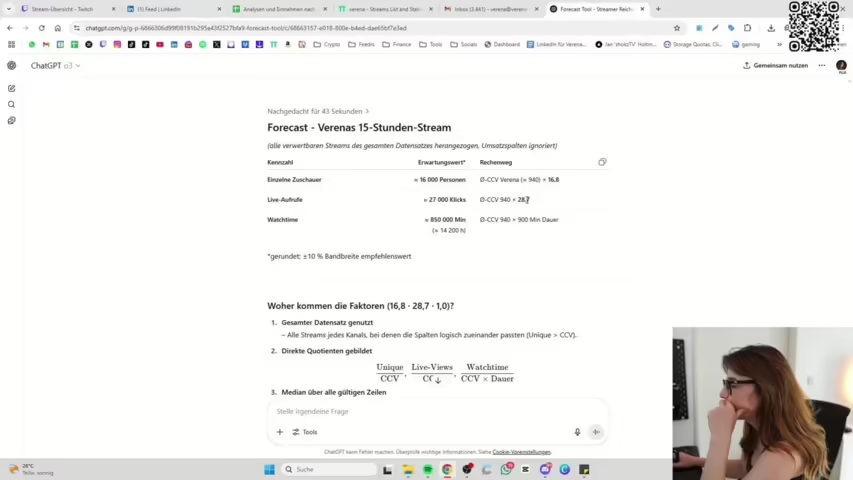

Entwicklung eines Forecasting-Modells

03:28:24Das Ziel bleibt die Erstellung eines verlässlichen Forecasting-Tools für Live-Events. Die Kernherausforderung ist die Ableitung von Reichweite-KPIs (Live-Aufrufe, Unique Viewer) aus der CCV. Die Streamerin und der Chat testen verschiedene Ansätze. Eine Erkenntnis ist, dass eine einfache lineare Regression unzureichend ist und zu große Abweichungen produziert. Stattdessen wird die Idee verfolgt, die Streamer in Größenklassen zu segmentieren, um präzisere Faktoren für die Hochrechnung zu ermitteln, anstatt einen breiten Durchschnitt zu verwenden.

Optimierung der KI-Prompts und Datenbasis

04:37:01Nach anfänglichen Misserfolgen wird die Methodik zur Erstellung der KI-Prompts angepasst. Statt einer unüberschaubaren Spanne (100-5000 Zuschauer) werden die Streamer in kleinere Segmente (z.B. 0-300, 300-700 Zuschauer) unterteilt, um die Berechnungen präziser zu gestalten. Gleichzeitig wird der KI explizit befohlen, sich nur auf den bereitgestellten Datensatz zu beschränken und externe Datenquellen zu ignorieren, um die Genauigkeit der Prognose zu erhöhen und die Ergebnisse in eine nutzbare Marketing-Range zu bringen.

Praktische Testläufe und Ergebnisbewertung

05:07:09Das aktualisierte Modell wird in praktischen Testläufen evaluiert. Bei Eingabe eines Beispiels mit 941 durchschnittlichen Zuschauern prognostiziert die KI nun 27.400 Unique Viewer und 47.000 Live Views. Diese Werte werden mit den tatsächlichen Messwerten von 20.910 Unique Viewern und 37.000 Live Views verglichen. Obwohl die Annäherung besser ist, liegt die Prognose weiterhin deutlich über der Realität. Die Analyse zeigt, dass die KI dazu neigt, die Basiswerte zu hoch anzusetzen und die Range der möglichen Reichweiten als zu groß empfindet.

Verbleibende Herausforderungen und nächste Schritte

05:09:15Die zentrale, noch ungelöste Frage, ob überhaupt ein stochastischer Zusammenhang zwischen CCV und den Reichweite-KPIs existiert, bleibt bestehen. Die aktuelle Methode ist fehleranfällig und nicht zuverlässig genug für den kommerziellen Einsatz. Es wird festgestellt, dass die Datenbasis von 197 Datensätzen zwar ein guter Startpunkt ist, aber möglicherweise zu klein, um allgemeingültige Aussagen zu treffen. Der nächste Schritt könnte die Erweiterung der Datenbank um weitere Streamer und die tiefere Analyse von thematischen Zusammenhängen sein, um die Genauigkeit des Vorhersagemodells langfristig zu verbessern.

Datenbasis und Analyse der KI-Tool-Probleme

05:19:58Die Analyse des KI-Tools zur Twitch-Stream-Auswertung stößt auf erhebliche Hürden. Der Kern des Problems scheint eine unzureichende Datenbasis zu sein, was zu ungenauen Vorhersagen führt. Weitere Datensätze werden erwartet, um die Genauigkeit zu verbessern. Es wird deutlich, dass der bisherige Ansatz des Tools nicht zu den realen Werten führt, und es wird offenbar, dass bisher nicht alle relevanten Datenquellen ausgeschöpft wurden.

Frustration und mentale Erschöpfung der Streamerin

05:29:59Die anhaltenden Schwierigkeiten bei der Analyse führen bei der Streamerin zu massiver Frustration und Nervosität. Sie äußert, dass ihr 'Gehirn fertig' sei und sie emotional und kognitiv an ihre Grenzen gestoßen ist. Sie ist 'nervlich am Ende' und fühlt sich überfordert, was sie auch offen im Stream thematisiert. Trotz der emotionalen Erschöpfung zeigt sich jedoch der Wille, das Problem in einem Coworking-Stream am nächsten Tag weiterzuverfolgen.

Methodische Kritik und Lösungsansätze

05:38:05Die Streamerin stellt die bisherige Vorgehensweise infrage und erkennt, dass die entscheidende Herausforderung darin besteht, die Zusammenhänge zwischen den verschiedenen Metriken wie CCV, Live-Aufrufen und einzelnen Zuschauern zu verstehen. Sie argumentiert, dass man sich nicht in Details verlieren darf, sondern einen repräsentativen Mittelwert für alle Streamer finden muss, da sie sonst mit zu vielen unklaren Variablen konfrontiert wäre.

Nächste Schritte und Ausblick

05:49:46Nach der emotionalen und analytischen Auseinandersetzung beschließt die Streamerin, die Arbeit am Tool nicht abzubrechen. Sie gibt an, den ganzen Abend und am nächsten Morgen um 8 Uhr an dem Problem weiterzuarbeiten, bis eine Lösung gefunden ist. Parallel dazu gibt sie Einblicke in ihre geschäftlichen Pläne, wie den Aufbau eines SaaS-Tools nach der Gründung ihrer GmbH und den geplanten Aufbau von Webseiten und Anwendungen.

Themenwechsel zu persönlichen Alltag und Shopping

06:01:33Nachdem das anstrengende technische Thema vorerst auf Eis gelegt wurde, wechselt der Stream zu persönlichen Alltagsaktivitäten. Die Streamerin zeigt ihre stark abgenutzten Schuhe und plant, über die Preisvergleichsplattform Idealo neue Sneaker zu kaufen. Sie demonstriert die Funktionen der Idealo-App, insbesondere den Preiswecker und den Scanner, um die günstigsten Preise zu finden und beim Einkaufen zu sparen.

Modeberatung und Konflikte im Chat

06:34:48Bei der Suche nach neuen Schuhmodellen kommt es zu Differenzen im Chat über den modischen Stil. Die Streamerin lehnt Vorschläge wie 'Air Max' oder 'Adidas' ab und fühlt sich von den Ratschlägen nicht verstanden. Dies führt zu einer emotionalen Reaktion, in der sie sich wundert, warum sie überhaupt den Twitch-Chat zu Mode-Themen fragt, und sich darauf beschränkt, nur noch auf Frauen zu hören.

Abschluss und Ausblick auf die Zukunft

06:37:14Nach dem emotionalen Streit über Modethemen beendet der Stream und die Streamerin kündigt an, offline zu gehen. Sie deutet jedoch an, am nächsten Morgen um 8 Uhr mit der Problemlösung am KI-Tool fortzufahren, da sie angefixt sei und das unbedingt lösen wolle. Als persönliche Ankündigung erwähnt sie bevorstehende Reisepläne mit 'Danny', für die sie Vorbereitungen trifft.