Es wurde die Funktionsweise moderner KI-Modelle zur Stimmenklonung untersucht. Die Referenzaufnahme der Originalstimme wird mit Text-zu-Speech-Systemen wie Fisch Speech und Qwen3 TTS verknüpft, um qualitativ hochwertige Klonate zu generieren. Die generierten Audio-Dateien mit der geklonten Stimme werden mit dem Original verglichen.

Technische Einrichtung und Stream-Start

00:00:00Zu Beginn des Streams richtet der Streamer die technische Infrastruktur für den Live-Auftritt ein. Er weist auf die 1080p/60fps-Qualität hin und prüft die Tonqualität für Twitch und YouTube. Bei der Kamera ist ein Rebuild-Prozess am Laufen, welcher die Verfügbarkeit während des Streams beeinträchtigen könnte. Eine kurze Ankündigung erfolgt für ein neues Projekt, bei dem die eigene Stimme geklont werden soll, und die Aufnahme eines KI-generierten Absatzes vorgeführt wird.

Vorstellung der KI-Stimmklonungs-Tools

00:12:07Der Streamer stellt das Kernprojekt des Streams vor: das Klonen der eigenen Stimme. Er demonstriert das Fisch Speech 1.5-Modell, ein Text-zu-Speech-System mit Support für zahlreiche Sprachen, darunter auch Deutsch. Nachdem die Installation des Modells geprüft und erfolgreich war, wird dessen Fähigkeit gezeigt, Text in Sprache umzuwandeln, ohne die Performance des Streams zu beeinträchtigen. Dies dient als technologische Grundlage für das spätere Klonen.

Aufnahme und Analyse der Referenzstimme

00:21:02Um die Stimme zu klonen, wird eine Aufnahme der eigenen Stimme benötigt. Der Streamer nutzt hierfür das Tool Audacity, um die spezifischen Berliner Sätze einzusprechen, die für den Klonungsprozess benötigt werden. Die Aufnahme erfolgt nach anfänglichen technischen Schwierigkeiten, bei denen das Mikro nicht korrekt ausgewählt war. Die entstandene Audiodatei dient als Referenz für das Klonungsmodell und wird auf ihre Qualität überprüft.

Stimmenklonung mit Fisch Speech und lokaler Ausführung

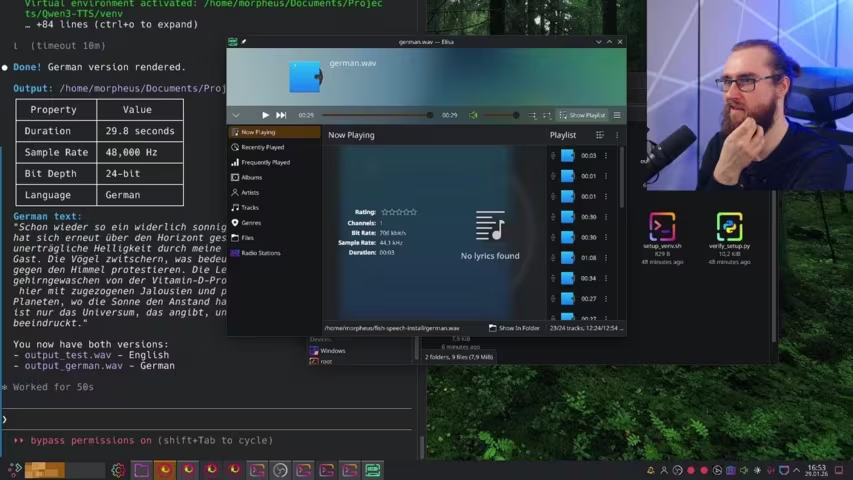

00:45:02Nachdem die Referenzaufnahme bereitsteht, wird der Prozess des Stimmenklonings mit dem Fisch Speech-Modell eingeleitet. Der Streamer nutzt ein von Claude generiertes Skript, um die Aufnahme mit dem Modell zu verknüpfen und einen Text in deutscher Sprache mit der geklonten Stimme zu generieren. Der Prozess läuft effizient lokal ab und benötigt nur einen geringen Teil der Grafikkarten-Ressourcen, während die Qualität des generierten Sprachausgangs als sehr ähnlich zur Originalstimme bewertet wird.

Vergleich von Klonungs-Ergebnissen und Audio-Optimierung

00:57:32Das Klonungsergebnis mit Fisch Speech wird mit der Originalaufnahme verglichen. Zunächst wird festgestellt, dass die Satzübergänge im generierten Text zu abrupt sind. Anschließend wird versucht, das generierte Audio mit einem Equalizer und Filtern in Audacity zu bearbeiten, um es künstlich zu einem 'Telefon'-Klang zu verändern. Im direkten A/B-Vergleich ist ein Unterschied zwischen der geklonten und der Originalstimme für den Streamer kaum noch hörbar, was das Potenzial der lokalen Klonung unterstreicht.

Ausblick auf Qwen3 TTS und weitere Anwendungsmöglichkeiten

01:16:11Nachdem der erste Klonungsversuch mit Fisch Speech erfolgreich war, schaut sich der Streamer alternative Modelle an, insbesondere Qwen3 TTS. Er überprüft, ob dieses Modell ebenfalls deutsche Sprachgenerierung und Stimmenkloning unterstützt. Parallel dazu erläutert er den praktischen Nutzen der Technologie für seine eigene Applikation, den Morph Reader, wo Artikel mithilfe von Text-zu-Speech vertont werden, um die Kosten im Vergleich zu Cloud-Diensten wie Eleven Labs oder OpenAI massiv zu senken.

Zero-Shot Speech und Custom Voice Modelle

01:21:43Der Streamer erläutert die Unterschiede zwischen Zero-Shot Speech Generation und Custom Voice. Zero-Shot ist benutzerfreundlich und ermöglicht die Erzeugung von Sprache ohne Vorabtraining, während Custom Voice speziell für das Klonen von Stimmen gedacht ist. Er stellt fest, dass modernste TTS-Modelle auf Chinesisch eine noch höhere Genauigkeit aufweisen als auf Englisch. Da auf Social Media bereits unzähl Stunden seines eigenen Audiomaterials verfügbar sind, ist dies für jeden zugänglich und es besteht kein technischer Zugriff für den Streamer, um dies zu verhindern.

Risiken des Stimmenklonings und gefälschte Inhalte

01:23:23Ein zentrales Thema ist die einfache Möglichkeit, Stimmen aus öffentlich verfügbaren Audioquellen zu klonen. Der Streamer betont, dass dies bereits aktiv wird, auch von Plattformen wie CapCut, und er darauf keinen Einfluss hat. Ein großes Risiko besteht darin, dass mit geklonten Stimmen gefälschte Werbeinhalte, etwa für Scam-Coins, erstellt werden können, die ihm selbst zugeschrieben werden und sein Image schädigen können. Er kündigt an, dass dies Thema eines kommenden Videos zum Digital Independence Day sein wird.

Herausforderungen bei der Erkennung von KI-Inhalten

01:28:09Die zunehmende Verschmelzung von KI und Realität macht die Erkennung gefälschter Inhalte extrem schwierig. Früher konnte man anhand von 'Model Smell' – spezifischen sprachlichen Mustern – KI-Texte erkennen. Doch moderne Modelle, insbesondere chinesische wie Kimi K2, trainieren auf andersartigen Datensätzen und umgehen diese Muster. Bei der Audioerkennung existieren zwar Tools, deren Qualität reicht jedoch nicht aus und erfordert eine Rate. Ein Beispiel aus der realen Welt ist ein bei Aldi gedruckter Prospekt, bei dem der Hintergrund mit KI generiert war – ein Detail, das dem Streamer nicht aufgefallen wäre.

Wasserzeichen und Grenzen der Modelle

01:36:23Wasserzeichen wie Google's Synth-ID werden als ein Lösungsansatz für die Erkennung vorgestellt. Der Streamer kritisiert jedoch, dass dieses System nur funktioniert, wenn man die API des jeweiligen Anbieters nutzt. Wer lokal auf seiner Hardware arbeitet, wird keine Wasserzeichen finden, da diese leicht umgangen werden können. Zudem führt er die unterschiedlichen Stärken von LLMs an: GPT 5.2 habe den entscheidenden Vorteil, den Kontext auch bei vielen Follow-up-Fragen nicht zu verlieren, während Gemini und Claude nach einer bestimmten Anzahl an Fragen an Qualität verlieren. Er betont daher seine Strategie, bei Claude Review-Agents einzusetzen, um den Kontext immer neu zu initialisieren und die Ergebnisse zu prüfen.

Effizienz und Wirtschaftlichkeit von KI im Arbeitsalltag

01:55:54Der Streamer analysiert die Wirtschaftlichkeit des KI-Einsatzes für seine Programmierarbeit. Bei einem Abo von 200 Euro pro Woche für Claude, die seine Arbeitszeit um einen vollen Arbeitstag pro Woche einspart, rechnet er, dass dies deutlich günstiger ist als ein menschlicher Programmierer zum Mindestlohn. Er beschreibt seine Arbeitsroutine als Business-Ausgabe, bei der er via GitHub Issues KI-Agents zur Code-Generierung und -Überprüfung einsetzt. Der Prozess ist so effizient, dass er schneller und kostengünstiger ist als die manuelle Bearbeitung und er somit ein klares wirtschaftliches Argument für die Nutzung hat.

Praktische Umsetzung: Test von Quen3 TTS

02:05:12Nach einer längeren Vorbereitungsphase startet der Streamer mit dem Test des Quen3 TTS Modells. Nach einigen technischen Herausforderungen mit der Geschwindigkeit der Sprachausgabe wird die Qualität deutlich besser, als er den Text langsamer und entspannter vorspricht. Der Streamer vergleicht das Ergebnis mit früheren Versuchen und stellt fest, dass die Qualität der generierten Audio-Datei sich massiv verbessert hat und nun deutlich natürlicher klingt, wenngleich noch leichte Artefakte vorhanden sind. Der Prozess demonstriert die praktische Anwendung und die schrittweise Optimierung der Technologie live.

Vergleich und Qualitätsbewertung der generierten Stimmen

02:24:10Im direkten Hörvergleich zwischen der von Fisch und Quen3 TTS generierten deutschen Stimme fällt auf, dass beide Modelle unterschiedliche Charakteristika aufweisen. Der Streamer selbst und das Publikum sind sich uneinig, welche Stimme authentischer klingt. Während Fisch möglicherweise näher an der Originalstimme ist, klingt Quen3 qualitativ hochwertiger und klarer, aber auch etwas heller als erwartet. Das Publikum im Twitch-Chat teilt sich in Befürworter beider Modelle, was die subjektive Natur der Bewertung unterstreicht und die Notwendigkeit weiterer Optimierung zeigt.

Experimente mit Stimmenklonierung

02:31:46Der Stream beginnt mit einem intensiven Experiment zur Stimmenklonung. Zuerst wird ein Text vorlesengelassen, um die Qualität zweier Modelle, Fish und Quen, zu vergleichen. Es werden mehrere Hörbeispiele mit verschiedenen Inhalten generiert, darunter eine ernste Geschichte über ein geerbtes Haus und eine humorvolle, sonnenhassernde Rant. Ziel ist es herauszufinden, welche Klonstimme natürlicher und qualitativ hochwertiger klingt und sich mehr an der Originalstimme orientiert. Die Zuschauer werden in den Kommentaren um ihre Meinung gebeten.

Analyse der Klangqualität und Modelleigenschaften

02:40:19Nach Auswertung der Hörbeispiele werden die Stärken und Schwächen der beiden Modelle diskutiert. Fish wird als der Klon identifiziert, der der eigenen Stimme näherkommt, während Quen für eine insgesamt bessere, klarere und angenehmere Klangqualität gepriesen wird. Es wird festgestellt, dass Quen in der Lage ist, Emotionen besser zu übermitteln, während Fish teilweise seltsame Pausen und unnatürliche Übergänge aufweist. Die Modelle QN3 TTS und Fish Audio als Backend werden vorgestellt und ihre Kompatibilität mit dem Pipeline-System erläutert.

Technische Anforderungen und Hardware-Grenzen

02:47:38Die Diskussion vertieft sich in die technischen Anforderungen der Modelle. Die Kombination von Stimmcloning mit Cloud-Code und der notwendige Python-Code wird erwähnt. Es wird darüber gesprochen, wie man Emotionen und Akzente in die generierte Stimme integrieren kann. Der Schwerpunkt verlagert sich schnell auf die immense Hardware, die für die Ausführung leistungsstarker Modelle benötigt wird. DieGPU-Last, der RAM-Bedarf und der Stromverbrauch werden kritisch hinterfragt und im Hinblick auf eine kommerzielle Nutzung bewertet.

Zukunft von KI-Modellen und Hardware

03:13:31Der Stream wendet sich der Zukunft der KI zu und diskutiert neuartige Weltmodelle wie Genie 3, die interaktive 3D-Umgebungen generieren können. Es wird spekuliert, wie solche Modelle das Verständnis der KI für die physische Welt verbessern könnten. Gleichzeitig wird die unerschwingliche Hardware diskutiert, die derzeit notwendig ist, um diese Modelle lokal zu betreiben. Es werden verschiedene Optionen wie Server mit AMD Threadripper-Prozessoren, AI-fähige Karten und sogar die Anschaffung ganzer Mac-Studio-Cluster als theoretische, aber unrealistische Lösungen durchgegangen.

Pragmatische Lösungen und Cloud-Nutzung

03:52:44Aufgrund der exorbitanten Kosten und des Stromverbrauchs wird der pragmatische Entschluss gefasst, zunächst auf Cloud-Dienste zu setzen. Die Anschaffung eigener Server wird als teure, laute und kurzlebige Alternative abgetan. Es wird betont, dass es sinnvoller ist, in die Cloud zu investieren, als in Hardware, die möglicherweise in K schon wieder veraltet ist. Die Idee, eine lokale Lösung für das Projekt zu schaffen, bleibt als langfristiges Ziel bestehen, ist aber von zukünftigen Hardware- und Software-Entwicklungen abhängig.

Abschluss und Ausblick

04:01:56Zum Abschluss des Streams fasst der Streamer die wichtigsten Ergebnisse zusammen. Es wird betont, dass sowohl Fish als auch Quen ihre Berechtigung haben und es letztlich auf den Anwendungsfall ankommt. Der Fokus liegt weiterhin auf der praktischen Umsetzung des Projekts. Ein detailliertes Video über NixOS wird für Sonntag angekündigt. Der Stream endet mit einem finalen Gruß an die Community, bei dem die Zuschauer aufgefordert werden, den Kanal auf Instagram zu folgen, um über zukünftige Streams informiert zu werden.