Es wurde die Funktionsweise moderner KI-Modelle zur Stimmenklonung untersucht. Die Referenzaufnahme der Originalstimme wird mit Text-zu-Speech-Systemen wie Fisch Speech und Qwen3 TTS verknüpft, um qualitativ hochwertige Klonate zu generieren. Die generierten Audio-Dateien mit der geklonten Stimme werden mit dem Original verglichen.

Technische Einrichtung und Stream-Start

00:00:0000:00:00 Ich bin zu früh dran. Das ist aber super. Denn ich kann so tatsächlich einmal noch mal ganz kurz ein bisschen separat gucken, ob alles läuft. Hier nehme ich zum Beispiel. Es ist schief gegangen, den Chat zu laden. So, jetzt. Jetzt habe ich Zeit, alles einzurichten und wir können pünktlich anfangen um halb mit dem, was krass ist. So. Wir sind bei Twitch Live. Perfekt. Ja, hallo.

00:00:30 1080p, 60 Frames, so will ich das. Ihr hört hoffentlich nur mich und nicht mich doppelt. Perfekt. Schauen wir mal noch beim YouTube rein. Oh, kann ich da direkt? Oh, das ist voll schlaut.

00:00:47 Da bin ich. Da bin ich. Hey, hey, hallo. Wird Apple-Aktie heute steigen oder fallen? Finde ich eine schöne erste Frage direkt für den Stream. Ihr könnt gerne darüber diskutieren. Aber ich werde euch keine Anlageberatung hier geben. Das fürchte ich, kann ich nicht beantworten. So, ja wundervoll. Es klappt viel zu gut. Hi.

00:01:14 Ton gut, Qualität gut. Mal gucken, ob die Kamera heute wieder ausfällt. Ich habe noch ein Rebuild am Laufen, damit noch ein paar andere Sachen von der Kamera gefixt werden. Deswegen, es kann durchaus passieren. Ich habe mich erst heute damit so richtig beschäftigen können und so ein Rebuild dauert bei mir so irgendwie drei Stunden, weil CUDA neu gebaut werden will. Deswegen, das dauert ein bisschen. Und mein Nix-Config ist mit mir in gewachsen. Deswegen, nicht wundern. Aber ansonsten...

00:01:41 Sieht gut aus. Hallo! Ja, wundervoll. Ich habe heute was mit euch vor. Ich habe ein neues Repo gefunden auf Hugging Face und das hat es mir irgendwie angetan, deswegen das wollte ich unbedingt ausprobieren. Aber da kann ich leider erst in vier Minuten drüber sprechen, weil ich muss jetzt irgendwie Zeit überbringen. Ich dachte, das funktioniert nicht so reibungslos. Das funktioniert viel zu gut. Vielleicht kurzer Wrap-Up. Oh, Bobby-Projekt. Geil. Nice.

00:02:09 Vielleicht kurzer Wrap-Up. Also ich habe letzte Woche mit euch gemeinsam hier versucht, das Ganze als ein Projekt zu erstellen mit einer gewissen Spiele-Engine. Und wir haben herausgefunden, dass Cain noch nicht so gut ist, um Spiele-Engines zu machen. Warum ist der Ton im Vergleich zu den anderen Videos so leise? Weil ich bei den Videos meinen Ton nochmal extra höher stelle, also quasi von der Lautstärke. Ich habe mich heute tatsächlich mit meinem Sprechtrainer...

00:02:37 drüber unterhalten, was ich mit dem Mikro machen soll und er hat gemeint, du kannst es benutzen, du musst halt richtig reinreden, dann geht das auch. Aber es hängt halt scheiße, weil wenn ich das jetzt so mache, dann sehe ich den Bildschirm hier nicht und so kann ich halt in die Bildschirm reingucken. Deswegen haben wir uns ein bisschen drüber unterhalten, was ich mit dem Ton machen kann. Aber, ja, ist noch nicht gefixt. So ein Mikro muss halt erst ausgesucht werden und ich will mich ein bisschen informieren, bevor ich 1500 Euro für ein Mikro ausgebe. Das war das, was er mir empfohlen hatte. Was dann potenziell wahrscheinlich übrigens nicht mal unter Linux so richtig...

00:03:06 komplett läuft mit allem drum und dran, was ich bräuchte. Das ist mal wieder logisch. Wir haben letztes Mal versucht, ein Game anzufangen zu entwickeln und haben herausgefunden, dass KI das nicht so gut kann. Heute machen wir entweder da weiter oder je nachdem, wie lange wir brauchen. Ich will mit euch meine Stimme klonen. Das ist so das Erste, was ich vorhabe. Und ich muss euch kurz was zeigen. Ich habe ja bei beiden Tarifen, also bei Gemini...

00:03:33 und bei Claude jeweils den 200 Euro Tarif und ich muss euch ganz kurz was zeigen. Ihr seht es gar nicht vollständig. Warte, eine Sekunde. Eine Sekunde. Das hinten dran ist schon Fisch. Das werden wir gleich benutzen. Das stimmt von der Höhe. So, nicht resumed der hier. Aber das kann ich euch auch nicht zeigen. Verdammt, da wird mir meine E-Mail-Adresse wieder geleakt. Das ist Claude.

00:04:02 Claude ist 86% aufgebraucht und resettet sich erst am 31.01. Und die E-Mail-Adresse dürfte er haben. Und ChatDBT ist ein bisschen dumm, leider. Hier.

00:04:30 Bei Chachabiti habe ich es aufgebraucht. Es tut mir sehr leid. Ja, also wir müssen mal gucken, wie viel mit den aktuellen Usage-Dingen, die ich noch habe, durchbekommen. Aber ich bin bei beiden sehr fleißig gewesen diese Woche. Ich habe ungefähr, ich glaube, 20 Issues geschlossen und habe endlich mein Rewrite so weit hinbekommen, wie ich das haben wollte. Ja.

00:04:54 Personaplex habe ich gehört, aber nicht benutzt tatsächlich. Wie schafft man das? Ich war das ganze Wochenende dran, ich habe es die ganze Zeit unter der Woche laufen lassen, ich habe bei Claude wirklich mehrere Agents die ganze Zeit laufen lassen. ChatGBT lief, ich glaube 48 Stunden am Stück, ohne dass ich einmal interveniert bin und hat mehrere, also jedes Mal, wenn ChatGBT was gemacht hat, hat es ein ChatGBT-Evaluator gespawnt, um zu evaluieren, ob das in Ordnung war, was es gemacht hat. Das...

00:05:21 brennt sich halt komplett durch alle Tokens durch, aber macht eine bessere Qualität im Code und das war es mir halt wert. Personaplex, so, das war das, was ich aufmachen wollte, vielen Dank. Personaplex, 7b war das? 7b. Das hatte ich gelesen im Morphreader, aber ich hatte es nicht selber getestet bislang. So, was haben wir hier? Envidia Personaplex, Paper. Oh.

00:05:56 In Speech Model war das. Oh, das habe ich ganz falsch abgespeichert. Oh, geil! Wie gut ist das? Sota? Echt jetzt? Okay, Full Duplex ist halt selten. Das gibt es halt quasi gar nicht. Ach du Scheiße, das hat 7 Beats. Das ist ja gar nichts. Hä, das ist ja mega gut.

00:06:29 Achso, das Ding ist, ich habe mir gerade Nemotron angefangen zu installieren. Wie gesagt, dafür muss ich den Rewrite machen. Ne, ist kein neues Mikro, das ist das, was ich schon jahrelang benutze. Welche Specs hast du, wo du deine Modelle... Ich habe eine 5090 hier eingebaut.

00:06:54 Das ist ein SM7B, kein SM58, aber 1500 Euro für ein Mikrofon wäre tatsächlich ein Investment, weil ich ja auch, also ich habe ja bei ihm auch Gesangsunterricht und das ist ein saugeiles Mikro, das muss ich euch kurz erzählen. Also ich habe das nicht und es ist keine Werbung. Ich werde deswegen auch keine Namen nennen, aber das ist ein Mikrofon, das...

00:07:19 Du kriegst eine Software hinten dran und kannst es sogar in deinem Audiointerface, also normalerweise pipet man ja so ein Mikro nicht direkt in den Rechner rein, sondern steckt es in ein Audiointerface. In meinem Fall ist es ein Rodecaster, aber wenn du eins von der Marke hast, dann kannst du in dem Audiointerface und auch in deinem Rechner einfach einstellen, ey jo, das Mikro soll sich bitte anhören wie ein Neumann. Das soll sich bitte anhören wie ein SM7B, wie ein das, wie ein das. So es wechselt quasi die Art, wie es sich anhört, was halt laut ihm der...

00:07:47 geilste Scheiß ist, weil man dann halt relativ live sehen kann, was da eigentlich passiert. Genau. Ist es KashiOS? Ne, ist es nicht. Das ist nichts OS. Dazu kommt am Sonntag das Video raus. Das muss ich am Sonntag rausbringen, weil es gibt einen gewissen Independence Day und der ist diesen Sonntag wieder und deswegen wird da ein Video von mir rauskommen.

00:08:12 Genau. Also das Mikro hört sich mega geil an. Ich hab's halt noch nie benutzt. Er hat so eins, er schwört drauf. Und ich weiß auch noch nicht, ob ich mir diese krasse Version dann hole. Aber es gibt mehrere Abstufungen. Aber davor will ich halt rausfinden, ob das überhaupt funktioniert. Genau. Das ist was anderes. Das ist wirklich Tonstudio-tauglich. Ja, genau. Und ähm...

00:08:34 Wie gesagt, er ist Musiker, er unterrichtet mich auch, was das angeht, er gibt mir Sprach, also quasi, dass ich deutlich spreche, dass meine Stimme nicht shit ist, weil das ist voll geil eigentlich, richtig geile Geschichte. Ich hatte, wann habe ich angefangen, vor drei oder vier Jahren habe ich mit dem Unterricht angefangen, da war es so, dass ich, wenn ich eine Vorlesung, also ich hatte dort einmal so einen Vorlesungsblock, da wurde alles aufgezeichnet, wurde die ganze Vorlesung sozusagen aufgezeichnet von der Hochschule.

00:09:01 Und wir haben alles in deren Studio aufgenommen, mit einem Schlag durch. So, das war irgendwie so eine Aufnahme von so sechs Stunden oder sowas und ich war danach, ich war so todesheiser. Ich habe von diesen Tabletten, diesen Sprechertabletten, habe ich irgendwie vier oder fünf Stück gelutscht. Da kriegst du voll den ekligen Hals von und deine Stimme fühlt sich belegt an, aber du kannst weiterreden. Und danach war ich erst mal drei Tage heißer.

00:09:23 Und dann habe ich mit dem Unterricht angefangen, weil ich halt gemerkt habe, okay, das passiert auch, wenn ich einfach nur einen Vortrag halte, das passiert, wenn ich zu lange YouTube aufnehme, das passiert eigentlich immer, vor allem, wenn ich streame. Und seit ich jetzt bei ihm im Unterricht bin, habe ich nicht nur growing gelernt, was cool ist, sondern ich habe halt auch gelernt, damit umzugehen, wenn ich viel spreche, dass meine Stimme nicht so belastet wird. Das heißt, ich presse nicht mehr. Genau. Und ja.

00:09:51 Ja, Livestream ist logischerweise leiser. Wie gesagt, ich habe es ja extra nachbearbeitet. Also wir bearbeiten, ja. Das kann ich in einem Stream leider nicht machen. Genau. Jetzt wollte ich hier weiterlesen, weil ihr mir gerade das coole Ding hier geschickt habt. Also, Personaplex. Das sieht geil aus, man. Speech-to-Speech-Conversational-Model. Personaplex can generate English-Speech-Response for English-Speech-Input. Das ist halt wild. Das ist halt ein...

00:10:21 Und das ist halt quasi ein LLM, das aber keine Sprache als Output hat, sondern Voice als Output hat. Also quasi wie ein Gesprächspartner. Das ist ja eigentlich was. Ah, okay. Hui. Oh, okay. Das ist ein anderes. Das ist eigentlich was, was man normalerweise erwarten würde, dass man da dann auch die ganzen Benchmarks mit reinbringt. Weil wenn ich mich jetzt mit Gemini oder sowas unterhalte, würde ich ja davon auch eine richtige Antwort haben.

00:10:52 Das ist ein anderer Use Case, ein ganz anderer Use Case, aber geil, man. Holy moly, das ist richtig beeindruckend. Wo wir momentan hingehen, ist insane. Ich habe heute erst, wie gesagt, Nemotron bei mir mal geladen. Hier, das ist das Nanomodell. Habe ich das Nanomodell geholt? Ja, es ist das Nanomodell, die anderen kann ich nicht laufen lassen. Und ich habe die kleinere Quantisierung genommen, damit das geht. Ähm, Nemotron, die...

00:11:24 Ich hab die FP4, aber ist egal. Ich zeig's euch einfach mal. Nemotron ist auch ein Sprachmodell. Es ist richtig gut. Also es ist beeindruckend gut. Ist halt auch Open Source und es ist von Nvidia. Ich find's spannend, dass Nvidia jetzt auch hingeht und sagt, ey jo, wir veröffentlichen unsere Modelle. Ist ein ganz normales, also ganz normales LLM, wobei es nicht so large ist mit seinen 30 Milliarden Parameter und vor allem sind hier nur drei aktiv. Ich hab's leider noch nicht, ähm...

00:11:49 dauerhaft drin, also ich hatte es quasi vor meinem Rebuild mal so ausprobiert und dann ja. Was ist aus dem KI-Brain geworden? Kommt doch, kommt doch, kommt doch. Moment, Game? KI-Game? Also es ist ja nicht KI-basiert in dem Sinn.

Vorstellung der KI-Stimmklonungs-Tools

00:12:0700:12:07 Wann kommt mein Rechenzentrum eigene AI-Projekte zu machen? Ey, ohne Witz, ich hätte so gerne eins. Ich hätte so gerne so ein Stack von irgendwie so H100 oder die neuen, die 200er. Das wäre schon cool. Okay, jetzt können wir eigentlich richtig anfangen. Jetzt haben wir schon halb vorbei. Wo sind wir? Das brauchen wir gerade nicht. Das wollte ich euch nur kurz zeigen. So, ich habe Fish Speech runtergeladen und mal installiert. Ich habe das vorhin auch mal ausprobiert. Ganz kurz, ob es läuft.

00:12:35 Ich mach kurz für euch Fisch Audio auf. Fisch Speech 1.5. Nein, das hört sich nicht an wie ein Fisch. Aber, der große Unterschied ist, wenn ich mal hier kurz auf die Modelle gehe. Hier. Wenn wir uns das angucken, dann sind wir bei Text to Speech. Und das Ding ist, es gibt andere Modelle, die eigentlich besser sind für TTS. Also sowas wie QN3 TTS ist halt mega gut.

00:13:08 Wie genau lass ich die Modelle laufen? 48 GB, was? 48 GB VRAM hast du? Krass. Ich lass es tatsächlich einfach hier rauf bei mir laufen. Also ich hab ja keine 48 GB, ich hab 32 GB. Und gleichzeitig brauch ich halt noch einen gewissen kleinen Rest für alles andere. Also für den Stream zum Beispiel gerade, für wenn ich ganz normal arbeite, weil es muss im Hintergrund meistens laufen. Deswegen...

00:13:36 Ja, CloudBot ist ein ganz eigenes Thema. Müsst ihr wahnsinnig vorsichtig sein, bitte. Also bitte nicht einfach so CloudBot benutzen. Das Ding ist potenziell ein riesiges Einfallstor. Also nicht gedankenlos einfach machen lassen. Der nimmt sich halt Rechte für alles. Ich wollte eigentlich ein Video dazu noch machen, aber es ist ein ganz eigenes Thema. Ich habe es überlegt, nächste Woche mal als Video zu machen. Das Problem ist, es kommt so viel wieder auf einmal raus. Ich weiß gar nicht, was ich als erstes machen soll. Das ist Wahnsinn.

00:14:05 RTX 3090 mit 48? Achso, da hast du zwei RTX 3090 oder wie? Ah, so rum. Genau. Also es gibt eigentlich bessere Text-to-Speech-Sachen, so Kokoro zum Beispiel ist mega geil und hat nur 82 Millionen. Das Problem ist, Kokoro unterstützt kein Deutsch. Kokoro unterstützt, glaube ich, Englisch. Und das war's, oder? Jetzt hört ihr mich wieder. Hi, sorry. Es sind noch Dinge da, die ich fixen muss. Danke, danke, danke. Ich bin wieder da.

00:15:19 BW, ja, perfekt. Okay, also, es hat einen Haufen, Haufen Sprachen, inklusive sogar Deutsch und Portugiesisch. Jetzt müsstet ihr mich wieder hören. Und, genau. Deswegen, das ist eins der wenigen Modelle, die wirklich so State of the Art sind. Und dann sogar, eine Sekunde, wo ist es? Ich glaube, es ist noch gar nicht so alt. Gab ein neues, nee, nee, das ist das nicht. Audio, hier, wo ist es denn?

00:15:56 Doch, das ist schon voll alt. Das ist schon ein März. Ich habe das einfach nicht mitgekriegt. Shame on me, ey. Wirklich. Die ganze Zeit am nichts anderes machen, außer sich mit solchen Modellen beschäftigen. Und dann kriegt ihr nicht mal mit, wenn sowas passiert. Naja, auf jeden Fall habe ich Fisch-Audio mal ausprobiert. Soprano kenne ich auch nicht. Verdammt. Eine Sekunde. Soprano. Kannst du Deutsch? Naja. Die sind auch sehr viel kleiner. Die sind alle so viel kleiner. Mann, ey. Okay.

00:16:32 96 GB RAM ist halt wild. Opa editieren? Was machst du denn? Ist ja mega. Vibe Voice kann glaube ich auch kein Deutsch, richtig? Word Error Rate ist relativ niedrig, das ist schon mal gut. English Only, ja.

00:17:05 Genau also gerade für deutsche sprache ist es mega selten dass man irgendwie ein vernünftiges modell bekommt und ich habe das gefühl es tut sich auch gerade in dem space nicht mehr so viel deswegen habe ich mir das hier vorhin mal runtergeladen und installiert jetzt will ich es mal kurz ausprobieren und ich weiß gar nicht genau wie das läuft aber ich hatte mir ein paar sachen angeschaut wir brauchen tools, ne? Tools gab es was

00:17:35 Genau der API Server. Wir probieren das jetzt einfach mal, würde ich vorschlagen. Und, ähm, wie ist so Python laufen? Run Web UI. Oh, naja. VNV. Ob ich die VNV finde? Das passiert, wenn ihr einfach der KI sagt, installier mal für mich. So eine Sekunde. Das neue AI Studio von Google. Google Audio ist auf Deutsch. Ah, das ist nix OS. Also es ist nicht so.

00:18:37 So unique. Wie gesagt, am Sonntag kommt ein Video dazu. Das neue AI Studio. Das neue AI Studio von Google. Tatsächlich kenne ich das nicht. Also je nachdem, was du mit neu meinst. Haben sie was Neues gemacht? Das Problem ist, ich kann euch Google eventuell nicht zeigen, weil ich eventuell auf etwas Zugriff habe, was ich euch noch nicht zeigen darf. Das habe ich gerade nicht auf dem Schirm. Gut, es ist Gemini, Veo, Nano Banana Pro.

00:19:21 Da weiß ich nicht, ob ich das darf. Also ich kenne das AI Studio zumindest. So, okay. So, Fish, Speech, Insta. Ach, ich bin schon eins zu tief drin. Da außen war die, oder? Hier war die vorhin irgendwo Kate. Genau, ich hätte mir nämlich vorhin extra ein Skript schreiben lassen. So nehme ich für die Nixos Libraries. So, jetzt wird die Sache was. Ach halt, ich bin ja schon hier.

00:20:00 Okay. Punkt slash tt. Das. So. New Text hier. Genau. Das seht ihr nicht mehr. Das seh ich auch nicht mehr. Seht ihr das noch? Das seht ihr noch. Perfekt. Und jetzt werde ich einmal kurz was ausprobieren. Hallo Chat. Was geht heute? Probieren wir mal. Wenn ich jetzt gleich weg bin, dann liegt es daran, dass meine Grafikkarte ein bisschen am Leiden ist.

00:20:43 Es geht, 66 Prozent. Ah, das war's. 61 Prozent ist voll okay. Das ist voll okay. So, Output? Output wo? Ah, Output.Wave. Output.Wave wo? Wo? Output.Wave.

Aufnahme und Analyse der Referenzstimme

00:21:0200:21:02 Ah, Outbook, hier. Hallo Chat! Wetzel, alle... Herz geht heute bei euch. Das war schwierig. Ich glaube, da müssen wir nochmal ran. Aber es ist nicht schlecht, oder? Also ich meine, das ist an sich ganz geil. News, Open Source, and with...

00:21:24 Das ist schon mal nicht so verkehrt. Ich weiß nicht, ob ihr es hören konntet. Hallo, Chat! Let's get on the... Fats geht heute bei euch. An sich nicht verkehrt. So. Jetzt habe ich gelesen, man kann sich damit seine Stimme klonen lassen. Das habe ich noch nicht ausprobiert. Ich glaube, wir müssen auch noch mal mit der Sprache ein bisschen ran. Es ist aber Auto-Detect.

00:21:58 Probieren wir es... Oh, warte, was macht Temperature? Sampling Temperature. Es gibt ein Top-P. Es gibt das Device. Oh, ich kann es auf der CPU laufen lassen. Das ist praktisch. Ich könnte einen Server starten, den brauche ich nicht. Probieren wir es mal hiermit. Meine Grafikkarte springt dann einmal kurz auf 60% oder sowas hoch.

00:22:33 Und dann ist es fertig. Das sehe ich nicht mal wirklich hier als Bump. Also ich habe nebenbei B-Top offen. Da sehe ich so ein bisschen, was quasi an Auslastung gerade da ist. Aber es ist echt nicht so viel. Output würde ich mal wieder löschen. Brauchen wir nicht. So, jetzt Französisch. Das war gut. Ja, ja, ja. Ich sehe, was du meinst. Der hat das Ausrufezeichen mitgesprochen. Aber Bonjour LeMond hat er nicht das Ausrufezeichen mitgesprochen. Aber Temperature war nicht schlecht.

00:23:26 Habt ihr Spaß? Nur mal kurz gucken wie sich das verhält mit Komma vielleicht habt ihr Spaß? Schreibt's in den Chat. Probieren wir mal was aus. French hat echt gut funktioniert. Ah, jetzt brauchst du ein bisschen länger. Habt ihr das gesehen?

00:23:54 Ja, vernachlässigbar. Das ist echt okay. Das Ding ist, das Modell ist geladen und es braucht halt so ein Gigabyte in der Grafikkarte. Das ist nicht viel. Und das läuft halt bei mir lokal auf dem Rechner, während ich mit euch hier gleichzeitig streamen kann. Also das ist beeindruckend. Das ist einfach so ein Mini-Modell. Das juckt nicht mal mehr. Hallo Chat, was geht bei euch? Habt ihr Spaß? Schreibt's in den Chat. Das ist nicht schlecht. Okay.

00:24:27 Das Ding ist nämlich, bisschen Hintergrundgeschichte, warum ich das gemacht habe. Ich zahle jeden Monat für 11 Labs 20 Euro. Und ich zahle dann nochmal bei OpenAI für die Tokens, also über die API, zahle ich nochmal ungefähr 20 Euro. Moment, das war mehr sogar, eine Sekunde. Das kann ich euch sogar genauer geben. Das kann ich euch genauer geben. So.

00:24:56 Nee, ich habe über 200 Euro im letzten Monat gezahlt, nur für Sprachgenerierung. Und das finde ich halt nicht okay, wenn es so ein arsch kleines Modell ist. Das ist nicht schlecht. So, und jetzt pass auf. Ähm, man kann seine Stimme klonen, habe ich mir von der KI sagen lassen. Mit Curl. Ah, das ist nicht im Skript drin. Oh, okay, scheiße. Okay, ähm, dann muss ich mal einmal kurz was aufnehmen.

00:25:38 Damit wir da auch eine gute Referenz haben. Ich habe eigentlich schon was aufgenommen, aber es ist zu viel. Man muss weniger aufnehmen. So, mal gucken. Habe ich Oddacity installiert? Das ist die Frage. Ich habe Oddacity installiert. Hallöchen. Das ist immer das Ding, wenn man ein System so relativ neu hat, dann hat man das vielleicht noch nicht so viel gemacht. Ups, das seht ihr wieder nicht. Eine Sekunde. So seht ihr noch, so seht ihr noch.

00:26:09 Warum nicht direkt mit QWEN3 TTS? Weil QWEN3 nicht so richtig Deutsch kann. Zumindest hatte ich das hier nicht gesehen. Ich habe gelogen, QWEN3 kann Deutsch. Fuck. Okay, danke. 12-Hertz, 1,7B, Bass, Custom Voice, Voice Design. Ist es besser?

00:26:51 Dann machen wir einen Vergleich, würde ich sagen, Leute. Gut. Modelsgrobe ist unterstützt. 1,7b müsste ich reinbekommen. Das sollte kein Thema sein. Eine Sekunde. Ähm...

00:27:50 Das Linux ist ein NixOS. Das, wie gesagt, kommt am Sonntag das Video raus. Wir haben das neue Gold. Ey, wirklich. Wie bin ich auf das Modell gekommen? Ich habe tatsächlich einfach gegoogelt, welches Modell Deutsch kann.

00:28:06 Chinese Beijing Dialect, wenn man merkt, wo es herkommt, ey. Das ist so unfair. Mach mal hier ein deutsches Modell bitte. Das ist doch der Wahnsinn. Ja, cool. Okay. Dann probieren wir das als nächstes. Also ganz ehrlich, ich brauch sowieso einen Python. Von dem her, ups. Von dem her probieren wir es dann direkt danach. Dann lass ich mir einfach ein Skript schreiben. Hi. Ja, freut mich auch. Es gibt zum Rekorden spezielle Sätze, wo die wichtigsten Dinge drin vorkommen. Welche? Muss ich das nochmal nachlesen? Voice Cloning.

00:28:47 Die Berliner Sätze, die werden in der Sprachtechnologie benutzt, um alle wichtigen Lautkombinationen des Deutschen abzudecken. Berliner Sätze. Berlinerisch GPT. Ich weiß nicht, ob das das ist. Palpa TTS kenne ich, genau. Das ist aber, das ist halt schon ein bisschen älter. Kann man auf Hugging Face ausprobieren. Kogui, genau. Kogui war nicht so gut. Ich habe Kogui mal probiert. Oder ich weiß nicht, wie man es ausspricht, aber ja.

00:29:38 The model isn't deployed. Vielleicht ist ein anderes Modell deployed. ASR hat es auch. Die sind so krank mittlerweile. 1.7b. Nicht deployed. 0.6b. Das ist ein 0.6er Modell. Nicht deployed. Machen wir alle auf hier. Wenn, dann brauchen wir schon das... Ah, das Tokenizer ist ein separates Modell. Nicht deployed. Ah, da war es doch gerade.

00:30:06 Ah ne Model Tree, not deployed. Not deployed? Not deployed, okay. Das ist okay. Also ich meine, ich will eh dann bei mir das ganze Berliner Sätze für... So. Für QN3 TDS gibt es einen Demospace. Ne, ich hatte keine 2080, ich hatte eine 3090, aber den hat jetzt meine Katharina. Das ist Linux, ja.

00:31:01 Vibe voice ja habe ich mir auch schon angeguckt aber das konnte auch kein habe ich mich jetzt auch verguckt kann es auch deutsch hier bei bei wo ist es bei boys hier so bei boys 15 das hier was glaube ich das ist auch deutsch kann das doch englisch dem model ist trained only on english und chinese data outputs in aller languages unsupported deswegen das hatte ich dadurch speziell nachgeguckt weil ich gegen bei boys auch was gesehen hatte

00:31:30 Danke. Torsten Voice? Was? Okay, geil. Okay, warte, dann machen wir das mal hier. Ich würde da jetzt einfach mal... Das hier ist ein Test für Voice Cloning als Demo mit...

00:32:14 TTS. So, mal gucken. So, und... Ah, hier kann ich's einstellen. Okay, das würde natürlich helfen, man muss es nicht selber machen. Voice Description. Speaking in incredulous tone with a hint of panic beginning. Okay, okay, okay. Oh, okay. Probieren wir. Das finde ich gut. Können wir ruhig machen. Also, finde ich super. Können wir lassen.

00:32:40 Thorsten Voice benutzen manche Streamer als TTS. Gut, ich würde halt meine eigene Stimme gerne klonen wollen. Muss drüber bei den Reitern. Achso, ja. Aber, warte kurz. Das hier ist ein Test für Voice-Cloning als Demo mit Quon3-TTS. Nicht schlecht. Plötzlich adelig geworden. TTS. Ah, und hier kann ich quasi den Sprecher auswählen. Model Size auswählen. Geil. Okay, cool.

00:33:22 Okay, ich suche immer noch nach den Berliner Sätzen und Gemini weigert sich. Was hat der genommen? Das ist eine gute Frage. Es steht extra dabei, dass er Panik hat. Hier, warte. Bei der Stimme steht, Yo, incredulous tone, but with a hint of panic beginning to creep into your voice. Boredom. Beginning to creep into your voice.

00:34:01 Queen3 TTS braucht ein großes Dataset. Ist kein Problem. Ich habe meine Stimme schon für Eleven Labs geklont. Da habe ich zwei Stunden oder so aufgenommen. Das hier ist ein Test für Voice Cloning als Demo mit Queen3 TTS. Ja, kann man machen. Ich mache es für euch ein bisschen leiser. Die Berliner Database of Emotional Speech. Sotjack 1984 für phonetische Ausgewohnheiten.

00:34:39 Hier die zehn standardsätze das ist es dankeschön das war Gemini Eine Sekunde ich hab das da Okay, dann machen wir das doch mal hier rüber und machen uns Audacity hierher So check check richtiges Mikro ausgewählt So check check richtiges Mikro ausgewählt offenbar ja Die da? Ne warte die da, meinst du oder? Die zehn standardsätze Was passiert wenn du die Voice description in deutsch schreibst würde mich noch interessieren

00:35:21 Das ist eine gute Frage Guck mal in Gottes Namen, was du ist das hier ist ein Test für voice cloning als demo mit quo in 3 tts Das hört sich nicht so an als würde der das machen was ich möchte nehmen Der hat noch was anderes vor Ich würde Ja

00:36:29 Ja, der will ganz bestimmt was anderes machen mit uns. Ne, ähm, wo sind die Sätze? Berlinersätze, da. Elevenlabs ist leider saugut mittlerweile, aber es ist halt auch arschteuer. Also bei denen, ich kann es euch gleich mal zeigen, ich habe das offen. Ähm, das kann ich euch eigentlich auch direkt zeigen. Einmal hier, e, wobei ich bin nicht angemeldet, eine Sekunde. Elevenlabs. Da habe ich ja meine eigene geklont irgendwann. Das ist das.

00:37:05 Welche Zugangsdaten? Welche Zugangsdaten? Damn! Ah, da! So, Text-to-Speech. Wo hab's denn? Was war das? Das mochte mich gerade nicht. Ich muss aufpassen, dass ich euch nicht oben abschneide. Ich will keine Affiliate werden hier. Wo bin ich? Da ist der Trick. So. Eleven Laps. Eleven 3 hat nicht so gut funktioniert. Das könnte man wohl auf anderen... Ja, ja.

00:37:50 Ah, die Stimmbeschreibung? Okay, alles klar. Ich habe doch gerade hier noch irgendwo was aufgehabt, was ich einfach gucke an. Das hier. Und wo ist das? Das hier. Mit, natürlich nicht quen, 11labs.tts. Hallo, ihr tollen Menschen. So, das wäre dann.

00:38:23 Das hier ist ein Test für Voice Cloning als Demo mit Eleven Labs TTS. Hallo, ihr tollen Menschen. Das hat mal besser funktioniert. Ich schwöre, es hat mal besser funktioniert. Nee, Mann. Ich klinge mich nicht zu glücklich, ja? So klinge ich einfach nicht. Stability... Similarity vielleicht... Nee, am besten.

00:39:05 100 Agenten von KimiK2. Nein, hab ich nicht. Das war mein Elevenlabs-Klon gerade. Der ist, äh, ich glaub, gerade ein bisschen drauf gewesen. Es klingt ein bisschen besser, aber... Hm. Lass mich nochmal machen. Das hier ist ein Test für Voice-Cloning als Demo mit... Kein Fan. Kein Fan. Wirklich nicht. Wirklich nicht. Wirklich nicht. Oh, nicht Liam. Hallo. Nimm mich. Hallo? Mit eigenem Voice, das weißt du schon.

00:39:44 Das hier ist ein Test für Voice Cloning als Demo mit Eleven Labs TTS. Hallo ihr tollen Menschen! Das ist halt schon geil. Also der Voice Cloning kann mit V3 nicht so gut, aber das ist halt leider wirklich, wirklich gut.

00:40:16 Das hier ist ein Test für Voice Cloning als Demo mit Eleven Labs TTS. Hallo ihr tollen Menschen! Ja, und das versucht man irgendwie hinzubekommen. Also ich meine, die vorgefertigten Stimmen sind halt schon meistens ein bisschen besser. Und ich glaube, sie haben mir die Stimmen ein bisschen zerschossen tatsächlich.

00:40:43 Wir müssen erst auf... Hatten die nicht mal ne Version 2.5 irgendwie? Nicht nur... Turbo? Turbo 2.5 war's. Ich glaub, damit war's besser. Lass mal gucken. Das hier ist ein Test für Voice Cloning als Demo mit Elevenlabs TTS. Hallo, ihr tollen Menschen. Nee. Nee. Nee. Nee.

00:41:22 Also, ja, Elevenlabs ist nicht schlecht, aber halt arschteuer. Und deswegen will ich was, was lokal bei mir auf dem Rechner läuft. So, wir probieren jetzt die beiden. Ich probiere das jetzt, indem ich mir die Berlin ersetzliche aufnehme. Der Lappen liegt auf dem... Wobei, ich sollte das nicht so überbetonen sein.

00:41:47 Der Lappen liegt auf dem Eisschrank. Das will sie am Mittwoch abgeben. Heute Abend könnte ich es ihm sagen. Das schwarze Stück Papier befindet sich da oben. In sieben Stunden wird es soweit sein. Was sind denn das für Tüten, die da unter dem Tisch stehen? Sie haben es gerade hochgetragen. Irgendwann muss es ja mal geschehen. Ich will das eben wegbringen. Die wird auf dem Platz sein, wo wir sie immer hinlegen. So, jetzt explodieren wir das. In...

00:42:20 Machen wir mal Musik rein. Ist ja richtig musikalisch heute, Mensch. Berliner Sätze. So. Können wir was anderes nehmen. Wir nehmen Wave. Ist schon in Ordnung. Wir nehmen... Wir nehmen Wave. Stereo brauchen wir eigentlich nicht, ne? MP3 8kHz. Wenn du den Voice-Klon direkt zerschießen möchtest.

00:42:58 Ich nutze es tatsächlich aktiv. Die Artikel beim Morph Reader, also ich weiß nicht, ob du die Morph Reader kennst, die App von mir. Die Artikel vom Morph Reader werden alle mit TTS vertont. Das habe ich gemacht, damit man, also, warte, ne, kann ich dir nicht zeigen. Doch, könnte ich, aber dann wird wahrscheinlich das ganze System weg. Ich erkläre es dir. Und zwar folgendes, wenn du im Morph Reader einen Artikel bekommst, der aktuell die Wichtigkeit

00:43:28 9 oder 10 hat auf deutsch also nur auf deutsch aktuell dann wird der artikel vorgelesen so das mache ich momentan mit 11 labs und wenn ich bei 11 labs keine credits mehr habe mache ich das mit ob mei boys und die sind halt arsch teuer deswegen gebe ich im monat ungefähr 220 euro für stimme aus oder 220 euro für text to speech was es einfach nicht wert ist weil das läuft einfach lokal bei mir auf dem rechner

00:43:54 Und wann ich die Dinger mit einem Audio versehe, ist halt mir relativ egal. Das kann ich auch einfach mal in der Nacht machen sozusagen. Und dann sind die halt danach vertont. Und das Coole dabei ist jetzt allerdings, wenn ich das halt bei mir laufen lasse, dann muss ich mich einfach aus Kostengründen nicht nur auf die 9 oder 10 beschränken, sondern kann die Wichtigkeit runterstellen auf 1, kann quasi jeden Artikel auf Deutsch vertonen, jeden Artikel auf Englisch vertonen, jeden Artikel in jeder Sprache vertonen.

00:44:20 ohne dass es mich allzu viel kostet. Wenn ich das allerdings bei OpenAI in der API mache, werde ich arm. Dann zahle ich im Monat irgendwie 800 Euro oder sowas, nur für Text-to-Speech. Und ich bin ja jetzt schon bei, keine Ahnung, 200... Warte.

00:44:33 208 Dollar nur bei OpenAI plus dann noch das, was ich bei 11Labs zahle. Deswegen das ist schon, also für mich wäre das tatsächlich mal ein bisschen günstiger, weil OpenAI ist lächerlich teuer. Also generell Text-to-Speech ist lächerlich teuer. Bei denen, wirklich, OpenAI, du zahlst nichts für irgendwie so ein LLM, also für GPT 5.2 oder sonst irgendwas, zahlst du fast nichts. Aber für Text-to-Speech wirst du arm für. Das ist einfach krank. Deswegen probieren wir das jetzt. So, das ist Fisch.

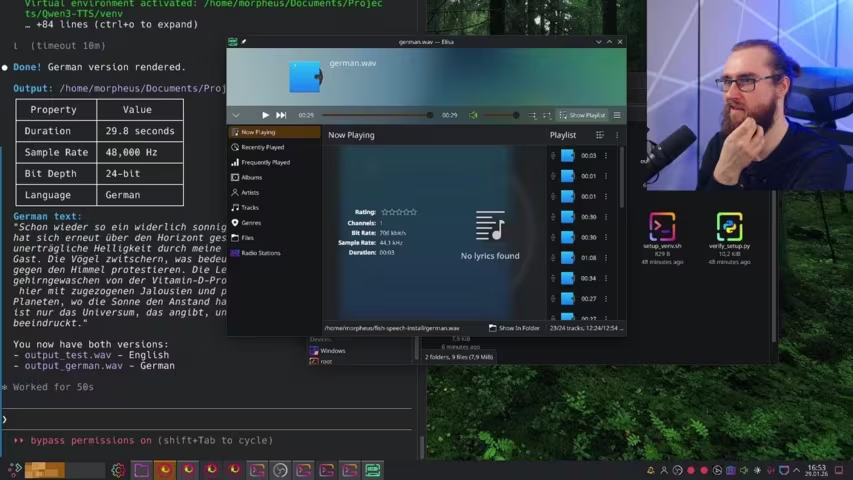

Stimmenklonung mit Fisch Speech und lokaler Ausführung

00:45:0200:45:02 Fisch? Fisch. Okay, wie kann ich dich fein trainieren? Lass ich das die KI einfach machen? Das kann ich auch einfach die KI machen lassen, oder? Wo ist das? Music. Oh ja, es hat funktioniert. Ich glaube, das könnte schon reichen.

00:46:39 Hast du da gegebenenfalls eine Liste von TTS-Engines, die das Voice-Cloning-Feature mitbringen? Es gibt einen Haufen von denen. Also ich habe hier, ich weiß nicht welche alle Voice-Cloning können. Es gibt bei HuggingFace einfach einen Haufen Open-Source-Models, die du einfach runterladen kannst. Also hier kannst du wirklich einstellen. Ich hätte gerne, wo sind wir? Text-to-Speech, das ist da.

00:47:03 Und dann kriegst du hier 3972 Modelle. Das kann ich dir gerne reinschicken. Eine Sekunde, wo bist du? In YouTube. Shit, wo kann ich dir schicken? Eine Sekunde, ich suche Restream. Chat. Für 800 kannst du die zwei...

00:47:27 Lokal ist halt Endlevel, ja. Mein Amiga könnte das serienmäßig ohne Abo. Ich dachte, der Morph nutzt das Standard-Handy-Modell. Nee, nicht mehr. Hab ich früher gemacht. Früher hab ich tatsächlich jedes, also konntest du einstellen in den Settings, dass du quasi automatisch vertont bekommst, wenn ein Artikel da ist. Das ist quasi, wie gesagt, zum Autofahren oder halt für Leute, die nicht lesen können, beziehungsweise halt, ne, blind sind oder so, kannst du einfach sagen, let's play. So, fertig. Du musst es nicht...

00:47:56 Du musst nichts machen. Aber das Problem war, dass die Qualität von dem lokalen Handy-Modell einfach furchtbar war. Ja, gut. Text-to-Speech und Text-to-Audio. Text-to-Speech ist Sprache. Text-to-Audio ist auch Musik, Soundeffekte und sowas. Ich zeig's dir mal. Hier. Mula ist Musik, glaube ich. Stable Audio ist auch, meine ich, Musik. Hard. Vibe Voice? Vibe Voice sollte eigentlich... Ah, nee. Vibe Voice kann, glaube ich, auch noch...

00:48:30 Hier Soundeffekte mit generieren Das ist eigentlich Ja teilweise benutzen sie beide Kategorien Riffusion ist zum Beispiel nur Musik Music Gen ist nur Musik Das ist eigentlich auch Sprache Das ist auch wieder Musik Genau Vox Populi Alter Jetzt wird's aber hier Lateinisch So wie als immer Claude Claude ist fertig Geil Python... Nicht das gräbt Du Arsch Guten Tag, wie geht das Ihnen? Okay, probieren wir

00:49:08 Ich bin faul heute. Leute, ich bin scheiße faul geworden. Das ist echt schlimm. Thorsten Weiß hatte vorhin schon jemand vorgeschlagen. Deutsche Stimme unter CC0 Lizenz. Das ist schon geil. So, merkt's, was funktioniert nicht, ne? No module named sound file. Immer dasselbe mit diesem Ding. Gibt es auch eine Voice App von den führenden Anbietern, die mit Android Auto funktionieren? Ähm, ist Gemini nicht mit Android Auto? Ich glaube, das sollte damit funktionieren. Oh, sorry.

00:49:46 SciPy? Warum willst du denn jetzt SciPy benutzen? Jesus. Nee, das ist Claude. Das ist Claude. Ich habe keine Credits mehr bei Codex. Alle aufgebraucht diese Woche. Das Geile, bei Claude ist halt, dass es... Aha. So nämlich. Nee, warte. Minus Clone. Bro. Es geht. Also je nachdem sind sie... Ich spawn meistens Review Agents vorher und sag denen, ey yo, lies dich mal ein in das, was du zu tun hast und dann werden sie besser. Ähm.

00:50:55 Okay, wenn du das sagst, dass du das brauchst, dann mach das mal. Aha, so, das ist doch schön. Wo wollen wir hin? Output.Wave. Okay. Output.Wave. Guten Tag, wie geht's Ihnen? Jesus, das war gut! Hallo, Chat. Ah, das war die Falsche. Sorry. Guten Tag, wie geht's Ihnen? Ach, das ist gut. Das muss ich nochmal anhören. Eine Sekunde, ich muss lauter machen.

00:52:00 Ja, es ist wirklich nicht schlecht. Also ohne Witz, das ist teilweise besser als das, was ich von OpenAI bekommen habe. Ja, bin gerade dabei. Das wird ein bisschen länger. Das ist wirklich beeindruckend. Das dauert jetzt ein bisschen. Grafikkarte ist bei 60 Prozent und der Stream ist immer noch flüssig, wie es bei mir aussieht. Cool. Finde ich gut. Ich kann das quasi während dem Stream machen lassen. Das ist ja super. Ein bisschen mehr Text geben. Tut er doch. Ja, bin gerade dabei. Das hier ist jetzt Fish. Hier, Fish Audio. Fish Speech.

00:52:35 Ey, meine Oma würde ich damit kriegen, ich sag's, dieses... Bin ich off? Ich bin nicht off. So, gucken wir mal.

00:52:46 Ist das Output long? Wow, das ist ein bisschen sehr entspannt, der Kollege.

00:53:11 Ja, gut. Also, ich meine, es ist nicht scheiße. Aber der Kollege ist ein bisschen arg entspannt. Der Klang in der Stimme passt sehr gut, ja.

00:53:42 Doch tatsächlich bin ich das. Hi, freut mich. Also die Stimme ist zum Verwechseln ähnlich, aber der Kollege ist, ja, die Gedankenspräche, war das das Modell? Nee, das war nicht das Modell. Vielleicht habe ich zu langsam aufgenommen? I don't know, man.

00:54:04 Kann man prima die YouTube-Video-Link mit verlängern. Würde ich nicht machen, ehrlich gesagt. Da klicken die Leute weg. Also, ich würde mir so ein Video nicht anhören, wenn jemand so vorliest. Genau. Die Pausen, die Pausen sind halt ripp. So, warte. Wir werden Audio-ingenieren den Scheiß jetzt hier raus. Oh, da geht's noch weiter. Ups. Darf ich vielleicht nach vorne? Danke. No. Ich kann nicht klicken. Warum kann ich nicht? Warum bin ich ein Boomer, Mann? Scheiße.

00:54:56 Muss ich das jetzt wirklich schon... Ich bin so ein Boomer. Genau, ich habe einzelne Sätze vorgelesen, keinen direkt aneinanderhängenden Text. Das könnte wirklich der Punkt sein. Separat, warte mal. Ja, wobei auf Deutsch. Können die DAW sowas mit Sicherheit? Können die das?

00:55:51 Also live TTS müsste auch gehen doch ich kann das also das ist super schnell im generieren da kann ich dir was generieren quasi wenn jetzt jemand hier im chat eine frage stellt und bei mir läuft irgendwo ein modell durch und antwortet euch darauf das könnte ich fast live los vorlesen Dementsprechend das sollte schon gehen Hörbuch vibe nachrichten assistant vibe du also ich nehme alle finde ich gut da TTS Beispiel du bist so gut du bist so gut alter das ist so smart danke

00:56:24 Die Glocke vorlesen. Auch nicht schlecht. So, pass mal auf hier. Ich habe schlechte Augen. Deswegen muss ich das jetzt leider so machen. Okay. Jetzt darf ich nicht so schlafmützig sein. Das Modell ist schlafmützig genug. Also immer schön mit Schmackes.

00:56:44 Der frühe Morgen legte sich wie eine sanfte Decke über die noch schlafende Stadt. Während die ersten Sonnenstrahlen versuchten, den dichten Nebel zu durchdringen, war es auf den Straßen noch vollkommen ruhig. Nur das leise Rauschen der Blätter im Wind begleitete meine Schritte, als ich langsam den alten Pfad zum Fluss hinunterging. Es ist dieser besondere Moment der Stille, bevor die Welt erwachte,

00:57:07 Der frühe Morgen legte sich wie eine sanfte Decke über die noch schlafende Stadt. Während die ersten Sonnenstrahlen versuchten, den dichten Nebel zu durchdringen, war es auf den Straßen noch vollkommen ruhig. Nur das leise Rauschen der Blätter im Wind begleitete meine Schritte, als ich langsam den alten Pfad zum Fluss hinunterging. Es ist dieser besondere Moment der Stille, bevor die Welt erwacht, den ich so sehr schätze. Man hat das Gefühl, die Zeit würde für einen Augenblick stillstehen, bevor der Trubel des Alltags wieder die Kontrolle übernimmt.

Vergleich von Klonungs-Ergebnissen und Audio-Optimierung

00:57:3200:57:32 Die digitale Transformation hat in den letzten Jahren rasant an Geschwindigkeit gewonnen und verändert grundlegend, wie wir kommunizieren und arbeiten. Dabei spielen Künstliche Intelligenz und maschinelles Lernen eine zentrale Rolle. Es geht nicht mehr um die reine Verarbeitung von Daten. Verdammt, ich hab mich verlesen. Dabei spielen Künstliche Intelligenz... Nein, bei Punkt keine Pause. Das macht der viel zu sehr. Keine Pause. So. Äh, wo war ich? Da. Da.

00:58:02 Dabei spielen Künstliche Intelligenz und maschinelles Lernen eine zentrale Rolle. Es geht nicht mehr nur um die bloße Verarbeitung von Daten, sondern darum, komplexe Zusammenhänge zu verstehen und daraus sinnvolle Schlüsse zu ziehen.

00:58:24 Wer heute technologisch am Ball bleibt und sich neuen Entwicklungen gegenüber offen zeigt, gestaltet die Zukunft aktiv mit, anstatt nur auf sie zu reagieren. Eigentlich wollte ich mich schon viel früher gemeldet haben, aber irgendwie ist mir die Zeit total davon gelaufen. Kennst du das, wenn man tausend Dinge im Kopf hat und am Ende doch nichts davon erledigt bekommt? Ich würde vorschlagen, wir setzen uns die Tage einfach mal entspannt zusammen. Vielleicht bei einem guten Kaffee oder einem Spaziergang im Park, damit wir endlich mal wieder in Ruhe quatschen können. Sag mir einfach Bescheid, wann es dir am besten passt. Ich bin da relativ...

00:58:54 flexibel. Mitten im üppigen Grün des Frühlings blühen nicht nur die Blumen, sondern auch völlig neue Ideen auf. Es erfordert Mut und Übung, gewohnte Pfade zu verlassen und sich auf das Unbekannte einzulassen. Doch genau diese Neugier ist der Schlüssel zu echtem Fortschritt und Veränderung. Egal ob bei stürmischem Regen oder strahlendem Sonnenschein, wichtig ist vor allem, dass man das Ziel nicht aus den Augen verliert und jeden einzelnen Schritt der Reise bewusst genießt. So.

00:59:25 Da muss man vorlesen können für. Ja, ich bin auch raus. So, ich glaube, das sollte gut sein. Wir brauchen ja für Quen brauchen wir noch ein bisschen länger. So, jetzt machen wir das ein bisschen lauter, oder? Erstmal exportiere ich es nicht, dass ich aus Versehen wieder auslösche. Oder lauter, lauter, lauter, lauter. Wie ging das denn? Ich bin doch doof, ne? Export Berliner Paragraph. Export.

01:00:10 Jetzt das hier, das, das und das. Okay. Wir brauchen das nicht mehr. Das hier haben wir auch. Das hier raus. Das machen wir raus. Das passt so. So und machen wir so. So. Das war in Musik. Berliner Paragraph. Cedric. Punkt. Ich nenne es jetzt einfach Berliner Paragraph. So. Macht nur mir einen Feuersinn. Ich glaube nicht.

01:01:00 Vielen Dank ich habe ein paar Fehler gemacht ich habe oft vergessen scheiße Egal das ist viel zu viel Text zum voice cloning reichen 20 Sekunden aus Du warst doch viel zu schnell dazu das Problem ist beim letzten war ich viel zu langsam und er war einfach eine schleiche schleichnase ich glaube das braucht ein bisschen schneller wir gucken jetzt einfach mal wie es funktioniert das kann ja sein dass ich nochmal aufnehmen das muss man einmal anpassen Ich weiß nicht welche ich so oft ich vergessen habe

01:01:45 Pre-Amp kann ich nicht lauter machen. Der ist auch Max. Der ist auf Anschlag. Genauso wie es hier bei mir auf Anschlag ist. Überall auf Anschlag. Nachrichten auf Anschlag. Alles auf Anschlag. Normalisier das Audio-Fall. Ne, es soll ja ein bisschen Varianz drin sein. Das ist ja schon... Also normalerweise, wenn wir sprechen, haben wir auch Varianz drin. Ich spreche ja nicht die ganze Zeit. Habe ich mich bedankt? Ah ja, habe ich tatsächlich. Das ist ein Reflex, das tut mir leid.

01:02:29 Ich spreche auch nicht die ganze Zeit auf derselben Höhe oder derselben Lautstärke. Genau das Phish Audio ist das. Ich suche es mal aus. Eine Sekunde. Phish Speech ist es. Ich schicke es dir in hier ein. Nur 48 GB RAM. Digger. So. Okay. Darf nicht zu schnell werden. Jetzt schauen wir einfach mal, wie es...

01:03:15 Es wird einfach von dem Hintergrund von einem Video das Skript und die Tonspringen. Ja gut Hintergrundmusik habe ich nicht. Das Problem ist, dass ich mich nicht immer an mein Skript halte, dass ich schreibe. Ich weiche manchmal ab.

01:03:30 Das ist ein bisschen unpräktisch von mir. So Output Long.

01:03:55 Danach ging ich in mein Lieblingscafé und bestellte einen heißen Kaffee mit einem Stück Apfelkuchen. Der Duft von frisch gebackenem Kuchen erfüllte den ganzen Raum.

01:04:05 Das ist doch perfekt! Ich weiß gar nicht was ihr habt. Zu schnell von wegen, das ist genau so. Fett halt bei Tumann bestellen. Ja, könnte ich machen, aber dann... Ist das wirklich so? Es ist ein bisschen schmatzig vom Sound. Es ist als würde ich ein bisschen muffeln. Aber es ist schon scheiße gut. Also ehrlich gesagt ist es... Es ist schon sehr nah dran. Also ich bin Fan geworden.

01:04:35 Ja, das ist schon gut. Das ist lokal, das läuft bei mir auf dem Rechner. Das hat hier einmal kurz auf 63% Grafikkarte hochgeschraubt und braucht halt einen Gigabyte an Grafikkartenspeicher. Das ist schon gut. Und Claude hat das Ganze quasi benutzbar gemacht. Das Skript ist nicht von mir. In was für Zeiten leben wir eigentlich alle? Ja, ich kann es nochmal kurz laufen lassen. Hier, das ist Btop. Shit.

01:05:11 Ich switch gleich rüber. Ich mach uns kurz Claude hier. Ich mach Claude kurz auf dem anderen Bildschirm. Satzübergänge sind ein bisschen auffällig. Ja, ich glaub, dass... Also hier, das hier ist mein Grafikkartenspeicher. Das hier. Die 5,2... Ah, scheiße, ich bin drüber. Moment. Ich bin weg. Sorry.

01:05:44 Da, das da. Diese 5,2G, das hier ist die Temperatur von meiner Grafikkarte. Die 5,2G von 32G, das ist quasi mein Grafikkartenspeicher, den ich jetzt gerade brauche, damit ich euch streamen kann. Das ist quasi mein Ruhezustand. Der RAM ist der hier drüben bei 91,8 GB max. Use sind 12,1. So, und jetzt seht ihr hier gleich, wie dieses Modell geladen wird.

01:06:08 7,6 GB und Grafikkarte springt auf 66 % hoch. Das ist von 5,2 auf 7,7 hochgesprungen, das ist jetzt nicht so tatsächlich heftig. Und 65 % Auslastung ist voll entspannt. Meine Grafikkarte friert. Die Grafikkarte ist 10 Grad wärmer als es bei mir im Zimmer warm ist. 10! Das ist B-Top, ja tatsächlich. B-Top ist geil. Ich liebe B-Top. Das ist irgendwie so sexy, ich mag's.

01:06:37 Ja und fertig. Und das war's, der ganze Text ist generiert und jetzt sind wir wieder unten bei 5,2. Also bisschen mehr als ein Gigabyte Grafikkartenspeicher, aber ohne Scheiß, das ist mit geklonter Stimme und du musst es nicht mal fein trainieren. Bei mir sind's, warte, das kann ich dir zeigen. Ah, warte, ich schalte kurz auf mein großes Gesicht um. 25.

01:07:03 Komma sieben Grad im Zimmer. Und ich habe keine Heizung an. Ich habe den ganzen Winter noch keine Heizung hier drin an. Scheiße, ey. Ja, KI. So, ich wandte aber wieder nach oben. Also das ist echt entspannt. Und das war ein langer Paragraph. Das hat mir eine Story geschrieben. Hier, look at that.

01:07:27 Das war der Paragraph. Den spiele ich jetzt einfach mal. Ey, ohne Witz, ich heize wirklich den ganzen Winter mit KI. Ich hab hier sogar die Türe auf, um ähm...

01:07:53 möglichst viel Wärme nach draußen zu befördern, damit wir quasi nah wärmen, ja? Fernwärme nur anders. Es ist heftig, es ist wirklich, ich mach hier teilweise extra mal Fenster auf, damit es ein bisschen kühler wird. Jetzt sind wir gleich bei 26 Grad. Vorlese Morphys Computer, also ohne Witz, ich bin Fan von dem Ding. Das ist wirklich, wirklich gut. Das merke ich mir, das ist richtig geil. So. Welches Command hast du benutzt? Readme.md

01:08:45 Klingt ein bisschen nach Radiofilter, ja. Ja, kann man machen. Also ich meine, man könnte jetzt auch nochmal hier über die Audio drüber gehen und da noch ein paar Effekte drauflegen, dass es ein bisschen mehr nach Podcaster sich anhört. So ein Equalizer oder sowas. Machen wir vielleicht danach. Geht Sprache zu Sprache? Nee, Sprache zu Sprache geht nicht. Ich kann so Text zu Sprache machen. Du kannst bei Phish, aber soweit ich das gelesen habe, auch Emotionen angeben. Das war mein Vorlesetext. Das ist Phish. Wie ging das Phish Audio? Oh, die haben Elon Musk geklont. C3P. Geil.

01:09:22 Moment, das muss ich ausprobieren. Kann ich das? Kann ich mir das anhören? Okay.

01:09:47 Ja, also wenn du das über ein Handy hörst, hörst du keinen Unterschied mehr. Wenn ich da jetzt noch ein Filter... Können wir machen, warte, machen wir, machen wir. Ah, wo ist noch der erste Team? Hier, so. Also das ist jetzt meine Originalaufnahme. Jetzt machen wir hier New. Jetzt machst du dich auf einen anderen Bildschirm auf. Was ist denn mit dir? Ich habe zu viele Bildschirme. So. Ich habe zu wenig Bildschirme tatsächlich. Man hat immer ein Bildschirm zu wenig. Achso, nach unten kann ich ganz, nach oben kann ich nicht ganz. Bis wohin seht ihr?

01:10:20 So ist gut. So jetzt nehmen wir den die Output Long. So das hört sich so an. Heute Morgen bin ich früh aufgestanden und habe einen langen Spre... So jetzt haben wir einen Effekt drauf. Als würden wir quasi durch durch ein Telefon sprechen. Wie machen wir das? Gucken wir mal.

01:10:44 Hier gab es doch irgendwelche Telefoneffekte oder nicht? Plugin Manager, Chirp, DTFM, Noise, Plug... Ich kenn mich nicht so gut aus mit dem Chat. Tatsächlich. Das müsste eigentlich mit Runterrendern auf 8 Kilohertz gehen, aber ich weiß nicht, wo ich das mache. Und wahrscheinlich ein Hochpassfilter, oder? Mit einem Highpassfilter müsste es gehen. Auf 8000. Ich glaube ein Telefon macht auf 8000.

01:11:18 Ja, meinst du? Kein Hochpassfilter? Oh, das ist zu viel. Highpassfilter. Das ist halt sehr leise. Das ist sehr laut. So. Radiofrequenz ist bei einem Kiloherz.

01:12:01 Warte, Low Cut dann, oder was? Und Low Pass? Echt? Was pass ich bei Low rein? 1000! So? So? Bisschen Frequenzbrech rumspielen. Also ich würde da jetzt ehrlich gesagt schon keinen Unterschied mehr hören. EQ und Filters und Presets. Geil. Danke. Okay.

01:12:56 EQ und Filters, Presets, not shelffilter, Graphic EQ? Filter, Graphic EQ? Nein, das war kein Preset. Ich rate jetzt einfach mal, was du meinst. Graphic EQ? Ah! Ne, irgendwie nicht. Also bei 500 ein Hypers. Also wir machen hier unten alles raus. Bei 500 machen wir ein Path und pushen ein bisschen bei 1000.

01:13:50 Und dann machen wir einen High Pass bei 8. Äh, einen Low Pass bei 8, ne? Ist das jetzt 8? Das ist die 8 da. Die will ich noch drin haben. Parametrische war richtig. So? Ich würde da keinen Unterschied mehr erkennen. Danke. Also ich würde es nicht erkennen. Machen wir mal einen Vergleich. Warte mal.

01:14:36 Dreh mal ein bisschen bei 800. Warte kurz, das bin ich gerade beim anderen. Das ist meine Originalaufnahme. So, das hier. Machen wir hier mal. Graphic EQ. Oh, wow. Das kriege ich nicht mehr hin. Also da ein Unterschied?

01:15:09 Da einen Unterschied noch rauszuhören ist für mich völlig unmöglich, bin ich ehrlich. Und das ist meine eigene Stimme. Ich spiele es mal mit meiner Mom vor. Sie kennt meine Stimme am besten. Oder meine Freundin. Filter-IQs in die Presets. Ist egal, also das ist übel. Das ist wirklich heftig. Ich glaube, ich lasse die jetzt erstmal so. Zwei Genilegs ist halt okay. Dann hörst du vielleicht noch einen Unterschied.

01:15:38 So, save project before closing brauchen wir nicht. So, jetzt wollten wir das ganze noch mit Quen machen. Jetzt ist die Frage welches Quen brauchen wir? Also Sieben Bass, Custom Voice oder Voice Design? Was ist denn der Unterschied zwischen euch? Voice Design, Custom Voice. Custom Voice wäre wahrscheinlich die hier. Da müsste ich wahrscheinlich fein trainieren, oder?

Ausblick auf Qwen3 TTS und weitere Anwendungsmöglichkeiten

01:16:1101:16:11 Das letzte war mit Fish Speech. Das hier. Fish Speech. Ich könnte es dir gerne mal kopieren. Ich schicke es noch mal kurz in den Chat rein. Das haben wir bis jetzt gerade gemacht. Wo ist Restream? Da ist Restream. AdBoon. Well. Ich glaube Custom Voice für Voice Cloning. Läuft alles lokal bei mir. Genau. Das haben wir gerade komplett einfach selber gemacht. Also ich habe das ja gerade hier in Audacity aufgenommen. Habe meine Berliner Sätze vorgelesen. Habe den Text...

01:16:55 Nein, nicht die Settings. Hab den Text, also das hier hab ich quasi, die hier hab ich vorgelesen, die Texte oder den Text. Hab dann, ein bisschen arg hektisch übrigens vorgelesen, hab dann den Berliner Paragrafen aufgenommen und gespeichert.

01:17:12 Und dann mit Fisch einfach tatsächlich hier, ich habe Claude einfach gesagt, ey yo, installier mal, schreib mal dazu ein Skript, das ist das hier und nimm mal das dazu machen. Das Ding kann Englisch, Chinesisch, Japanisch, Deutsch, Französisch, Spanisch, Koreanisch, Arabisch, Russisch, Niederländisch, Italienisch, Polnisch und Portugiesisch. Jetzt wäre die Frage, könnte ich meine eigene Stimme damit auf Englisch machen?

01:17:48 Das wäre funny. Vielleicht wäre ja nicht meine Stimme auf Japanisch. So muss ich ja Japanisch lernen. Das ist ja Quatsch. Ich glaube das Ding kann Dialekte, wenn du ihm eins gibst. So. Regenerieren wieder. Dauert nicht lange. Okay, dauert doch ein bisschen länger als ich trinken kann. Mensch, Schweinerei ist ja... Ach, das ist ja viel zu lang gegangen. Ist ja viel zu lang gegangen hier. So, wollen wir das gespeichert? Output Englisch.

01:18:48 Ja, ich hab den geilen deutschen Akzent, Alter. Oh, shit. Oh, man.

01:19:18 Ja, okay. Ich glaube, ich brauche einen englischen Text zum Vorlesen, sonst wird das nichts. Ah, es war Duolingo. Ja, ich wollte schon lange sagen, Duolingo ist jetzt Partner von dem Stream oder so. Kleiner Spaß. Oh Gott. Ja, nee. Ich glaube, ich bleibe da bei den Originalen. Was denkst du, die lowest Grafikkarte, die das Lokal packt? 3060, easy. Ich brauche 1,4 Gigabyte, brauche ich, damit das läuft bei mir. Das kannst du wirklich mit jeder Grafikkarte machen.

01:19:52 Noni

01:20:22 das wird schwierig das wird auch schwierig da ist sicherlich vielleicht noch hin vor allem französisch gut

01:20:54 Universal End-to-End Architecture, utilizing a discrete multi-code book LM architecture to bypass traditional information bottlenecks. Extreme low latency. Streaming generation, okay. 97 Millisekunden, was? Das kannst du ja zum Telefonieren benutzen.

01:21:17 Okay, das ist smart. Okay.

Zero-Shot Speech und Custom Voice Modelle

01:21:4301:21:43 Zero Shot Speech Generation On the SED TTS Word Error Set 0,7 auf Chinesisch und 1,2 auf Englisch Das heißt die Dinger sind mittlerweile besser auf Chinesisch Wahnsinn Aber ich weiß immer noch nicht welche ich benutzen muss So, das war jetzt Das war Voice Design, so wir wollen Custom Voice Custom Voice ist wahrscheinlich zum Klonen, oder? Fuck meine Augen Mann, mobbt mich

01:22:22 Oh, da clone ich nicht, da kann ich User Instructions geben. Dafür ist Custom Voice da dann. Kann man sogar direkt machen.

01:22:52 Das sind die 0,6 B-Modelle. Okay, das heißt, wir wollen Bass haben. Würdest du sagen, Bootstrap Academy ist... Ich würde sagen, die ist auch schon was für Fortressen. Also wenn du alles davon weißt, dann bist du krass.

Risiken des Stimmenklonings und gefälschte Inhalte

01:23:2301:23:23 Das Ding ist, die Stimuster, ne? Jeder, der irgendwie auf Social Media ist, hat halt so viele von seinen Stimustern schon mal hochgeladen. Also von mir gibt's tausende Stunden Stimme im Internet, einfach weil ich Tutorials damit gemacht hab. Die kann sich jeder runterladen und klonen. Da kann ich nichts dagegen machen. Die kann man auch einfach vom Desktop abfilmen. Da hab ich wenig Einfluss drauf. Wenn man da sich ein bisschen Mühe gibt, kriegst du das easy hin. Und ich hab nichts, was ich tun kann dagegen. Also...

01:23:50 Und ich meine, es wird ja sogar schon gemacht. Hier CapCut oder sowas, die machen das ja einfach. Die haben sich ja sogar quasi die Rechte dran gesichert, wenn man so genau möchte. Das kommt auch am Sonntag im Video übrigens. Video ist noch nicht ganz fertig, aber es ist Teil vom Digital Independence Day. Das kann ich schon mal vielleicht droppen. Es geht um Linux, weil so viele gefragt haben, welches Linux ich hier benutze. Darum geht es am Sonntag.

01:24:15 Ja, okay, probieren wir das doch mal. Das heißt, wir wollen das Bass-Modell... Interessant. Ah, nicht das 06er. Ich will die 1,7 Bass haben. Das soll schon gut sein. Ja, der Pinguin. Nice.

01:24:29 Eben, ein Stream, nicht mal ein Stream, es reicht ein scheiß Anruf aus, ein Video Call reicht aus, dass du das machen kannst. Du kannst, und bei Video wird es nicht mehr lange dauern, dann ist es ganz genau so. Du kannst einfach hergehen und sagen, hey schonmal hier, ich hab ein paar Stunden von dieser Stimme hier, oder von diesem Face hier, wie er sich bewegt, was er redet und so weiter, dann kannst du es auch klonen. Ich mein, Bilder waren ja immer das...

01:24:51 quasi das erste was passiert ist, kannst du jetzt easy machen, brauchst nicht mal mehr irgendwas fein trainieren, hast du früher gebraucht, mittlerweile kannst du es einfach bearbeiten, dann kannst du Audio jetzt machen, das geht jetzt auch schon, das nächste sind Videos. Da brauchst du nicht mehr lange warten, nächstes Jahr haben wir das. So, Bass, äh, b-b-b-b-b-b-Bass, Bassmodell, okay, dann machen wir doch das Bassmodell.

01:25:18 neuen ordner würde ich sagen nee auch nicht in home wir hatten das in kai wieder mal kai wieder mal man in home schöne ordner struktur jetzt muss ich kurz gucken wo ich das hinpacken kann

01:25:49 Ja genau, das Original gehört mir. Das kann ich jederzeit beweisen, aber wer mich nicht kennt, kann es nicht verifizieren. Also wenn ihr irgendwann, und das gibt es tatsächlich schon, oder gab es schon mehrfach, wenn irgendjemand online Werbung sieht auf TikTok, auf Reddit und so weiter, ich habe darüber sogar ein extra Video gemacht, dann denkt man als erstes mal, ja klar, das ist doch von dem, das ist doch von diesem Influencer und dann seid ihr...

01:26:12 wütend auf mich, weil ich Werbung für irgendein Scam-Coin oder sowas mache oder für irgendeinen anderen Scam mache und fallt da eventuell sogar drauf rein, dann seid ihr wütend auf mich, nicht auf den, der meine Stimme geklont hat. Das ist halt... Das ist ne Schweinerei, ich sag's wie es ist. Ja, zum Beispiel, genau, zum Beispiel. So, ähm... Ah, ich hab's im Ongel.

01:26:49 Gibt es schon irgendwelche Möglichkeiten, die gefälschten Audios zu erkennen? Es gab, es gab welche früher. Und weil ganz kurz die Frage aufkam, GUIs für Fisch, ähm, für Fisch gibt es eine GUI. Die kannst du einfach runterladen, die ist dabei bei dem, bei dem Ding. Der Stream bleibt auf jeden Fall online, ja klar, natürlich.

Herausforderungen bei der Erkennung von KI-Inhalten

01:28:0901:28:09 Kriegst du auf YouTube auf jeden Fall auf Twitch wird er irgendwann automatisch gelöscht aber auf YouTube bleibt einfach da

01:28:16 So, es gab Möglichkeiten Text zu erkennen, also quasi, dass man erkennt, was genau eigentlich modifiziert wurde von einem Text, beziehungsweise was mit KI geschrieben wurde, anhand von welche Wörter wurden benutzt, weil es ungewöhnlich ist, dass man zum Beispiel viele Gedankenstriche benutzt. Das ist irgendwann so ein Smell geworden und ja, irgendwann hat sich das nach und nach immer mehr gesteigert in die Richtung von, okay, das Problem ist, die Modelle werden halt leider irgendwann einfach besser.

01:28:44 Und besser, und besser. Und jetzt haben wir gerade aktuell zwei Situationen gleichzeitig, die wir als Konsumenten noch nicht so richtig auf dem Schirm haben. Viele kennen mittlerweile den Model Smell, ich nenne es jetzt einfach mal Model Smell, von OpenAI-Modellen, also 5.2 zum Beispiel. Die haben eine ganz bestimmte Art zu schreiben. Hier sind fünf Tipps, wie du dich bla bla bla, ne? Sowas zum Beispiel. Oder Gemini macht das auch ganz gerne so. Die haben immer eine relativ ähnliche Struktur.

01:29:12 Und das Ding ist, das erkennen wir, aber es gab ein paar Studien, dass die chinesischen Modelle ganz andere Wörter verwenden. Vor allem Kimi, Kimi K2 ist gerade rausgekommen und ist ein extrem gutes Modell, hat eine Trillion Parameter. Das ist eins der größten Modelle, die es gibt aktuell, aber davon sind nicht so viele aktiv, deswegen kann man das ganz gut ausführen. Man braucht schon ein halbes Rechenzentrum, um Kimi auszuführen, aber es ist trotzdem ein krasses Modell. Und die chinesischen Modelle haben...

01:29:42 einen ganz anderen Sprachgebrauch als die USA-Modelle, weil natürlich andere Trainingsdaten. Die chinesischen Modelle sind hauptsächlich erstmal auf chinesischen Daten trainiert und natürlich auch auf den englischen Daten, weil die einfach im Internet sind, während die US-Modelle hauptsächlich auf Englisch trainiert wurden und dann vielleicht noch teilweise auf Deutsch, Italienisch, bla bla bla. Die chinesischen Modelle haben noch diesen riesigen chinesischen Datensatz einfach dazu und deswegen benutzen die Wörter ganz anders.

01:30:09 Weswegen die auch einen anderen Sprachgebrauch haben. Das wurde tatsächlich mal so bewiesen. Und dadurch ist es sauschwer geworden, den Model Smell rauszufinden. So, jetzt um zurückzukommen auf das, was du gefragt hast, das Audio. Wir haben das schon bei Bildern, also bei Textets gesehen. Wir haben das bei Bildern gesehen, dass man es am Anfang rausfinden konnte und irgendwann wurde es immer schwerer und schwerer. Und bei Audio sind wir gerade noch dabei, dass wir, glaube ich, einige Tools haben, die es erkennen. Aber die Qualität von den Tools konvergiert gegen, sie müssen raten.

01:30:38 Und das ist halt genau das Problem. Ja, das wird alles mit lokaler KI gemacht, genau. Wir haben vorhin Phish benutzt, Phish Audio. Jetzt gerade probieren wir QN3 TTS zum Laufen zu bekommen.

01:30:51 Genau, das läuft alles bei mir auf dem Rechner. Vorhin hat es irgendwie 1, irgendwas Gigabyte RAM gebraucht oder VRAM gebraucht und das war es dann. CloudBot, MoldBot, nicht getestet. Ich habe mir überlegt, ob ich nächste Woche ein Video dazu machen will. Mal gucken, muss ich mir echt überlegen, weil, also seid vorsichtig mit MoldBot oder CloudBot oder wie auch immer man sie nennen möchte. Erkennen kann man nur, wenn man eine Originaldatei hat, genau. Und wer von euch, also das Ding ist ja, wenn wir...

01:31:23 mit Ansloth, das läuft? Oh, danke für den Tipp. Ja gut, die Quantisierung von Ansloth sind immer heftig.

01:31:34 Das Problem ist, wenn wir auf Social Media scrollen, dann sind wir nicht in der Situation, dass wir sagen, ey, wurde das jetzt mit KI gemacht? Ich gehe mal auf Fehler suchen. Fun Fact dazu, ich habe vorhin ein Prospekt von Aldi durchgeguckt, so wirklich ein gedrucktes Prospekt und habe dann so durchgeguckt und irgendwo war so eine Burger-Maschine im Angebot. Und ich habe geguckt und da stand dabei,

01:31:59 Hintergrund wurde mit KI generiert. Bei Aldi, im Prospekt, das gedruckt war. So, die haben es wenigstens dazu geschrieben, Ehrenleute. Aber ich hätte es nicht erkannt. Das heißt, weil ich einfach auch nicht daran gedacht habe, dass da überhaupt was mit KI sein könnte. Und dementsprechend wäre ich halt auch nicht irgendwie, also ich wäre auf jeden Fall drauf reingefallen sozusagen. Ich wäre auf jeden Fall nicht auf die Idee gekommen, zu hinterfragen, ob es KI ist. Das ist halt die Schwierigkeit daran. So, ähm, jetzt.

01:32:27 All seven research agents have completed. Here's a consolidated summary. Quen3, bass, genau. Voice cloning from three-second audio samples plus transcripts. Languages haben wir. Conda create, Conda activate, pip install, das sieht richtig aus, das sieht richtig aus. Transformers hab ich. Pinned, stimmt. Ich lass mich nicht im Stich, das sollte doch klappen, oder? Cool. Python, gut.

01:32:59 Must match. Ja, das haben wir. Harder Requirement. Oh! Oh, die braucht mehr. Oh, okay, wenn ich da ein bisschen lege, tut es mir leid. Das könnte aber trotzdem klappen. Oh, die ist größer. Oho. Jetzt bin ich aber gespannt, ey. Threadripper. 96 GB RAM und eine RTX 3060. Jesus.

01:34:34 Also mit einer RTX 3060 wirst du kein so starkes LLM laufen lassen können, wenn du es auf der Grafikkarte laufen lassen möchtest. Aber mit einem Frap Ripper und 96 GB RAM kannst du das Ganze auch einfach in deinen normalen RAM packen. Das würde schon funktionieren.

01:34:47 Pinocchio in StyleScript für Quen. Oh, okay. Geil. Das Ding ist, ich brauch sowieso am Ende in Python. Mittlerweile lass ich mir halt einfach die Sachen programmieren kurz. Weil es dauert nicht so sonderlich lang. Wenn ich mit Pinocchio rumspiele, kann ich nicht mal den Chat hier lesen. So kann ich mit euch währenddessen noch weiter reden und lass einfach zwei Augen auf Quen laufen. Der hier mit 14 Agenten versucht, das Ganze zu programmieren. Dementsprechend, ja.

01:35:18 Watermarks kann man nur erkennen, wenn man eins integriert hat. Genau. Google hat Synth-ID. Genau.

01:35:25 Jetzt das Ding ist, Google Synth-ID kannst du schon erkennen, aber du kannst es nur erkennen, wenn du Google bist. Beziehungsweise wenn du halt die API von Google implementiert hast. Wenn jetzt jeder Anbieter anfängt, sein eigenes Wasserzeichen reinzubauen und also quasi ich baue Morph-ID, Meta oder Facebook baut Meta-ID, Google hat dann Synth-ID und so weiter und so fort, dann muss ich ja, wenn ich verifizieren will, dass es kein KI-Content ist, muss ich...

01:35:53 jeden Anbieter einbinden und gucken, ob es bei dem generiert wurde. Und wenn ich das bei mir auf der lokalen Hardware mache, dann wird da kein Watermark drin sein, weil irgendjemand wird es einfach rausgepatcht haben. Deswegen ist die Chance, glaube ich, relativ gering, dass wir da nochmal zu irgendwie was kommen. Eine Frage zu Le Chat. Kann das mit Modellen wie Gemini oder ChatGBT mithalten oder ist das noch nicht so weit? Also Le Chat oder Le Chat ist nicht schlecht. Es kommt nicht ganz an die großen Flaggschiff-Modelle ran, aber es ist auf jeden Fall nicht schlecht.

Wasserzeichen und Grenzen der Modelle

01:36:2301:36:23 QN3 TTS läuft auch ganz gut mit CPU-only, okay. Ja, es gibt Modelle, die EXIF faken, die kannst du auch einfach selber editieren. Also EXIF-Daten sind ja solche Metadaten von Bildern. Dementsprechend geht das ja easy.

01:36:37 Die kannst du einfach reinschreiben. Das machen übrigens auch, hab ich auch schon ganz gerne gemacht früher mal. Wenn ihr ein Bild von euch irgendwo hochladet und ihr wollt aber nicht geleakt werden, wo er Standort ist, dann könnt ihr einfach selber die Exif-Daten verändern und sagen, ey, ich würde ganz gerne, tu so, als wäre das Bild in Ägypten aufgenommen worden, obwohl ihr eigentlich in Berlin wart oder sowas. Das ist super geil.

01:37:03 Welche Python-Version? Ich glaube 3. In meinem Fall habe ich jetzt 3.13. Probieren wir mal. Also ich weiß es nicht. Wenn Kuda die richtige Version ist, wenn PyTorch läuft, dann ist das kein Stress. Jo. Das kriegen wir hin. Wenn der Neustart kommt, war es zu viel. Ja, nö. Also ich meine, wir haben... Das System ist jetzt nicht ausgelastet gerade. Also das ist entspannt. Bildmaterial von echten Nachrichten. Wurde schon mit dem Sora-Wasserzeichen nachträglich versehen, um zu behaupten, es wäre Effekt. Oh!

01:37:46 Oh, daran habe ich noch gar nicht gedacht. Ja, natürlich. Jesus, wenn du überhaupt willst, dass irgendwas echtes nicht echt ist, bau einfach das Wasserzeichen drüber. Oh, fuck. Oh, das ist ja brutal. Ja, klar, natürlich.

01:38:04 Wenn ich einfach nicht möchte, dass jemand weiß, dass eine Nachricht real ist, geil. Wenn jemand irgendwann ein Fake-Video von mir reinbaut, einfach Sorawasserzeichen drauf und schon weiß ich ganz genau, oder kann ich einfach sagen, hey, yo, es ist nicht echt. Ha, scheiße. Aktuell gibt es CGPT Plus für... Achso, CGPT für einen Monat kostenfrei.

01:38:29 Der Unterschied zwischen bezahlt und kostenlos ist insane. Aber ich würde momentan tatsächlich, also ich benutze ChatGPT momentan eigentlich für fast gar nichts. Ich benutze zum Coden momentan ganz gerne wieder Claude, weil mir in letzter Zeit die ...

01:38:48 Die Ausgaben von ChatGPT sind irgendwie schlechter geworden. Ich kann nicht genau sagen, warum aber so seit zwei, drei Wochen sind die wieder schlechter geworden. Ich vermute, dass sie sich vorbereiten auf ein neues Release, weil es gab schon Leaks, dass diese Woche GPT 5.3 rauskommen soll. Deswegen, man sieht immer so einen kleinen Drop, kurz bevor das neue Modell rauskommt. Deswegen, das war so mein Guest, aber ich kann es euch nicht sagen. So, was haben wir? Ja, der macht es. Erst mal spawnen lassen.

01:39:19 Ähm, und genau. Wenn du, ähm, ich weiß nicht genau, wie viele Gratisanfragen man da hat. Also für normale Anfragen, wenn du quasi einfach nur normal arbeitest, benutze ich momentan wahnsinnig gerne Gemini tatsächlich, weil das irgendwie ein relativ großes Weltverständnis hat. Und zum Coden, wie gesagt, Claude. Das ist, aber das ändert sich. Das ist alles so eine Sache, die schwankt bei mir immer mal wieder. Ich wollte jetzt noch Kimi ausprobieren und wirklich mal produktiv ausprobieren. Deswegen, ja, muss ich mal machen.

01:39:50 Verstand ist die beste Validierung auf jeden Fall. Schauen ob der Text der Bücher im Bücherregal stimmt. Ja. Wenn man...

01:40:02 Also wenn, momentan geht das noch, ja, wenn man es aber leider richtig macht, dann ist, also wenn man ein sehr sehr gutes Bild findet, wo alles stimmt, heißt es nicht, dass es nicht, ähm, dass es nicht KI generiert ist. Wenn du ein Bild findest, wo du diese Flecken drauf hast oder wo du irgendwelche Smells drauf hast oder nur vier Finger, das wäre der einfachste Fall, dann weißt du, das ist KI generiert, aber wenn du es nicht hast, weißt du nicht, dass es nicht KI generiert ist, wenn du verstehst, was ich meine. Das ist halt das Problem. Nach Kimi brauchen sie eine krasse Antwort, ja, tatsächlich.

01:40:32 Gemini hat mich in letzter Zeit richtig wieder verarscht. Seit Gemini 3 Flash rausgekommen ist, stellt sich die Web-Oberfläche gelegentlich einfach auf Flash um und ich wundere mich, warum ich eine scheiß Antwort bekomme. Oh, DevStra, das kostenlos? Via API? Das ist geil. GLM habe ich nicht probiert fürs Coding tatsächlich. Gibt es ein Abo? Ich dachte, das ist wie bei API nur. Also ich habe halt bei Claude den Abo-Tarif, der ist ja mit Claude Code verbunden.

01:41:07 dass ich die Qualität auch je nach Programmiersprache extrem je nach Programmiersprache geht das Komplett im Keller oder komplett nach oben festgestellt dass ich genau Geminade zum Planen, Claw zum Coden, Grog zum Validieren benutze ich tatsächlich nicht aber vier Finger sind nicht immer in den DS, ne ja gut, fair im echten nebenhin gehen, du hast ja vier Finger, du bist nicht echt oh das ist gut 8 oder 16 Pixelblöcke, ok ja das ist gut

01:41:41 So jetzt haben wir die nächsten 14 sind fertig Also ihr habt gesehen was ich gemacht habe ich habe gesagt ey du nimmst erstmal 14 agenten zum implementieren also erstmal habe ich gesagt nimm 7 agenten zum researchen dann habe ich Eingeleitet was es machen soll dann habe ich gesagt okay hier 14 agenten zum Implementieren das war das hier dann 7 agenten zum überprüfen ob alles okay ist dann haben die nur mal probleme gefunden dann 14 zum fixen dann jetzt wieder 7 zum reviewen

01:42:17 Jetzt bin ich gespannt, ob es funktioniert. Habe ich mal lokale LAMs zum Coden benutzt? Also so wie ClawDeads. Ich habe es probiert, aber die Ergebnisse waren nie so gut, dass ich happy war damit. Gemini einfach nur enttäuscht. 6 Stunden an einem Problem gesessen, nur Müll erlebt. Zum Programmieren? Gemini zum Programmieren habe ich auch nur schlechte Erfahrungen gemacht in letzter Zeit. Oder generell, ich weiß nicht, das hat nie so ganz funktioniert. Ah, ja.

01:42:54 Das ist super, sehr gut. Ein Studenten, aber geil.

01:43:03 So, jetzt gucken wir nochmal nach Reviews. Das ist halt mega, also der, oh, ja. Es frisst Tokens ohne Ende, also ihr seht's. Ähm, ich hab ja noch zwei Tage, das ist ja. Also, sie macht sich prozent. Das Ding ist, bei Claude hat man ein krank hohes Limit momentan. Ich weiß nicht warum, aber Claude verbraucht einfach weniger. Bei ChatGPT bin ich einfach instant auf meinem Limit. Während bei Claude ist halt so, ja, du, gönn dir, hier Tokens, das ist voll geil. Also, die haben...

01:43:30 Es wechselt. Es wechselt immer mal wieder. Man muss immer bedenken, die haben alle wieder, alle einfach nur Bock auf möglichst viel Gewinn machen. Google Antigravity habe ich ausprobiert und es hat nur Abbrüche gegeben und hat mir nur Bugs ausgespuckt. Aber ich habe es auch probiert, direkt als es frisch rauskam. Und das war...

01:43:56 Das war leider nicht so erfolgreich. Ich weiß nicht, ob es jetzt einfach besser ist mittlerweile. Ich glaube schon. Aber fairerweise habe ich seither nicht nochmal wirklich intensiv getestet, weil da, als es rausgekommen ist, war es halt so, pff, nee, geht gar nicht. Und zu... Ah genau, zu dem größeren Kontext. Gemini hat einen riesigen Kontext, aber dazu gibt es eine geile Statistik. Jetzt pass auf, finde ich dir sicher.

01:44:32 Gemini ist, äh, JetGBT 5.2 ist tatsächlich das einzige Modell, was das für mich richtig hinbekommen hat. Und zwar, nein, nein, ähm, nein, das hier.

01:44:44 Ja, das hier. Und zwar der Needles-Test, der Benchmark. Und zwar, wie lange schafft es ein Modell, nicht zu vergessen, was du von ihm willst? Also quasi nicht den Kontext zu verrallen. Es ist relativ egal, ob ihr ein 256.000-Token-Kontext habt, was JetJubiti hat, hier, oder ob ihr jetzt ein 1-Million-Token-Kontext habt, wenn das Modell...

01:45:11 sowas hier macht. Das hier war GPT 5.1 Thinking, das hier oben ist GPT 5.2 Thinking. Und der Punkt war, wenn du am Token Limit warst, dann hat dir ein GPT 5.1, wenn du viele Tokens verbraucht hattest, immer nur die schlechteste Antwort, also 50% schlechtere Antworten gegeben. Einfach grundsätzlich, weil du viel in deinem Token drin hattest oder viel in die Frage reingesteckt hattest.

01:45:41 Und dementsprechend nicht, das Modell sich nicht mehr daran erinnern konnte. Es ist quasi als hättest du jetzt gerade ein komplettes Buch inhaliert und weißt nicht mehr, was halt auf Seite 2 gestanden hat, weil du den Text nicht auswendig gelernt hast. So, und GPT 5.2 hat sich irgendwie noch genau an den Text erinnert. Also ziemlich genau. Das ist jetzt, es gibt verschiedene Benchmarks davon. Das hier testet acht Nadeln. Auch hier ist es 70 Prozent runtergegangen, aber da war halt das da bei 30 Prozent unten. Und das ist tatsächlich das einzige Modell, was das hat.

01:46:09 Deswegen, bei Gemini, wenn man mehr als vier Fragen oder vier Follow-Up-Fragen stellt und dann quasi immer Kontext zurückbekommt, Gemini wird richtig schlecht nach der vierten, fünften, sechsten Frage. Mindestens.

01:46:23 Während GPT 5.2, vergisst nicht, was ihr es mal gefragt habt. GPT 5.2 geht einfach durch. Deswegen kann ich zum Beispiel Codex auch einfach sagen, mach das jetzt mal und mir ist völlig egal, wie viel Context es verbraucht. Es geht durch die Aufgabe durch und wenn der Context voll ist, dann komprimiert es alles wieder und geht einfach weiter durch. Ich habe GPT 5.2 als einziges Modell schon hinbekommen, dass es wirklich 50, 60 Stunden durchläuft, ohne dass ich irgendwas machen muss. Der PC lief hier mehrere Tage einfach durch, während es lief. Und...

01:46:51 Das hat kein anderes Modell bisher hinbekommen. Claude hingegen ist richtig schlecht nach einigem am Kontext. Also es wird wirklich auch genauso wie Gemini einfach schlechter. Aber dadurch, dass ich hier immer die ganze Zeit sage, Spawn Review Agents, die Agents werden neu gespawnt. Die Agents sind direkt am Anfang. Die haben noch volles Kontextfenster. Das heißt, die haben nicht vergessen, um was es ging. Deswegen arbeite ich zum Beispiel bei Claude extrem viel mit Agents. Während bei ChatGPT sage ich aber nur...

01:47:19 Und los geht's. Machen wir ein Update, wird der Counter zurückgesetzt. Ja, das ist auch immer ganz geil. Also grundsätzlich, auch bei Codex wird alles zurückgesetzt, immer wenn es ein Update gibt. Deswegen versuche ich immer wirklich schnell, mein Loser-Chill mit ranzukommen. Wenn sie dann irgendwas Neues veröffentlichen, dann kriegst du alles wieder. Oh, für Allgemeines. Es kommt drauf an, was du machen willst. Also, Klaude ist schon momentan echt nicht schlecht, sag ich mal.

01:47:53 ChatGPT hat so ein paar andere Sachen noch. Und die Claude halt nicht hat. Aber, also Claude-Code ist schon gut. Ja genau, wir fragen bei Gemini nicht nach, wer ändert den Prompt. Genau so ist es. Bei Gemini ändert man den Prompt. Bei ChatGPT kannst du nachfragen. Aha, guck mal hier. So, irgendwas passiert hier gerade. Setting Pad Token. Oh, die Grafikkarte geht auf. Oh, oh, oh, oh, oh. Look at that.

01:48:20 Ich bin wieder im Weg. Hier Grafikkartenauslastung 52 Prozent und wir haben Grafikkartenspeicher auf 10 GB oben. Das heißt, da läuft gerade was. Ich setze mich mal nach hier unten. Wobei, ne, unten seht ihr mich wieder nicht. Da läuft gerade was. Das ist super.

01:48:38 Also mal Rookholt verwendet. Oh, hab ich mir angeguckt. Aber ich hab's nicht verwendet. Ralph hab ich, oder du meinst Ralph Wiggum, oder? Mit Ralph Loop. Ralph hab ich mir angeguckt und hab dann gesehen, dass es basically genau das ist, was ich sowieso schon die ganze Zeit mache.

01:48:56 Ich habe in meiner Cloud.md für die Softwareprojekte, die ich habe, da habe ich quasi drin stehen, ey, wenn du fertig bist, also hier, ich packe quasi alles, was ich machen möchte, in GitHub-Issues. Und dann sage ich einfach nur, fix diesen Issue. Es geht her, holt sich diese Analyse von dem GitHub-Issue und schreibt sich selber nochmal eine Analyse und eine Zusammenfassung von allem.

01:49:19 Und anschließend, wenn es fertig ist oder glaubt, fertig zu sein, spawnt es einen Claude-Review-Agent, der den Uncommitteden Code einfach überprüft, ob der in Ordnung ist. Dann spawnt es einen Claude-Agent, der überprüft, ob der Code den Issue löst. Und dann macht es das selber nochmal mit Codex und mit Codex, damit es halt den Issue überprüft. Und dann hast du vier Review-Agents. Wenn irgendjemand irgendwas findet, dann wird es gefixt. Und das mache ich hier quasi jetzt gerade mit den Agents auch wieder, weil ich keinen Codex mehr frei habe. Ja.

01:49:50 Wie viel kann man mit Cloud mit dem Pro Abo coden? Ich weiß es nicht ehrlich gesagt. Das ist ja das 20€ Abo, das kleine Abo sozusagen. Das habe ich schon seit einer Weile nicht mehr. Ich habe immer das 200€ Abo jetzt in letzter Zeit gehabt. Mit dem 20€ Abo bist du schnell an deinen Grenzen leider. CloudBot und MoldBot, gerade wegen den Sicherheitsproblemen. Also ich hatte überlegt wegen nächster Woche. Perfekt, der Test ist fertig. So, gucken wir mal.

01:50:21 Geil. Ich hab einfach nichts gemacht. Ihr habt es gesehen, ne? Ich hab einfach nur gesagt, mach mal. Und es ist da. Wir kommunizieren und arbeiten. Dabei spielen künstliche Intelligenz und maschinelles Lernen eine zentrale Rolle. Es geht nicht mehr nur um die große Verarbeitung von Daten, sondern darum, komplexe zu... Das ist doch mein Text, oder? Das ist mein Text, du kleiner Schlängel. Ich kenn den. Ich hab den vorhin eingesprochen. Du Schlawiner. Ich werd mit euch dann einfach mein im Audio genommen. Aha.

01:51:15 Das hat sie mich nicht gemacht. This is a test of voice cloning. Das hat es nicht gemacht. So jetzt. Boah, kreativ finde ich eine schwierige Aussage bei KI. Ich weiß nicht, ob ich das kreativ nennen würde, ehrlich gesagt. Weil Kreativität ist Definitionssache. Boah.